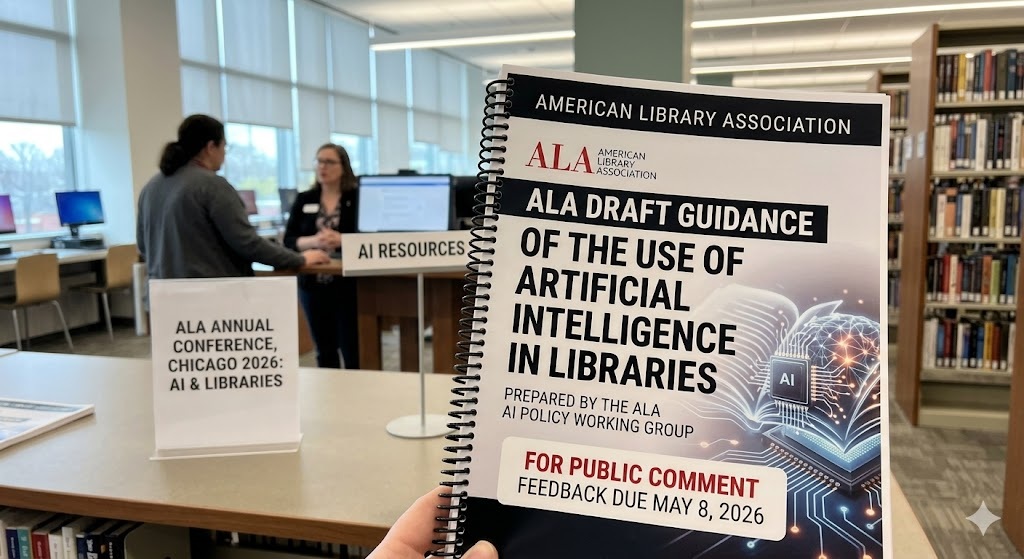

Association of College and Research Libraries (ACRL). “ALA Draft Guidance of the Use of Artificial Intelligence in Libraries Comments Due May 8.” ACRL Insider, 2026. Accedido el 4 de mayo de 2026. https://acrl.ala.org/acrlinsider/ala-draft-guidance-of-the-use-of-artificial-intelligence-in-libraries-comments-due-may-8/

American Library Association (ALA), a través de su AI Policy Working Group, ha difundido para consulta pública un borrador titulado Guidance of the Use of Artificial Intelligence in Libraries, concebido como un documento marco para orientar a los profesionales de las bibliotecas ante el crecimiento acelerado de la inteligencia artificial.

La iniciativa refleja el reconocimiento institucional de que la IA ya no es una cuestión futura o periférica, sino una realidad que está transformando servicios, procesos, expectativas de los usuarios y el propio papel social de las bibliotecas. El plazo de comentarios fijado hasta el 8 de mayo de 2026 indica además la voluntad de incorporar la voz de la comunidad profesional antes de su posible debate y aprobación formal en la Annual Conference de la ALA en Chicago.

El borrador nace con una finalidad eminentemente práctica: ayudar a las bibliotecas a navegar oportunidades y desafíos. La formulación es significativa, porque evita una postura tecnofílica o tecnofóbica. La ALA no presenta la IA únicamente como amenaza ni como solución automática, sino como un fenómeno complejo que exige análisis crítico. Entre las oportunidades pueden situarse la mejora de búsquedas documentales, automatización de tareas repetitivas, apoyo a catalogación, generación de resúmenes, accesibilidad lingüística, atención básica al usuario o análisis de grandes volúmenes de datos. Entre los desafíos aparecen cuestiones como privacidad, sesgos algorítmicos, dependencia de proveedores privados, opacidad técnica, desinformación generada automáticamente y posibles impactos laborales.

Propósito y Contexto

La Asociación Americana de Bibliotecas (ALA) ha elaborado este documento a través de su Grupo de Trabajo de Política en Inteligencia Artificial con un doble objetivo: recomendar a las bibliotecas que desarrollen sus propias políticas locales de IA y ofrecerles un marco de referencia sólido para hacerlo. El documento surge en un momento en que la inteligencia artificial, incluyendo sus variantes generativa y agéntica, está transformando profundamente la manera en que la información se crea, accede y evalúa. La ALA reconoce que la IA puede ampliar la capacidad de las bibliotecas en áreas como la instrucción, las operaciones y la accesibilidad, pero advierte que esto solo es posible cuando la tecnología apoya la experiencia profesional existente, el compromiso comunitario y el juicio crítico del personal bibliotecario. En ese sentido, esta guía no busca reemplazar las políticas existentes de la ALA, sino construir sobre ellas.

Bien Público y Rol Humano

El primer gran pilar de la guía es el concepto de bien público, entendido como el compromiso de las bibliotecas de mejorar la sociedad y proteger derechos fundamentales como la educación, la alfabetización y la libertad intelectual. El documento reconoce que la IA ofrece oportunidades reales para abordar desafíos sociales y ambientales, pero también advierte sobre sus riesgos: puede erosionar la autodeterminación humana, profundizar la desigualdad social y contribuir al cambio climático. Por ello, la guía establece con claridad que la IA debe complementar y nunca reemplazar la inteligencia, el razonamiento y el pensamiento crítico humano. Las tareas que requieren empatía, juicio y conocimiento especializado no deben automatizarse, y todos los usuarios tienen derecho a recibir asistencia humana en cualquier servicio bibliotecario. Además, se subraya que cualquier ganancia de eficiencia generada por la IA debe traducirse en mejoras para el personal y las comunidades, y no en justificación para reducir puestos de trabajo.

Libertad Intelectual y Transparencia

La libertad intelectual es uno de los valores más arraigados en la tradición bibliotecaria, y la guía dedica especial atención a cómo la IA puede amenazarla. Los sistemas automatizados pueden, de manera opaca, sesgar los resultados de búsqueda, priorizar ciertos contenidos sobre otros o suprimir materiales relacionados con comunidades marginalizadas o temas controvertidos, todo ello sin que los usuarios lo perciban. Frente a esto, el documento exige que cualquier sistema automatizado cuente con documentación clara y accesible que explique su funcionamiento, propósito y posible influencia en los resultados. Las salidas de la IA deben tratarse siempre como borradores sujetos a revisión humana, especialmente en temas complejos o sensibles. Asimismo, las bibliotecas deben oponerse activamente a herramientas de IA que señalen materiales para su eliminación o despriorización de formas que socaven la diversidad de puntos de vista, y deben ofrecer a los usuarios la posibilidad de optar por servicios sin intervención algorítmica.

Privacidad y Protección de Datos

La privacidad de los usuarios es un valor central en la ética bibliotecaria, y la guía lo refuerza en el contexto de la IA con directrices muy concretas. Las bibliotecas tienen la responsabilidad de comprender cómo funcionan las herramientas de IA, cómo gestionan la información personal y qué riesgos pueden generar para los usuarios. Se insta a evitar el ingreso de información de identificación personal, temas sensibles o registros no públicos en herramientas cuyas prácticas de datos sean poco claras, y a limitar el uso a herramientas institucionales previamente verificadas. Al trabajar con proveedores externos, las bibliotecas deben preguntar explícitamente si los datos de los usuarios se utilizan para entrenar modelos de IA, qué salvaguardas existen y si las funciones de IA son opcionales. Toda esta información debe comunicarse a los usuarios en lenguaje claro y sencillo, explicando sus derechos de acceso, corrección y eliminación de datos. La formación del personal en privacidad y uso responsable de la IA se considera parte esencial del desarrollo profesional.

Sostenibilidad Ambiental e Institucional

La guía aborda la sostenibilidad desde dos dimensiones que se complementan. Por un lado, la dimensión ambiental: la IA consume grandes cantidades de energía y agua, genera emisiones de gases de efecto invernadero y produce residuos electrónicos. Las bibliotecas deben evaluar el ciclo de vida ambiental completo de los sistemas de IA que adoptan, solicitar a los proveedores información transparente sobre su huella de carbono e intensidad energética, y priorizar herramientas de código abierto, modelos más pequeños y soluciones con menor impacto ecológico. Por otro lado, la sostenibilidad institucional también es crucial: la sobreautomatización puede erosionar las competencias del personal, debilitar la confianza comunitaria y generar dependencia excesiva de sistemas controlados por proveedores comerciales. La guía advierte que las ganancias de eficiencia a corto plazo no justifican comprometer la flexibilidad institucional, el conocimiento profesional acumulado ni la capacidad de las bibliotecas para adaptarse de forma autónoma en el futuro.

Diversidad, Equidad, Inclusión y Acceso

El documento cierra su análisis de valores con un apartado dedicado a la diversidad, la equidad, la inclusión y el acceso, reconociendo que los sistemas de IA con frecuencia reproducen y amplifican las desigualdades existentes. Los conjuntos de datos sobre los que se entrenan estos sistemas suelen subrepresentar lenguas no anglófonas, dialectos y comunidades históricamente marginalizadas, lo que puede traducirse en servicios menos precisos o directamente discriminatorios para estos grupos. Ante esto, la guía exige que las bibliotecas auditen los sistemas de IA antes y durante su uso, colaboren con comunidades multilingües para probar sus resultados y garanticen que los servicios habilitados por IA sean accesibles en términos de idioma, nivel de alfabetización, discapacidad y capacidad tecnológica. También se plantea una reflexión importante sobre los datos de los usuarios como una forma de trabajo no remunerado, y se insta a minimizar las prácticas extractivas de datos en los contratos con proveedores. Finalmente, se enfatiza que los beneficios de la automatización deben distribuirse de manera justa entre trabajadores y comunidades, preservando trayectorias profesionales y oportunidades de desarrollo para los bibliotecarios del futuro.

En conjunto, este documento representa una postura institucional clara y fundamentada: la inteligencia artificial puede ser una herramienta valiosa para las bibliotecas, pero solo si su adopción está guiada por valores humanos, éticos y democráticos. No basta con que una herramienta sea eficiente o innovadora; debe ser justa, transparente, respetuosa de la privacidad, sostenible y verdaderamente al servicio de todas las personas, especialmente de las más vulnerables. La ALA concibe esta guía como un documento vivo, destinado a evolucionar junto con la tecnología y las necesidades de las comunidades a las que las bibliotecas sirven.