Hansen, Dave. 2025. “Anthropic Wins on Fair Use for Training Its LLMs, Loses on Building a ‘Central Library’ of Pirated Books.” Authors Alliance, 24 de junio de 2025. https://www.authorsalliance.org/2025/06/24/anthropic-wins-on-fair-use-for-training-its-llms-loses-on-building-a-central-library-of-pirated-books/

El 24 de junio de 2025, el juez William Alsup del Tribunal del Distrito Norte de California emitió una resolución clave en el juicio colectivo contra Anthropic, empresa creadora de los modelos de lenguaje Claude. La demanda, presentada por los autores Andrea Bartz, Charles Graeber y Kirk Wallace Johnson en representación de millones de escritores, cuestiona el uso de libros protegidos por derechos de autor para entrenar sistemas de inteligencia artificial.

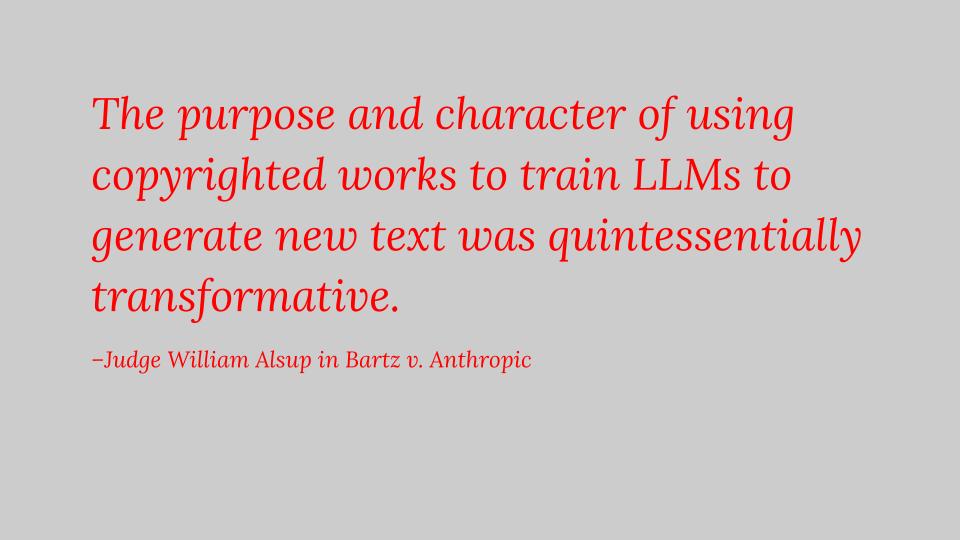

El fallo representa una victoria parcial para Anthropic. Por un lado, el tribunal determinó que entrenar modelos de lenguaje utilizando libros adquiridos legalmente constituye un uso legítimo bajo la doctrina de fair use del derecho estadounidense. Según el juez Alsup, este tipo de uso es “transformador”, ya que no busca replicar ni sustituir las obras originales, sino generar contenido nuevo, lo que encaja dentro del espíritu de la ley de derechos de autor que pretende fomentar la creatividad y el avance científico.

Sin embargo, la empresa perdió en un punto crítico: el uso sistemático de libros pirateados para construir una “biblioteca central” con fines de entrenamiento de IA. La evidencia demuestra que en 2021 y 2022, miembros de Anthropic descargaron millones de obras de sitios como Books3, Library Genesis (LibGen) y Pirate Library Mirror (PiLiMi). Estas plataformas contienen copias no autorizadas de libros protegidos, y Anthropic era plenamente consciente de ello. El propio CEO, Dario Amodei, reconoció internamente que optar por este camino era una manera de evitar el “trabajo legal, comercial y de gestión” que implicaría adquirir licencias.

En particular, el cofundador Ben Mann descargó en 2021 el conjunto de datos Books3 (compuesto por cerca de 196.000 libros pirateados), seguido de cinco millones de títulos desde LibGen y otros dos millones desde PiLiMi. Estas acciones fueron calificadas por el juez como violaciones deliberadas del derecho de autor, y aunque todavía no se ha determinado la magnitud de los daños, el tribunal ha decidido celebrar un juicio separado para abordar esta cuestión y valorar posibles indemnizaciones.

Desde Anthropic, una portavoz declaró a The Verge que celebran que el tribunal haya validado el uso transformador de las obras con fines de entrenamiento. La empresa sostiene que su objetivo no era imitar o reemplazar los libros originales, sino crear algo nuevo con base en ellos. No obstante, este argumento no exime de responsabilidad cuando se utilizan materiales obtenidos de forma ilegal, incluso si el uso posterior pudiera ser considerado transformador.

Este caso se enmarca dentro de un creciente número de demandas contra empresas de inteligencia artificial por el uso indebido de contenido protegido. La resolución de Alsup podría sentar un precedente clave: valida el entrenamiento de IA sobre obras adquiridas legalmente como fair use, pero marca una línea roja cuando se trata de contenidos pirateados. Las próximas fases del proceso judicial determinarán las consecuencias económicas y legales para Anthropic, y el caso podría influir significativamente en las prácticas de entrenamiento de modelos de IA en la industria.