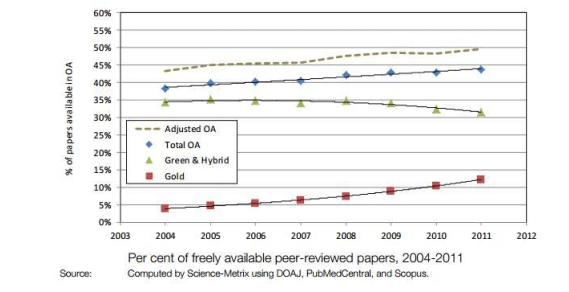

El acceso abierto es un instrumento fundamental para mejorar la circulación del conocimiento y, con ella, la innovación. Son varios los países y distintas las disciplinas donde el número de artículos a los que puede accederse hoy gratuitamente supera el 50 %. El informe “Proportion of Open Access Peer-reviewed Papers at European and World Levels, 2004-2011”, un estudio europeo cuyo objetivo era cuantificar la proporción de los artículos revisados disponibles en acceso abierto tomando un área geográfica correspondiente a Europa, Brasil, Canadá, Japón y Estados Unidos, estimó que en 2011 el 40% de los artículos peer review estaban en acceso abierto (Archambault et al. 2013; Gargiulo 2013).

La libre disponibilidad de la mayor parte de los artículos es ya una realidad en el campo de la ciencia y la tecnología en general, en el de la investigación biomédica, en el de la biología y en el de las matemáticas y la estadística. Por el contrario, los campos en los que el acceso abierto sigue estando más restringido son el de las ciencias sociales y humanidades y el de las ciencias aplicadas, la ingeniería y la tecnología.(Archambault, Amyot, Deschamps, Nicol, Rebout and Roberge 2013) Pues existen distintas formas de comportamiento de los autores en diferentes disciplinas científicas, en Ciencias prácticamente el total de los autores deposita el preprint en Arxiv, el repositorio de la ciencia creado hace 20 años por Paul Gimsparg en los Álamos, hoy en Standford. Esto forma parte de la dinámica de trabajo de esta área que requiere de la rápida difusión de los resultados, ya que de otro modo otro investigador puede adelantarse en su publicación. Por ello lo que encontramos en este repositorio son preprints, y no postprint como ocurre en las Ciencias Sociales y Humanides, que se deposita el artículo una vez publicado.

Generalmente los estudios evalúan la correlación entre las cifras de citación y de descargas. Se parte de la hipótesis de que los artículos con un menor número de descargas también acumulan menos citas. Los resultados difieren de una base de datos a otra. Sí existe una cierta correlación entre citas y descargas, pero éstas dependen de la disciplina o tipo de documento. En conclusión se puede decir que las descargas no son un sustituto universal de las cifras de citación, si bien el acceso abierto generalmente parece que conlleva una determinada ventaja competitiva (Nieder et al. 2013). En el cuadro que vemos a continuación (Archambault et al..Op. Cit) se establece una puntuación superior a 1 que indica que las publicaciones en OA son más citadas que en el ámbito general, mientras que una puntuación por debajo de 1 significa que estas publicaciones se citan con menos frecuencia. Por ejemplo, los trabajos sobre Agricultura, Pesca y Silvicultura reciben más o menos el mismo nivel de la cita (1.06) en OA que si sólo estuvieran en cualquiera revista. Por lo general prácticamente en todas las áreas de conocimiento se deriva una ventaja de citación OA, y paradójicamente, en muchos de los campos en los que la proporción de artículos OA es baja reciben una ventaja competitiva de cita considerable, como en la filosofía y teología (1,54), humanidades artes en general y ciencias sociales, los estudios de comunicación, ingeniería y artes visuales y escénicas. Esto responde a una lógica, ya que cuanto más artículos esté en Acceso Abierto en una disciplina menos se beneficiaran que aquellas disciplinas que tienen todo en OA, ya que al haber menos, los pocos que hay se citan mucho más. Pues si el 100% de los artículos estuvieran en abierto el OA no tendría ninguna ventaja competitiva.

Hay que matizar que las estadísticas sobre las revistas de la ruta dorada (revista OA) requieren una cuidadosa interpretación, ya que muchas de ellas son más jóvenes y pequeñas, y estos factores tienen un efecto negativo sobre la tasa de citas y por lo tanto indican negativamente en los valores medidos de cita, pues los investigadores prefieren leer y citar con más frecuencia revistas establecidas, por lo que es un reto para una revista joven es tener autores y artículos de alta calidad, pues se necesita tiempo para obtener una reputación y atraer a investigadores consagrados. Si bien, la mayoría de estos estudios se hacen en relación a las citas recibidas en ISI Web of Science, donde las citas que se recogen son las de las propias revistas incluidas en este índice, y no las citas provenientes de otras revistas no incluidas en ISI. Por ello si consultamos diferentes índices como Scopus, que tiene una mayor representación de revistas de otros ámbitos geográficos o lingüísticos, o mismamente el índice Google Schoolar que se beneficia de la sinergia del propio buscador, veremos que el impacto es mucho mayor, y un factor fundamental para ganar visibilidad es que este motor de búsqueda indexe una investigación como una publicación académica.

Posteriormente a estas reflexiones, considera que lo que está obstaculizando llegar a la situación óptima, es decir al 100% de los artículos en acceso abierto, son una serie de obstáculos puramente psicológicos que bautiza como “Parálisis de Zeno”. Aunque según Harnad cada fobia que está limitando al investigador a depositar en abierto es falsa, ya que se basa en malentendidos, y según el autor, un estudio de los síntomas, analizando cada fobia en si mismo será la única manera rápida y segura a liberarse de este círculo paralizador por medio del mandato de autoarchivo OA, como ya algunas instituciones realizan con éxito.

Para Harnad hay muchas razones para que persista la inercia de la comunidad de investigación, y prácticamente todas ellas comienzan inexplicablemente con la letra “P”, que también es la primera letra de la palabra “parálisis”. En el libro de Svevo, Zeno su protagonista se plantea lo siguiente:

“¿Cómo voy a caminar por la habitación? No tengo tiempo suficiente! Antes de que pueda hacer el camino a través de la habitación, primero tengo que conseguir hacer mitad de camino a través del cuarto, y eso lleva tiempo, pero antes de que pueda conseguir llegar a mitad de camino, tengo que llegar a la mitad de la mitad del camino a través del cuarto, y así sucesivamente Así que no es el momento ni siquiera de empezar;. por lo tanto, posiblemente nunca pueda caminar por la habitación “.

Italo Svevo “La conciencia de Zeno”

La solución pragmática a la paradoja de Zeno es, por supuesto, sólo seguir adelante y dejar que sus piernas decidan y hagan el trabajo por si mismo. La cura para la parálisis de Zeno es la misma, empezar a caminar… hacer las pocas cosas necesarias para poder disponer de todos los artículos en Acceso Abierto. Para pasar A analizar las veinte P de Parálisis, que impiden que el 100% de loso artículos estén en abierto cada uno con sus soluciones y falsas ideas:

1. Permiso / Piratería : ” ¿Cómo voy a autoarchivar si es ilegal! “ 2. Prestigio : “¿Para qué voy a autoarchivar? !Carece del prestigio!” 3. Peer-Review : “¿Cómo es posible que los artículos de acceso abierto no estén revisados por pares?” 4. Promoción : “¿Para que voy a autoarchivar? si no va a contar para los sistemas de acreditación investigadora! ” 5. Preservación: “¿Para qué voy a autoarchivar si no va a perdurar para siempre, como el papel?” 6. Prioridad : “¿Cómo voy a perder tiempo en autoarchivar puedo perder prioridad para mi trabajo! “ 7. Plagio / Propiedad : “¿Para qué voy a autoarchivar?, ! Mi trabajo podría ser plagiado! “ 8. Privacidad / Patentes : “ ¿Para qué voy a autoarchivar?, !Mis ideas podrían ser robadas! “ 9. Paranoia : “¿Para qué voy a autoarchivar?, !Si a mi institución le gusta poseer el controlar mi trabajo! “ 10. Proliferación : “¿Para qué voy a autoarchivar?, ! Los usuarios no van a saber cuál es la versión auténtica!” 11. Paper-Glut (Superabundancia): : “¿Por qué habría de autoarchivar? Ya es bastante difíciles de encontrar el artículo para que esté en dos sitios!” 12. Precios : ” ¿Por qué debería autoarchivar? Todo lo que necesitamos es que las revistas tengan un precio adecuado “ 13. Pretty-Sitting : “¿Por qué debería autoarchivar? !Ya dispongo de acceso a todo lo que necesito! “ 14. Papyrofilia / Imprimir / PDF : ” ¿Por qué debería autoarchivar? Lo que necesitamos es artículos impresos! “ 15. Publishing’s Future: (Futuro de la publicación): ” ¿Por qué debería autoarchivar? Lo que necesitamos son revistas OA! “ 16. Publishers’ Future: (Futuro de los editores): ” ¿Cómo es posible autoarchivar? Perjudicaré a mi editor! “ 17. Professional Societies’ Future (Futuro de la sasociaciones profesionales) : ” ¿Para qué voy a autoarchivar? Se arruinará mi Sociedad Científica “ 18. Professional Future of Librarians (Futuro Profesional de Bibliotecarios) : ”¿Para qué voy a autoarchivar? Dejaré a los bibliotecarios sin trabajo!“ 19. Prioridades / Transpiración: “ ”¿Para qué voy a autoarchivar? !El auto-archivo es demasiado complicado y requiere mucho tiempo y no dispongo de tiempo para ello! “ Transcurridos 8 años de esta publicación y con datos de ROARMAP (Registry of Open Access Repository Material Archiving Policies) en 2014 más de 350 instituciones tienen algún tipo de mandato de autoarchivo.

Ver completo: Alonso-Arévalo, Julio Alfabetización en Comunicación Científica: Acreditación, OA, redes sociales, altmetrics, bibliotecarios incrustados y gestión de la identidad digital., 2014 . In Alfabetización informacional: Reflexiones y Experiencias, Lima (Perú) , Lima-Perú, 20 Y 21 de marzo del 2014.

Además Monográfico sobre

Literatura sobre el Impacto del Acceso Abierto