Anthropic. “Anthropic Economic Index: Tracking AI’s Role in the US and Global Economy.” Anthropic Research, 15 de septiembre de 2025. https://www.anthropic.com/research/economic-index-geography

El informe de Anthropic presenta el Economic Index, una herramienta que analiza cómo se utiliza Claude, su modelo de inteligencia artificial, en distintos países y estados de Estados Unidos. El objetivo es ofrecer una visión clara de los patrones tempranos de adopción de la IA y su impacto económico, explorando tanto diferencias geográficas como la evolución en los tipos de tareas realizadas.

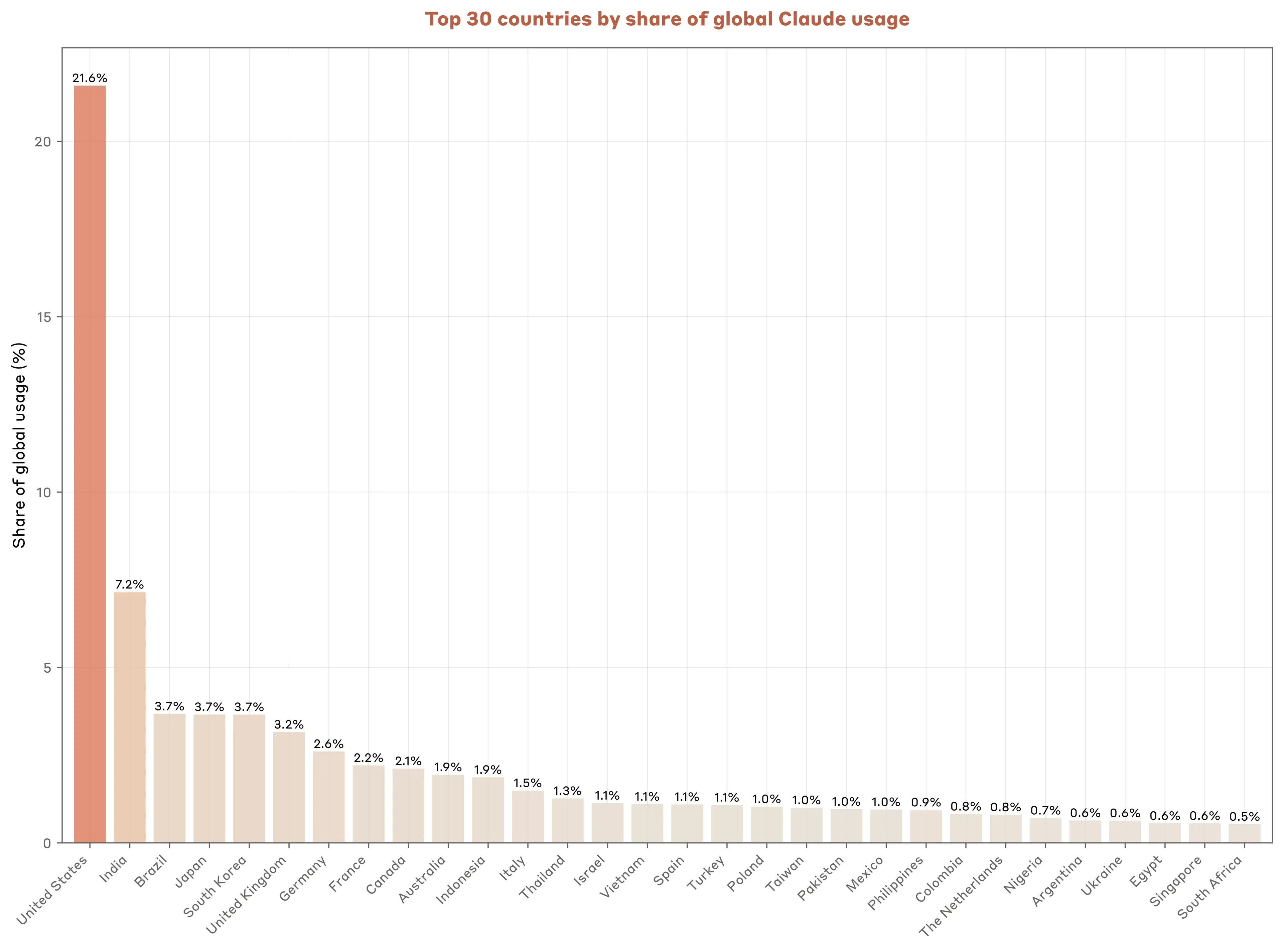

A nivel internacional, Estados Unidos lidera el uso total, seguido por India, Brasil, Japón y Corea del Sur. Sin embargo, al ajustar por población activa, países como Israel, Singapur, Australia y Nueva Zelanda muestran niveles de adopción proporcionalmente más altos. El índice revela una fuerte correlación entre el ingreso per cápita y el uso relativo de la IA, con los países de mayor desarrollo económico y conectividad digital a la cabeza.

Dentro de Estados Unidos, el mismo patrón se repite: los estados con mayor PIB per cápita presentan un uso más intensivo de la IA. El Distrito de Columbia lidera el índice estatal, destacando en tareas de edición y búsqueda de información, mientras que California se orienta más hacia la programación y Nueva York hacia las finanzas. Las economías locales influyen en el tipo de tareas: por ejemplo, en Hawái se observan más usos vinculados al turismo.

El estudio también muestra una transición hacia una mayor automatización. Entre diciembre de 2024 y mediados de 2025, las tareas automatizadas directivas crecieron del 27 % al 39 %, mientras que las de colaboración y apoyo (augmentación) disminuyeron. Esto sugiere que los usuarios confían cada vez más en que Claude ejecute tareas con menor supervisión.

Finalmente, se destacan diferencias entre el uso empresarial y el de consumidores. Los clientes de la API —principalmente empresas— priorizan la automatización y las tareas más costosas, como programación y matemáticas, mientras que los usuarios de Claude.ai mantienen un equilibrio mayor entre colaboración y automatización. En conjunto, el informe concluye que la adopción de la IA está marcada por la desigualdad económica, la especialización local y una creciente tendencia hacia la delegación de responsabilidades a los sistemas automatizados.