Sustainable Libraries Initiative. “Home.” Accessed April 5, 2026. https://www.sustainablelibrariesinitiative.org/

La Sustainable Libraries Initiative (SLI) es una iniciativa internacional orientada a capacitar a los profesionales de bibliotecas para integrar la sostenibilidad como eje central de su actividad. Su misión consiste en impulsar prácticas que sean ambientalmente responsables, socialmente equitativas y económicamente viables, contribuyendo así a comunidades más resilientes frente a desafíos como el cambio climático.

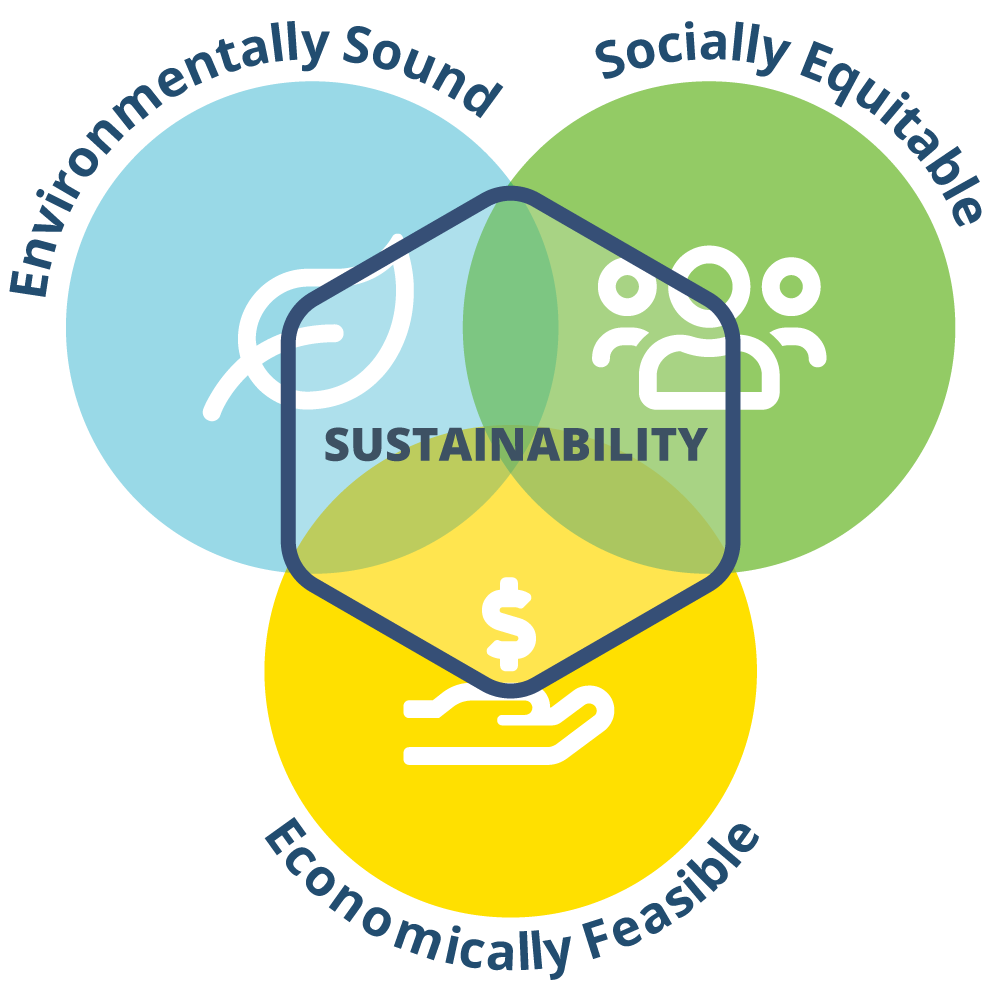

El proyecto surge del compromiso del sector bibliotecario por asumir un papel activo en la construcción de un futuro sostenible. Para ello, la SLI proporciona herramientas, recursos y metodologías que permiten a las bibliotecas incorporar la sostenibilidad en la toma de decisiones, en la gestión de recursos, en el diseño de servicios y en la creación de alianzas estratégicas. Este enfoque se basa en el denominado “triple balance” (triple bottom line), que articula las dimensiones ambiental, social y económica como pilares inseparables del desarrollo sostenible.

Uno de los principales instrumentos de la iniciativa es el Sustainable Library Certification Program (SLCP), que ofrece una hoja de ruta estructurada para que las bibliotecas implementen políticas y prácticas sostenibles en todos sus ámbitos: desde las instalaciones y operaciones hasta la programación cultural, la tecnología y la relación con la comunidad. Este programa no solo fomenta la mejora interna de las instituciones, sino que también refuerza su papel como agentes educativos y sociales capaces de promover la conciencia ambiental y la resiliencia comunitaria.

Además, la SLI promueve una comunidad de práctica en la que bibliotecarios de todo el mundo comparten experiencias, conocimientos y estrategias. En este contexto, la innovación no se entiende como una adopción tecnológica aislada, sino como un proceso colaborativo y progresivo que permite a las bibliotecas adaptarse a los cambios sociales y ambientales sin perder su identidad ni sus valores fundamentales.

En conjunto, la Sustainable Libraries Initiative redefine el papel de las bibliotecas en el siglo XXI, situándolas como actores clave en la transición hacia sociedades más sostenibles. Más allá de su función tradicional, las bibliotecas se consolidan como espacios de aprendizaje, acción y liderazgo en torno a los grandes retos globales.