Sample, Ian. “Quality of Scientific Papers Questioned as Academics ‘Overwhelmed’ by the Millions Published.” The Guardian, 13 de julio de 2025.

Acceso al artículo

Se analiza la creciente preocupación en la comunidad científica por el deterioro de la calidad de los artículos académicos, en un contexto de producción masiva de publicaciones. La cantidad de trabajos científicos ha aumentado de forma muy significativa en la última década —pasando de 1,71 millones en 2015 a 2,53 millones en 2024—, lo que ha generado una sobrecarga tanto en los investigadores como en los sistemas de revisión por pares.

El artículo parte de un episodio aparentemente anecdótico —un estudio científico acompañado de una imagen absurda generada por inteligencia artificial— para revelar un problema mucho más profundo: la crisis estructural de la publicación científica. Aquel trabajo, publicado en la revista Frontiers in Cell and Developmental Biology, se hizo viral no por su contenido, sino por un gráfico grotesco que ningún autor, editor ni revisor detectó como erróneo antes de su publicación. Su rápida retirada evidenció fallos graves en los mecanismos de control de calidad, pero sobre todo sirvió como síntoma de un sistema sometido a una presión sin precedentes.

Desde sus orígenes en el siglo XVII con la Royal Society y su revista Philosophical Transactions, la publicación científica ha sido el eje central de la construcción del conocimiento. En sus páginas se han formulado teorías fundamentales por figuras como Isaac Newton, Charles Darwin o Albert Einstein. Hoy, sin embargo, ese sistema no solo documenta la ciencia, sino que condiciona decisiones médicas, políticas y económicas de enorme impacto global. Precisamente por ello, cualquier deterioro en su fiabilidad tiene consecuencias que trascienden el ámbito académico.

El problema central es la explosión del volumen de publicaciones. En apenas una década, la producción científica ha crecido de forma vertiginosa, superando los tres millones de artículos anuales. Este aumento no responde únicamente a un progreso genuino del conocimiento, sino también a incentivos institucionales que premian la productividad cuantitativa. En el entorno académico del “publicar o perecer”, los investigadores ven sus carreras determinadas por el número de artículos y citas, lo que favorece prácticas como fragmentar resultados, priorizar estudios fáciles o exagerar conclusiones. Como advierte el investigador Mark Hanson, muchos trabajos no aportan nada realmente nuevo, pero siguen produciéndose porque el sistema así lo exige.

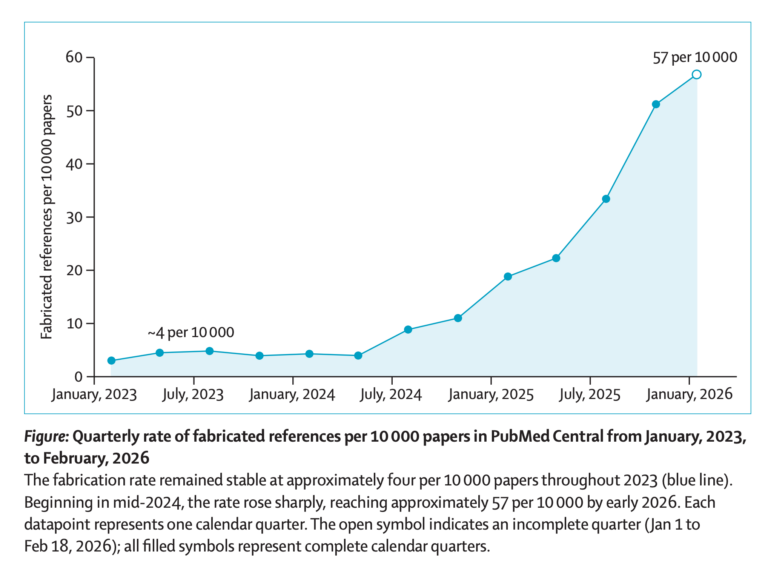

Esta sobreproducción tiene efectos directos sobre el proceso de revisión por pares, pilar tradicional de la calidad científica. La carga es tan elevada que los expertos dedican millones de horas a evaluar trabajos de forma voluntaria, lo que dificulta mantener estándares rigurosos. En este contexto, errores, fraudes o contenidos generados por inteligencia artificial pueden pasar desapercibidos con mayor facilidad. Según Venki Ramakrishnan, premio Nobel, el sistema es ya “insostenible”, aunque no exista un consenso claro sobre cómo reformarlo.

A estos problemas se suma el modelo económico de la publicación científica. Grandes editoriales como Elsevier o Springer Nature han consolidado un sistema en el que los propios investigadores —financiados con fondos públicos— producen y revisan el conocimiento, mientras las editoriales obtienen beneficios mediante suscripciones o tasas de acceso abierto. Este último modelo, aunque amplía la difusión, introduce un incentivo perverso: cuanto más se publica, más ingresos se generan. Algunas editoriales, como MDPI, han multiplicado los números especiales de sus revistas, lo que incrementa el volumen de artículos y, con ello, las dudas sobre su calidad.

El resultado es un ecosistema saturado en el que proliferan fenómenos preocupantes: retractaciones en aumento, revistas depredadoras que aceptan cualquier contenido a cambio de pago, fábricas de artículos fraudulentos y el uso creciente de inteligencia artificial para generar textos científicos. Todo ello contribuye a “contaminar” la literatura académica y pone en riesgo la confianza pública en la ciencia.

Sin embargo, varios expertos coinciden en que el mayor problema no es el fraude, sino la abundancia de investigaciones irrelevantes: trabajos técnicamente correctos pero carentes de interés o utilidad real. El físico Andre Geim subraya que muchas comunidades científicas tienden a perpetuarse incluso cuando sus líneas de investigación han dejado de ser productivas, impulsadas por inercias económicas y emocionales.

Ante este panorama, se plantean diversas vías de reforma. Algunas propuestas apuntan a cambiar los incentivos del sistema —priorizando la calidad sobre la cantidad—, fomentar la publicación en revistas sin ánimo de lucro o limitar el uso indiscriminado de la revisión por pares. También se reconoce que la tecnología, incluida la inteligencia artificial, podría formar parte de la solución, ayudando a filtrar, analizar y sintetizar el enorme volumen de información disponible.

En definitiva, el artículo dibuja un escenario en el que la ciencia, paradójicamente, corre el riesgo de verse debilitada por su propio crecimiento. La acumulación masiva de conocimiento no garantiza su valor; al contrario, puede diluirlo. El reto no es producir más ciencia, sino asegurar que la que se produce siga siendo relevante, rigurosa y fiable.