Elías Sanz-Casado (Coord.) Actividad investigadora de las universidades españolas. Informe IUNE 2018. Alianza 4 Universidades, 2018

Texto completo

El Informe IUNE 2018 analiza la actividad científica de las universidades españolas

en la década 2007-2016. El estudio se realiza desde distintas dimensiones, con la

finalidad de conocer en profundidad la actividad investigadora y tecnológica de las

universidades que conforman el Sistema Universitario Español (SUE).

El Observatorio IUNE es el resultado del trabajo realizado por un grupo de investigadores pertenecientes a las universidades que integran la “Alianza 4U”: Universidad Carlos III de Madrid, Universidad Autónoma de Madrid, UniversitatAutònoma de Barcelona y Universitat Pompeu Fabra.

La creación y desarrollo del Observatorio IUNE ha sido posible gracias a la financiación recibida por los ministerios de Ciencia e Innovación y de Educación. El Ministerio de Educación, Cultura y Deporte firmó un convenio con la Alianza 4U para el apoyo al Observatorio IUNE. Este es el informe correspondiente al periodo 2007-2016 que se elabora anualmente, a partir de los datos del Observatorio IUNE.

El análisis de las dimensiones de la actividad científica e investigadora de las universidades españolas en el período 2007-2016 permite obtener las siguientes conclusiones:

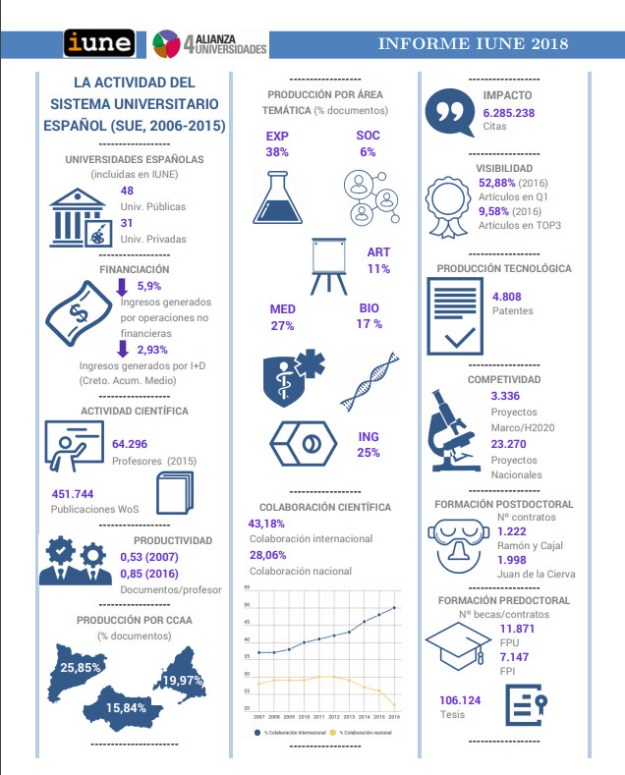

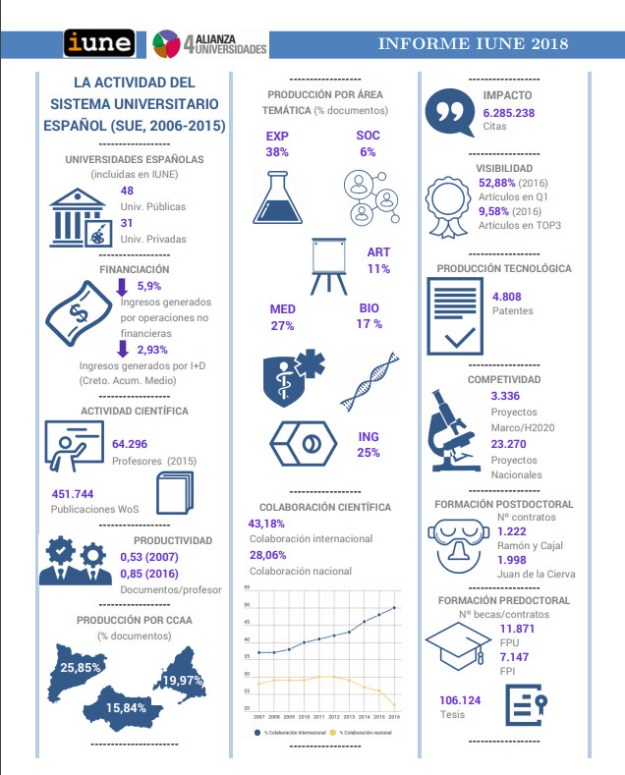

• La evolución de los ingresos liquidados por operaciones no financieras muestra una bajada importante en la financiación de las universidades españolas, pasando de 9.814 millones de euros en 2008 a 9.228 en 2016, con un descenso de un 6%.

• Los ingresos generados por la investigación en las universidades españolas también han tenido una caída importante, ya que han pasado de 1.312 millones de euros en 2008 a 1.098 millones en 2016, lo que ha supuesto una pérdida de un 16,31.

• Por los que respecta a los recursos humanos, el promedio de profesores para este período ha sido de 62.837. No han crecido significativamente las plantillas desde 2007, ya que se ha pasado de 59.925 profesores en ese año (2007) a 64.296 (2016).

• El número total de publicaciones del SUE recogida en la base de datos Web of Science (WoS) ha sido de 451.744 documentos, pasando de 31.690 publicaciones (2007) a 54.764 (2016), un 72,81% más.

• Las universidades con un mayor número de documentos en la base de datos WoS

son: Universitat de Barcelona (UB) con un 9,84% del total del SUE, la Universitat Autònoma de Barcelona (UAB) con 8,21%, y la Universidad Complutense de Madrid (UCM) con 6,7%.

• Sin embargo, si analizamos las publicaciones por profesor, destaca la Universitat Pompeu Fabra (UPF) con una media anual de 3,20 docs/profesor, seguida de la Universitat Autònoma de Barcelona (UAB) con 2,42 docs/profesor.

• La productividad del SUE en la década analizada es de 0,72 documentos por profesor/año. Esta productividad ha aumentado en el período, pasando de 0,53 (2007) a 0,85 (2016). El crecimiento acumulativo medio de la productividad asciende a 5,39%.

• Respecto a la producción científica por CCAA, Cataluña aportó un 25,85% al total del SUE, seguida de la Comunidad de Madrid con un 19,97% y Andalucía con un 15,84%.

• Desagregando los datos por área temática, es Ciencias Experimentales (EXP) la más productiva con un 37,47% del total. Le siguen Medicina y Farmacología (MED) e Arquitectura, Ingeniería y Ciencias de Computación (ING) con 27,36% y un 25,4%, respectivamente. Ciencias Sociales y Humanidades (SOC) aportan un 10,67%, y Arte (ART) un 5,97% a la producción total del SUE, siendo las áreas peor representadas en esta base de datos.

• Un 43,18% de la producción total del SUE se firmó en colaboración internacional frente a un 28,06% en colaboración nacional. En cuanto a la evolución de la colaboración, es la internacional la que mayor crecimiento acumulativo muestra para todo el período (9,88%), seguida de un 3,65% en los documentos sin colaboración y un 3,43% en el caso de la colaboración nacional.

• Estados Unidos sigue siendo el país con el que las universidades españolas mantienen una mayor colaboración, con un 21,72% sobre el total de la producción en colaboración internacional, seguido de Alemania (15,84%) y Reino Unido (15,73%).

• Las universidades españolas con mayor impacto considerando el número de citas recibidas en el decenio analizado, son la Universitat de Barcelona (13,35% del SUE), Universitat Autònoma de Barcelona (10,63% del SUE) y Universidad Autónoma de Madrid (7,5% SUE). En cuanto al impacto relativo (citas/profesor) son la Universitat Pompeu Fabra (UPF) con 64,03 citas/profesor y la Autónoma de Barcelona (UAB) con 43,62 citas/ profesor las que lideran este indicador.

• En términos de visibilidad, el SUE publicó un 52,88% de su producción científica en revistas del primer cuartil (Q1) en 2016. La evolución temporal de este indicador muestra un crecimiento acumulativo medio de un 7,40%. En cuanto al porcentaje de documentos publicados en las tres primeras revistas de cada categoría (TOP3), el 9,58% de la producción total del SUE se publicó en estas revistas con mejor factor de impacto.

• Respecto a actividad innovadora, el número de patentes del SUE muestra un incremento de un 104,69% en el decenio (de 279 a 529 patentes de 2007 a 2016). Destacan con mayor actividad patentadora la Universidad Politécnica de Madrid (UPM) con 359 patentes y la Universitat Politècnica de Catalunya (UPC) con 333 patentes para todo el período.

• El análisis de la competitividad, mediante los proyectos nacionales y europeos, muestra diferencias importantes: mientras que los primeros muestran un caída de un 12,65% en el período, los segundos se han incrementado un 53,01%.

• Las Universidades que destacan en obtención de proyectos europeos son las Politécnicas de Madrid y Cataluña con 332 (9,95%) y 233 proyectos (7%), respectivamente. Cuando se considera el número de proyectos por cada 100 profesores, ocupa el primer lugar la Universitat Pompeu Fabra (UPF) con 5,88 la Universitat Politècnica de Catalunya (UPC) con 1,66, y Universidad Carlos III de Madrid con 1,59 proyectos/ 100 profesores.

• Respecto a la dimensión de atracción y formación de talento, en el decenio se han concedido un total de 1.998 contratos Juan de la Cierva y 1.222 contratos Ramón y Cajal. Por su parte en lo que se refiere a becas/contratos predoctorales, el SUE consiguió un total de 11.871 FPU y 7.147 FPI.