Trend Report 2024: Survey Results

4 September 2024

PDF

El Informe de Tendencias 2024, la IFLA llevó a cabo una encuesta para recopilar perspectivas sobre los impactos de las tendencias identificadas y sus interconexiones. Los resultados de esta encuesta respaldarán la definición de escenarios en el informe completo.

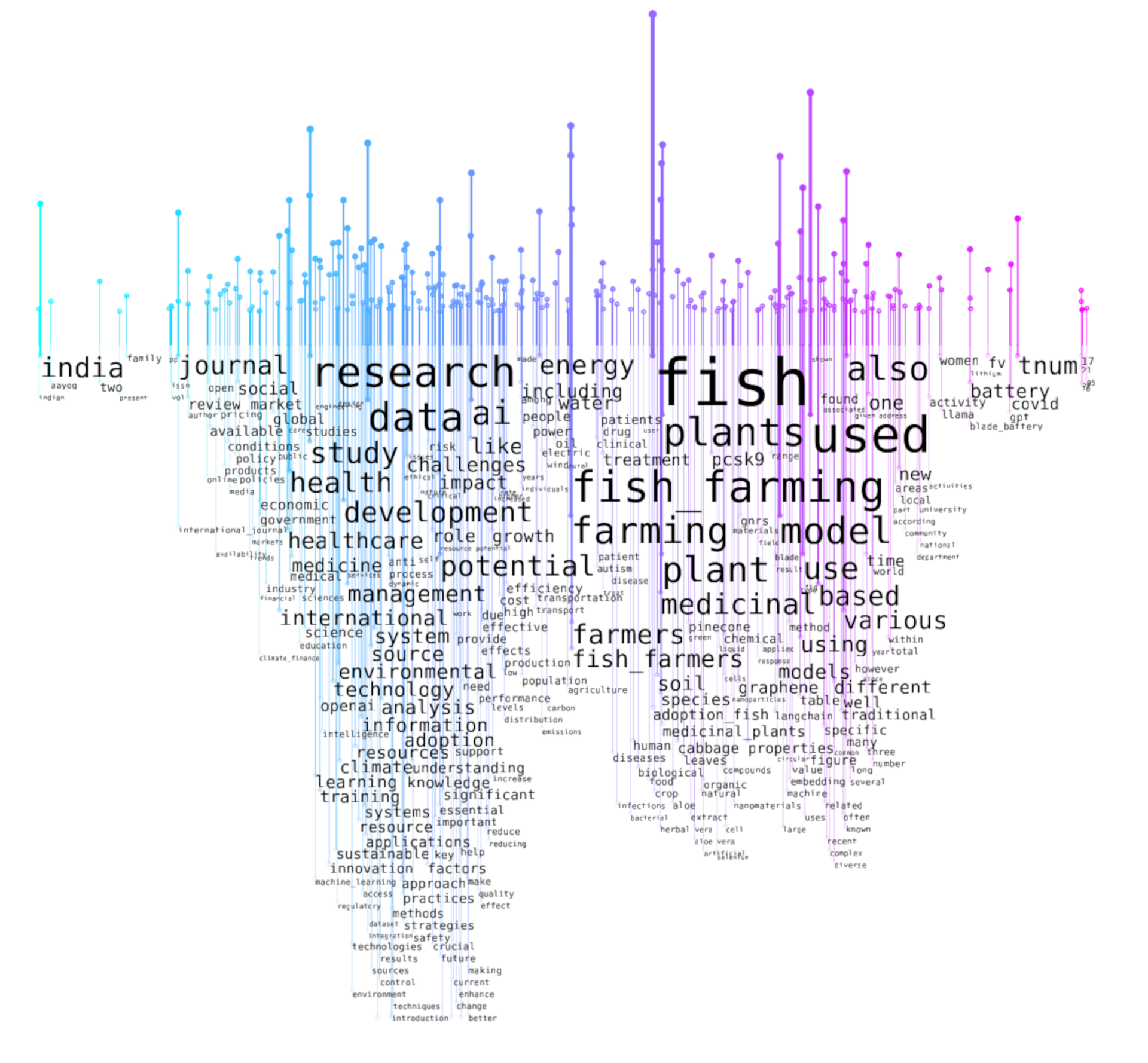

Este informe presenta los resultados de la encuesta de IFLA sobre las tendencias identificadas en la Revisión de Literatura del Informe de Tendencias 2024. Destaca las perspectivas sobre los impactos de diversas tendencias en las sociedades, bibliotecas y la demanda de servicios bibliotecarios a nivel global, por región, nivel de experiencia y tipo de biblioteca. Además, resalta las conexiones más fuertes entre tendencias, especialmente en las prácticas de conocimiento cambiantes, tendencias tecnológicas, la renegociación de la confianza y la equidad digital.

Después de la publicación de la Revisión de Literatura del Informe de Tendencias, IFLA realizó una encuesta a través de listas de correo y redes sociales, con el objetivo de reflexionar sobre las tendencias presentadas y identificar las intersecciones entre ellas que la comunidad considera más probables.

La encuesta ayudará a desarrollar la siguiente fase del informe, que incluirá una serie de escenarios que establecen futuros potenciales para el conocimiento y la información, como base para preparar el futuro.

Las tendencias clave identificadas son:

Las personas buscan conexiones comunitarias, y los espacios para compartir son clave.

Las prácticas de conocimiento están cambiando, lo que ofrece tanto oportunidades como desafíos para la equidad en los sistemas de conocimiento.

La IA y otras tecnologías están transformando la sociedad y cómo creamos, compartimos y utilizamos la información.

La confianza está siendo renegociada, especialmente en los gobiernos y los medios de comunicación.

Las habilidades y capacidades se están volviendo más complejas, pero también esenciales.

Las tecnologías digitales y sus beneficios están distribuidos de manera desigual.

Los sistemas de información están utilizando más recursos, lo que impacta al planeta.

La encuesta estuvo abierta entre el 9 y el 29 de agosto de 2024 y se dividió en dos partes clave. La primera parte se centró en recopilar opiniones sobre cuán positivas o negativas serían las 7 tendencias para:

- La sociedad en su conjunto

- Las bibliotecas en general

- La biblioteca del propio encuestado

- La necesidad de las bibliotecas

El objetivo era captar el nivel de optimismo de los encuestados sobre las tendencias, que pueden tener tanto aspectos positivos como negativos. También se buscaba estimular la reflexión sobre la diferencia entre la situación macro (para la sociedad o las bibliotecas en general) y la situación más directa en la biblioteca del encuestado. Al preguntar sobre la necesidad de las bibliotecas, se pretendía entender cómo los encuestados prevén la evolución de la demanda de servicios bibliotecarios.

La segunda parte examinó, para cada tendencia considerada importante, qué tan fuerte era la relación con las otras tendencias. Esto ayudaría a identificar áreas interesantes para definir escenarios.

Además, se recopilaron datos sobre el tipo de encuestado (individuo, asociación/institución o unidad de IFLA), la región donde están ubicados, sus años de experiencia en el campo bibliotecario y el tipo de biblioteca donde trabajan. Esto permite explorar si las prioridades varían entre estos grupos.

En la mayoría de los casos, las preguntas se formularon utilizando una escala de muy positivo (5) a muy negativo (1), o de muy fuertemente conectado (4) a no conectado en absoluto (1). Los encuestados podían optar por no responder, y sus respuestas no fueron consideradas para no influir en los promedios utilizados.