Oladipo, Gloria. «Most Banned Books Feature People of Color and LGBTQ+ People, Report Finds.» The Guardian, February 27, 2025. https://www.theguardian.com/us-news/2025/feb/27/banned-books-people-of-color-lgbtq

Un estudio de PEN America ha revelado que la mayoría de los libros prohibidos en las escuelas públicas de EE. UU. durante el año escolar 2023-2024 trataban sobre personas de color, personas LGBTQ+ y otras demografías. El informe también refuta las afirmaciones de legisladores conservadores de que los libros prohibidos eran explícitamente sexuales, argumentando que, en realidad, el foco principal de la censura fue la representación de identidades marginadas.

Hubo más de 10.000 casos de libros prohibidos en el año escolar 2023-24, según PEN America, un aumento considerable respecto al año anterior, ya que los estados dirigidos por republicanos implementaron nuevas leyes de censura.

De los 4.218 títulos de libros prohibidos, 1.534, o el 36%, presentaban a personas de color, el grupo más censurado en las prohibiciones de libros. Algunos de los títulos retirados incluían la obra Fences, ganadora del Pulitzer de August Wilson, y el libro infantil A is for Activist de Innosanto Nagara, que trata sobre problemas sociales.

El informe encontró que los libros que presentaban a personas de color fueron desproporcionadamente atacados en todas las categorías de libros prohibidos, especialmente en los títulos históricos y biográficos eliminados. De esos libros prohibidos, el 44% incluían a personas de color; más de una cuarta parte, o el 26%, de esos libros presentaban a personas negras.

Los defensores de PEN America señalaron que, al mismo tiempo que se multiplicaban las prohibiciones de libros, más del 50% de los jóvenes en EE. UU. son niños de color, según datos de 2021 de la Children’s Defense Fund.

«Esta censura dirigida equivale a un ataque dañino a las poblaciones históricamente marginadas y subrepresentadas, un esfuerzo peligroso por borrar sus historias, logros e historia de las escuelas», dijo Sabrina Baêta, gerente senior del programa Freedom to Read de PEN America, en un comunicado de prensa sobre el informe. «Cuando despojamos a las estanterías de las bibliotecas de libros sobre ciertos grupos, estamos derrotando el propósito de una colección bibliográfica que debe reflejar la vida de todas las personas. Las consecuencias dañinas para los jóvenes son reales».

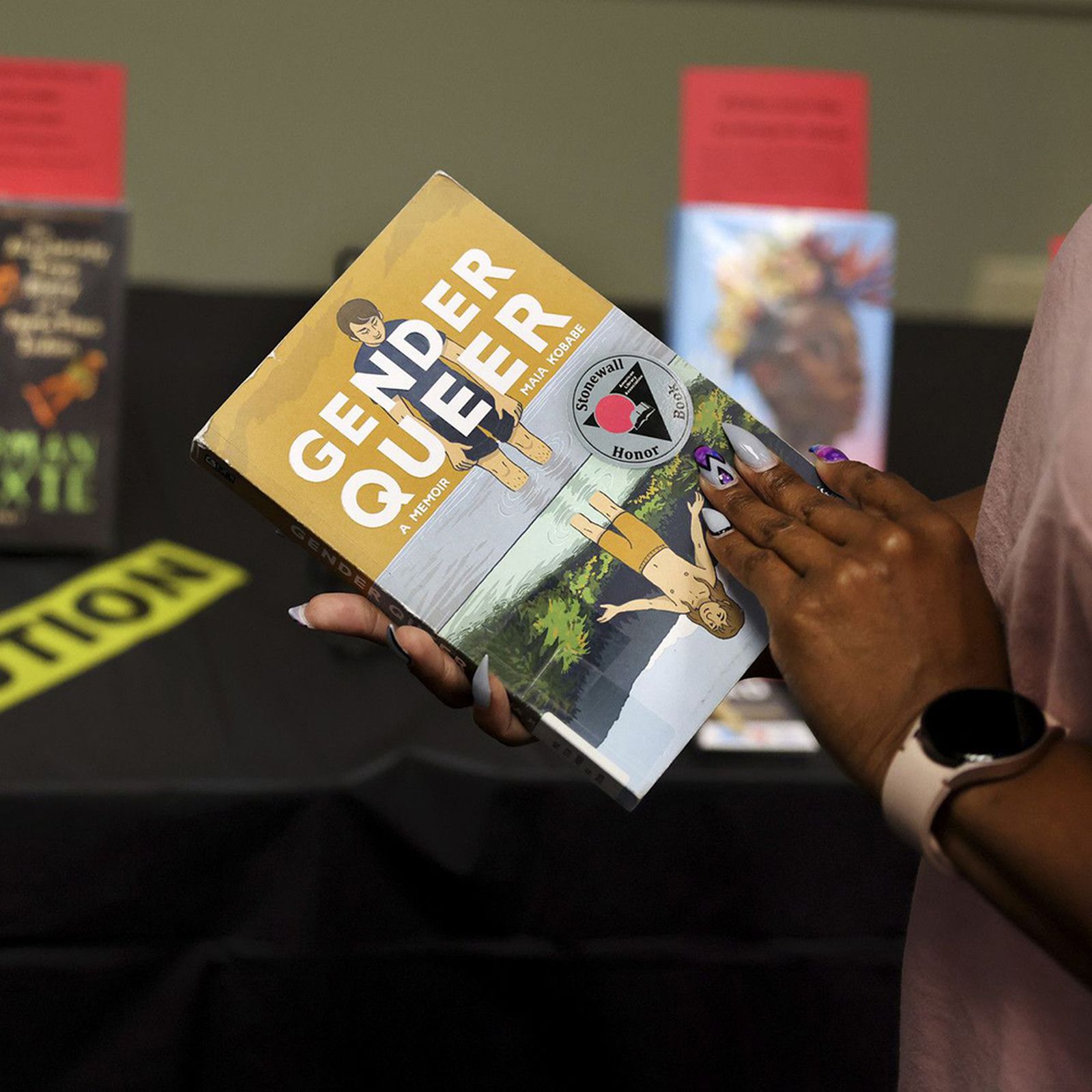

Los títulos que presentaban personajes LGBTQ+ también representaron una proporción considerable de las prohibiciones de libros: 1,066 libros, o el 25% de todos los títulos prohibidos, incluían personas LGBTQ+. Los personajes transgénero o genderqueer fueron específicamente atacados en estas prohibiciones de libros, ya que el 28% de los libros retirados que presentaban personajes LGBTQ+ incluían a esa demografía.

Más allá de las personas de color y las personas LGBTQ+, los libros que incluían personas con discapacidades también fueron afectados por las prohibiciones a nivel nacional. Aproximadamente el 10% de todos los títulos retirados incluían personajes con discapacidades físicas, de aprendizaje o del desarrollo, o que eran neurodivergentes. Varios de los libros afectados con personajes discapacitados se centraron en temas como «confianza, autoestima o experiencias con el capacitismo», según informó PEN America.

Mientras tanto, solo el 13% de los títulos eliminados incluían experiencias sexuales «en la página». Las experiencias sexuales implícitas o «fuera de la página» fueron mencionadas en el 31% de los libros prohibidos.

La gran mayoría de los libros prohibidos (85%) eran ficción, con un 14% de no ficción y un 1% de poesía. Aproximadamente el 67% de los libros eliminados eran para audiencias más jóvenes, según el informe de PEN America.

La continua prohibición de libros ocurre en un contexto en el que la administración Trump ha intensificado la represión de los esfuerzos de diversidad, equidad e inclusión (DEI) en las escuelas y universidades públicas de EE. UU. En un memorándum de la semana pasada, Trump amenazó con retener fondos federales de cualquier escuela que se negara a eliminar iniciativas de diversidad, como becas para estudiantes de ciertos grupos de identidad y programas escolares.