Jo Marchant, «How AI is Unlocking Ancient Texts — and Could Rewrite History,» Nature (October 18, 2023). https://www.nature.com/articles/d41586-024-04161-z.

La inteligencia artificial (IA) está revolucionando el estudio de textos antiguos, permitiendo a los investigadores acceder a información que ha permanecido inaccesible durante siglos. Desde pergaminos carbonizados por la erupción del Vesubio hasta tabletas de escritura cuneiforme desmoronadas, los avances en redes neuronales están proporcionando a los estudiosos datos valiosos que podrían redefinir nuestra comprensión de la historia antigua.

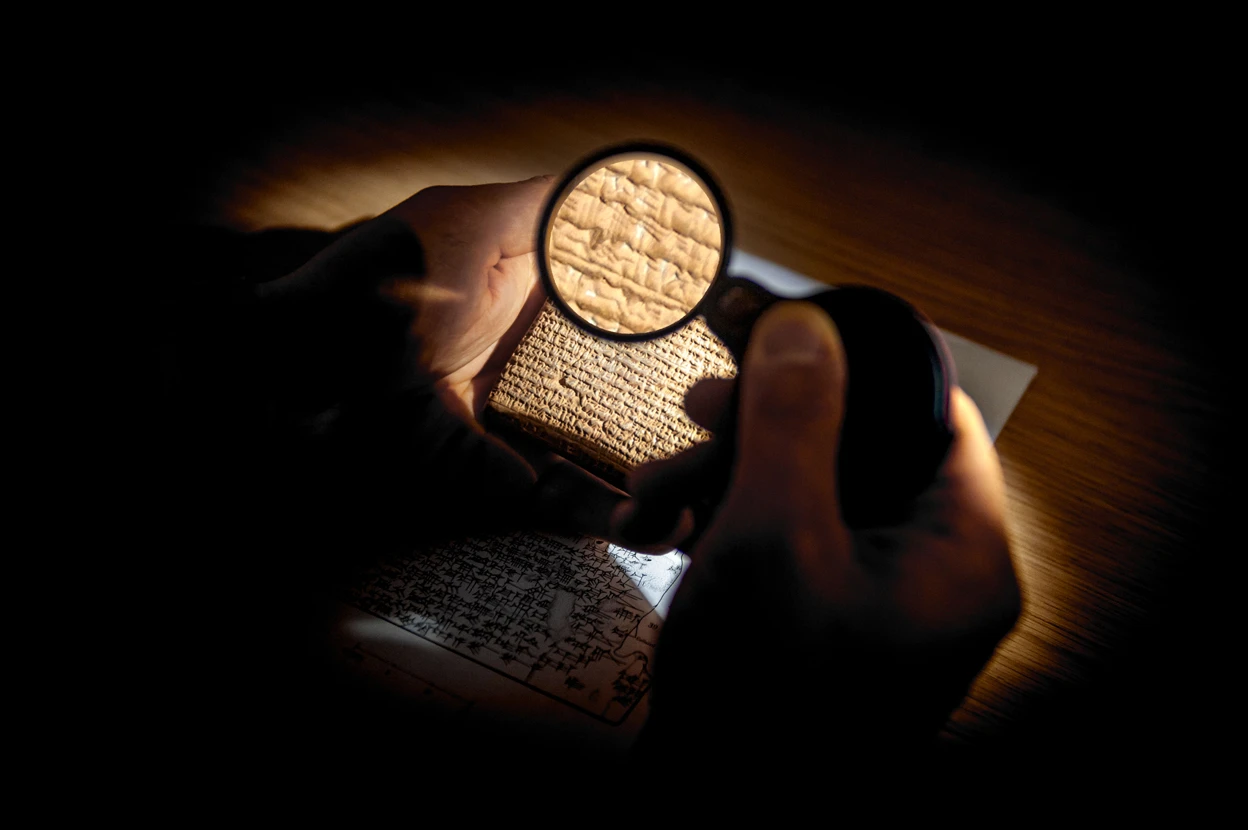

En octubre de 2023, Federica Nicolardi, papirologista de la Universidad de Nápoles, recibió un correo electrónico con una imagen que transformaría su investigación. Mostraba un fragmento de un pergamino quemado durante la erupción del Vesubio en el año 79 d.C., que hasta entonces había sido ilegible. Este descubrimiento fue posible gracias al proyecto Vesuvius Challenge, que utiliza técnicas avanzadas de IA para revelar el contenido de estos textos carbonizados. Con el uso de redes neuronales, los investigadores han logrado leer líneas completas de textos griegos que habían estado inaccesibles durante 2,000 años.

El proyecto del Vesubio es solo un ejemplo de cómo las redes neuronales están redefiniendo el estudio de textos antiguos. Estas tecnologías se están utilizando para descifrar lenguas clásicas como el griego y el latín, así como lenguajes menos conocidos como el Script de Hueso de Oráculo de China. Los modelos de redes neuronales están ayudando a interpretar archivos demasiado vastos para que los humanos los lean, completando caracteres faltantes y descifrando lenguas raras y perdidas.

La colaboración entre historiadores antiguos y científicos informáticos ha dado lugar a modelos como Pythia e Ithaca, que pueden sugerir palabras o caracteres faltantes en inscripciones griegas. Estas herramientas no solo aceleran tareas tediosas, sino que también permiten realizar conexiones que antes eran imposibles para los especialistas humanos. Por ejemplo, Ithaca ha demostrado ser capaz de restaurar textos antiguos con una precisión del 62%, superando el 25% de los expertos humanos y elevando esa precisión al 72% cuando los expertos utilizan las sugerencias de IA.

En Corea del Sur, los investigadores están utilizando redes neuronales para abordar uno de los archivos históricos más grandes del mundo: los registros detallados de los reyes coreanos, que datan desde el siglo XIV hasta el XX. Estos registros están escritos en Hanja, un sistema de escritura basado en caracteres chinos antiguos. Las técnicas de IA están acelerando la traducción de estos textos a un ritmo que de otro modo llevaría décadas.

El éxito en la lectura de los pergaminos de Herculano es solo el comienzo. Los investigadores están explorando la posibilidad de utilizar estas técnicas en otros textos inaccesibles, como los manuscritos egipcios antiguos y los papiros de Petra, Jordania. Sin embargo, este flujo de nuevos datos plantea desafíos éticos y metodológicos. ¿Cómo se garantiza la precisión y la reproducibilidad en el análisis de estos textos? ¿Quién debería tener acceso a estos datos?

Los expertos enfatizan la necesidad de trabajar en equipos multidisciplinarios que incluyan a especialistas en humanidades y ciencias computacionales. Además, proponen que todos los datos, incluidos los textos sin procesar y los algoritmos utilizados, se hagan de código abierto para garantizar la transparencia y la confianza en los resultados.

La IA está proporcionando a los papirologistas y otros especialistas en estudios antiguos herramientas sin precedentes para acceder a textos históricos. Esta tecnología no solo está haciendo su trabajo más importante que nunca, sino que también está planteando nuevas preguntas y posibilidades para la investigación histórica. A medida que los algoritmos de IA continúan evolucionando, el potencial para descubrir y entender textos antiguos nunca antes leídos se está convirtiendo en una realidad emocionante para el campo de las humanidades.

Este resumen amplía el artículo original, proporcionando un panorama detallado de cómo la IA está revolucionando la forma en que los investigadores abordan los textos antiguos, destacando los proyectos clave, los avances tecnológicos, los desafíos éticos y las colaboraciones interdisciplinarias necesarias para aprovechar al máximo estas innovaciones.