Cappelle, Frank van. «AI Has Huge Potential to Support Teachers, Not Replace Them». ThePrint (blog), 21 de octubre de 2023. https://theprint.in/tech/ai-has-huge-potential-to-support-teachers-not-replace-them/1813903/.

La IA encierra un enorme potencial para la educación mediante la colaboración con los gobiernos, la sociedad civil, el sector privado y otros socios.

Los avances recientes en inteligencia artificial (IA) han generado un creciente interés en el impacto potencial que puede tener en la educación. Como cualquier tecnología, la IA presenta oportunidades y desafíos. Desafortunadamente, avances previos en tecnología a menudo han favorecido a los privilegiados, exacerbando las desigualdades en la educación y otros sectores. ¿Seguirá la IA el mismo camino? ¿O tiene el potencial de reducir las desigualdades educativas y transformar el aprendizaje para los más marginados?

Al considerar el impacto más amplio de la IA en la educación, no hay duda de que será transformadora, es solo cuestión de tiempo. Muchos líderes en educación y tecnología han opinado sobre el potencial, así como las trampas, de la IA en la educación. Bill Gates, por ejemplo, cree que pronto las herramientas de IA podrán ayudar a los niños a aprender a leer y escribir. Por otro lado, muchos críticos han condenado el uso de la IA, señalando que ayuda a los estudiantes a hacer trampa, puede entregar resultados sesgados, incluido el sesgo de género, y tiende a cometer errores y presentarlos como hechos.

Sin embargo, debemos ser realistas acerca del impacto global. Aunque casi todos los países implementaron plataformas de aprendizaje digital durante la pandemia de COVID-19, la investigación de UNICEF sobre Pulse Check on Digital Learning reveló que un tercio de esas plataformas ya no se mantienen o actualizan, y la gran mayoría carece de contenido interactivo. Transformar estas plataformas de repositorios de contenido de aprendizaje en plataformas interactivas, y mucho menos integrar soluciones impulsadas por IA, requiere un esfuerzo y una inversión significativos.

Algunos gobiernos están comprometidos en transformar digitalmente sus sistemas educativos a un ritmo rápido, incluida la prueba de soluciones de IA. A través de la iniciativa Gateways to Public Digital Learning, UNICEF, en colaboración con la UNESCO, está trabajando con estos países pioneros en África, Asia, América Latina y otras partes del mundo para compartir mejores prácticas y soluciones. El objetivo es mostrar el potencial de la educación digital innovadora para transformar la educación y convertir el aprendizaje digital en un bien público, de acceso gratuito para todos.

El uso de la IA para ayudar a niños sin acceso a educación es una prioridad clave para UNICEF. A nivel global, 222 millones de niños se ven afectados por emergencias y crisis prolongadas; 244 millones de niños están fuera de la escuela y 1.000 millones de niños, casi la mitad de los niños del mundo, viven en países clasificados como «extremadamente alto riesgo» para los impactos del cambio climático. Las escuelas en estos países cierran con frecuencia debido a desastres naturales como inundaciones, huracanes y tormentas.

Cientos de millones de niños carecen de acceso a tabletas, computadoras o conectividad a Internet confiable en casa, lo que plantea desafíos para el aprendizaje en el hogar cuando las escuelas cierran. Para llegar a los más marginados a gran escala, debemos considerar cómo las soluciones que aprovechan la IA pueden funcionar en teléfonos inteligentes compartidos de bajo costo y funcionar sin conexión. También necesitamos soluciones de aprendizaje digital más y mejores para ayudar a los niños a adquirir habilidades de lectura básicas. Casi dos tercios de los niños de 10 años se estima que no pueden leer y comprender un texto simple. Las soluciones de IA, como ChatGPT, tienen poco uso para aquellos que aún no han aprendido a leer y escribir, a menos que incorporen reconocimiento de voz multilingüe.

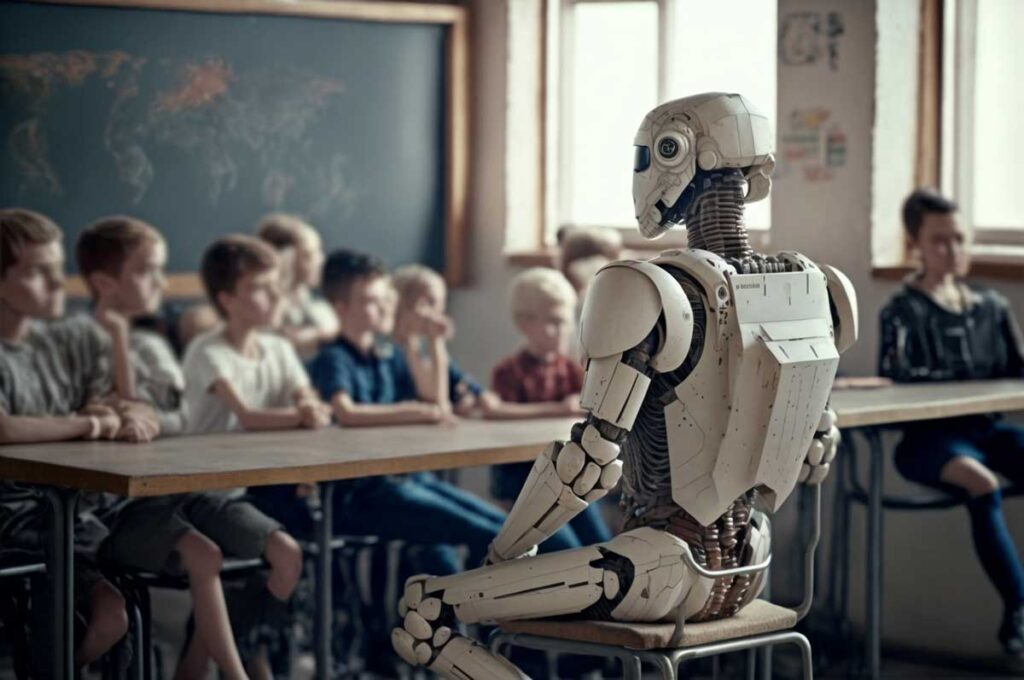

Independientemente de los avances en sistemas de tutoría de IA y otras tecnologías que respaldan el aprendizaje independiente, los maestros deben seguir siendo centrales en el proceso de aprendizaje. Esto también es cierto para el aprendizaje en el hogar durante el cierre de las escuelas. Nuestra investigación reveló que la frecuencia del contacto con los maestros se correlacionó significativamente con el aprendizaje durante la COVID-19. Entonces, vemos que la IA tiene un gran potencial para apoyar a los maestros, no para reemplazarlos.

La falta de acceso a dispositivos limita el potencial de la IA. En muchos países, menos de la mitad de las escuelas tienen dispositivos para el aprendizaje. En las escuelas con dispositivos, a menudo se comparten entre muchos estudiantes o solo están accesibles para los maestros. Sin embargo, el potencial aún es enorme. Las soluciones de IA pueden permitir experiencias de aprendizaje personalizadas incluso en dispositivos compartidos y ayudar a transformar las escuelas y las prácticas de enseñanza para centrarse más en el estudiante.

La falta de habilidades digitales también es una barrera clave para el uso de la tecnología. Existe una brecha digital de género significativa en términos de acceso a la tecnología, así como habilidades digitales, según la última investigación de UNICEF en 32 países y territorios; por cada 100 jóvenes varones con habilidades digitales, solo hay 65 jóvenes mujeres. La IA puede ayudar a los aprendices con baja alfabetización digital mediante la incorporación de características como el reconocimiento de voz y el procesamiento del lenguaje natural. También puede ayudar en la adquisición de habilidades digitales a través de sistemas adaptativos que se ajustan automáticamente a la alfabetización del aprendiz, así como a los niveles de alfabetización digital. Sin embargo, muchas de estas innovaciones tecnológicas están detrás de barreras de pago y están destinadas a dispositivos de alta gama. Se necesitan inversiones significativas y esfuerzos para hacerlas de acceso gratuito para todos.

Otra área crítica de enfoque para UNICEF es el aprendizaje digital accesible para niños con discapacidades. De los 240 millones de niños con discapacidades en todo el mundo, la mayoría carece de acceso a tecnologías inclusivas, materiales de aprendizaje accesibles y otros apoyos educativos esenciales.

La inteligencia artificial (IA) también puede marcar una diferencia sustancial en esta área. Aprovechar el reconocimiento de voz en diferentes idiomas y dialectos, la automatización del texto al lenguaje de señas y la ‘visión’ de ChatGPT para interpretar imágenes y diagramas podrían ser útiles. UNICEF ha estado trabajando durante varios años con gobiernos en el desarrollo de libros de texto digitales accesibles, pero hasta ahora ha sido un proceso costoso y que consume tiempo. Además, el aprendizaje personalizado que utiliza la IA para adaptarse a las habilidades e intereses del aprendiz puede beneficiar a los niños con discapacidades. UNICEF está trabajando actualmente con socios en una serie de consultas con especialistas en IA y discapacidad, investigadores y desarrolladores para idear soluciones escalables basadas en la IA para el aprendizaje accesible.

Para abordar la pregunta planteada en el título de este blog: ¿puede la IA transformar el aprendizaje para los más marginados? la respuesta es un rotundo sí. El tiempo dirá, sin embargo, si la IA reducirá o ampliará aún más las desigualdades. Inversiones significativas y un enfoque concertado en el diseño y desarrollo de soluciones para los más marginados son esenciales. Creemos firmemente que esta transformación es posible mediante la colaboración con gobiernos, la sociedad civil, el sector privado y otros socios. Juntos, podemos lograrlo.