Beale, R. (2025). In Memoriam: The Academic Journal (preprint). arXiv:2512.23915v1. Recuperado de https://arxiv.org/html/2512.23915v1

Se trata de un ensayo reflexivo que traza la historia, evolución y final simbólico de la revista académica tradicional considerando su impacto profundo en la ciencia, la sociedad y la cultura académica moderna.

El texto empieza con una evocación de los orígenes de las publicaciones científicas en el siglo XVII, destacando el papel pionero del Journal des Sçavans y de Philosophical Transactions, que establecieron el formato y la intención de los primeros medios de difusión científica impulsados por académicos para académicos. En estas primeras etapas, las revistas eran herramientas para compartir descubrimientos y avanzar el conocimiento colectivo, libre de intereses comerciales predominantes.

Beale describe cómo las revistas académicas ingresaron a su “edad adulta”, abrazando el sistema de revisión por pares y consolidándose como guardián de la calidad científica. Sin embargo, con la entrada de grandes editoriales comerciales tras la Segunda Guerra Mundial, este modelo se transformó bajo una lógica capitalista: académicos que generaban contenido y revisión sin remuneración, mientras las editoriales recibian beneficios sustanciales al vender acceso a ese conocimiento. Esta etapa marcó una transición crucial desde el propósito original de difusión científica hacia un sistema en el que las publicaciones se convirtieron en métricas de prestigio y progreso profesional, impulsadas por la filosofía de “Publicar o Perecer”.

En el desarrollo de la “madurez” de las revistas científicas, el autor ilustra cómo la proliferación de indicadores cuantitativos (factor de impacto, índice h, etc.) y el énfasis en méritos numéricos distorsionaron el valor de la investigación, priorizando la cantidad sobre la calidad y debilitando prácticas fundamentales como la replicación de resultados. Este enfoque paradigmático condujo a la expansión de unidades mínimas publicables (MPU) y a prácticas que, aunque eficientes para avanzar en carreras académicas, erosionaron la esencia del método científico.

Beale también sitúa a las revistas académicas dentro del contexto de las transformaciones tecnológicas de finales del siglo XX y principios del XXI, señalando cómo servicios como arXiv y las iniciativas de acceso abierto retaron el dominio tradicional de las publicaciones impresas. Aunque estos “descendientes” surgieron con filosofías más abiertas, la presión institucional por métricas de prestigio a menudo relegó su valor dentro de la evaluación profesional.

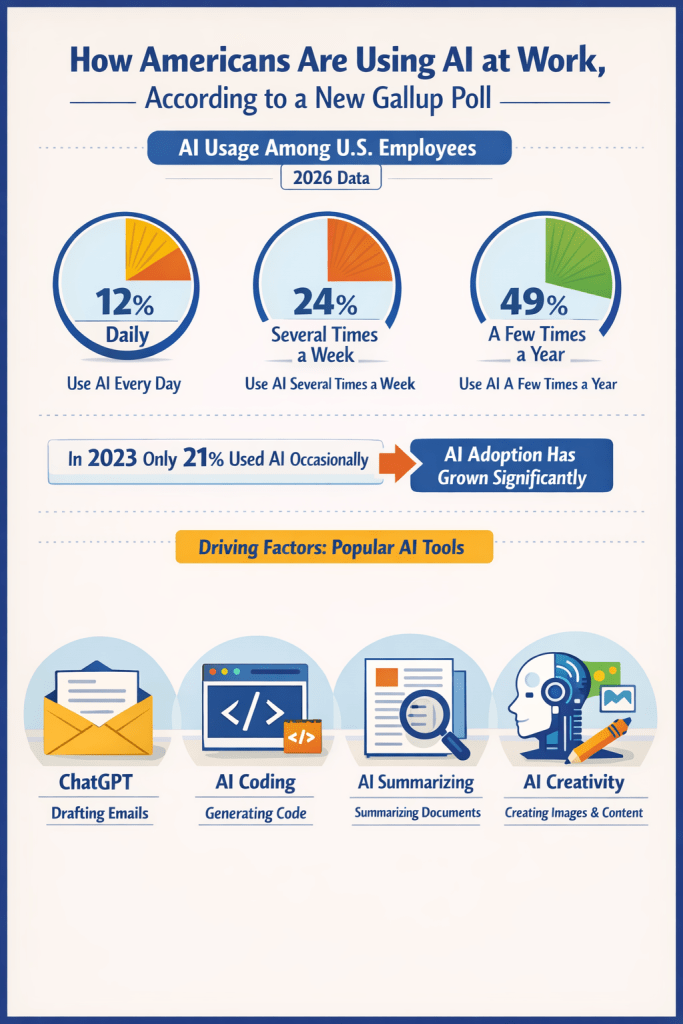

Finalmente, el ensayo culmina con la “muerte” simbólica de las revistas científicas el 1 de enero de 2026 —una metáfora que representa el agotamiento del modelo tradicional frente a la proliferación de contenidos generados y compartidos a gran escala, en parte facilitados por herramientas de inteligencia artificial como ChatGPT que erosionan las barreras de entrada del proceso editorial clásico. Esta conclusión lleva al lector a meditar sobre el legado de las revistas: celebradas por su rol en la sistematización del conocimiento, pero también criticadas por cómo se distanciaron de sus ideales fundacionales para convertirse en engranajes de una maquinaria profesional y comercial que, según el autor, ya no puede sostener de manera íntegra la misión original de la comunicación científica