Hardinges, Jack, Elena Simperl, y Nigel Shadbolt. 2023. «We Must Fix the Lack of Transparency Around the Data Used to Train Foundation Models». Harvard Data Science Review, diciembre. https://doi.org/10.1162/99608f92.a50ec6e6.

En el ámbito de la IA, los modelos, ya sean de aprendizaje supervisado, no supervisado o de otro tipo, necesitan ser alimentados con grandes cantidades de datos para aprender patrones y realizar tareas específicas. Abordar esta falta de transparencia es crucial para garantizar que la IA se desarrolle y utilice de manera ética y responsable. La transparencia en este proceso implica proporcionar información clara y completa sobre la naturaleza y la fuente de los datos utilizados en el entrenamiento de estos modelos. Sin embargo, en la mayoría de los casos, las empresas o desarrolladores no muestran de dónde compilan esta información, lo que puede tener consecuencias significativas en términos de ética, sesgo y confianza pública.

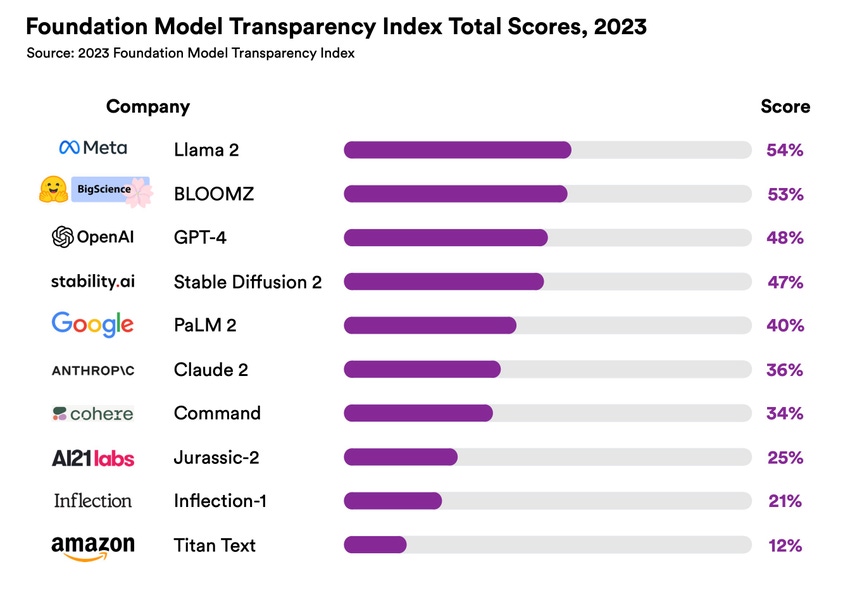

El estudio aborda la importancia del acceso a información sobre los datos utilizados en la formación de modelos de inteligencia artificial (IA). Aunque algunos sectores de la comunidad de IA han progresado, persiste una falta general de transparencia sobre el contenido y las fuentes de los conjuntos de datos de entrenamiento, ya sea por iniciativa voluntaria de las empresas o por intervención regulatoria, y esto debe cambiar.

Los modelos fundamentales se entrenan con grandes colecciones de datos, muchos de los cuales se recopilan de toda la web. La investigación del Instituto Allen de IA y The Washington Post sobre el popular conjunto de datos de entrenamiento C4 reveló que su contenido provenía de 15 millones de dominios web diferentes.

Conocer el contenido de los conjuntos de datos utilizados para entrenar modelos y cómo se han compilado es de vital importancia. Sin esta información, el trabajo de desarrolladores, investigadores y éticos para abordar sesgos o eliminar contenido perjudicial de los datos se ve obstaculizado. La información sobre los datos de entrenamiento también es crucial para que los legisladores evalúen si los modelos fundamentales han absorbido datos personales o material con derechos de autor. Además, los operadores previstos de los sistemas de IA y aquellos afectados por su uso son mucho más propensos a confiar en ellos si comprenden cómo se han desarrollado.

Sin embargo, algunas empresas no documentan el contenido de sus datos de entrenamiento, incluso internamente, por temor a encontrar información personal sobre individuos identificables, material con derechos de autor y otros datos obtenidos sin consentimiento.

En público, las empresas han utilizado diferentes argumentos para justificar la falta de transparencia en torno a sus datos de entrenamiento. OpenAI, en el lanzamiento de su modelo GPT-4, declaró que no compartiría información detallada sobre la «construcción del conjunto de datos» y otros aspectos del desarrollo del modelo debido al «panorama competitivo y las implicaciones de seguridad de los modelos a gran escala». Aunque algunas empresas han publicado los datos de ajuste fino, tienden a omitir los conjuntos de datos de entrenamiento más grandes y complejos que son más propensos a contener contenido perjudicial o material con derechos de autor.

Partes de la comunidad de IA han avanzado en la transparencia de los datos de entrenamiento. La plataforma Hugging Face, inspirada en los pioneros de la seguridad de la IA Emily Bender, Batya Friedman y Timnit Gebru, promueve el uso de Model Cards y Dataset Cards entre su comunidad de desarrolladores. Las Dataset Cards documentan cómo se creó un conjunto de datos, su contenido y posibles problemas legales o éticos asociados.

En julio de 2023, la Casa Blanca anunció que siete grandes empresas de IA se comprometieron a «desarrollar medidas técnicas sólidas para garantizar que los usuarios sepan cuándo el contenido es generado por IA, como el marcado de agua». Dado que los modelos fundamentales de IA han comenzado a entrenarse con datos generados por IA, estas herramientas desempeñarán un papel importante en documentar la procedencia de los datos de entrenamiento y la integridad de las salidas resultantes de la IA.

Las decisiones sobre qué documentar sobre los datos de entrenamiento podrían eventualmente salir de las manos de los desarrolladores. La Comisión Federal de Comercio de EE. UU. ha ordenado recientemente a OpenAI que documente todas las fuentes de datos utilizadas para entrenar sus grandes modelos de lenguaje. Un grupo de grandes medios de comunicación ha publicado una carta abierta instando a los legisladores de todo el mundo a introducir nuevas regulaciones que exijan transparencia en los conjuntos de datos de entrenamiento.

Se prevé que la demanda de información sobre los datos de entrenamiento sea la última ola en un esfuerzo continuo por la transparencia empresarial. En el Reino Unido, las leyes sobre el registro obligatorio y la publicación de información por parte de las empresas se remontan al siglo XIX, y a lo largo del tiempo, los reguladores han desarrollado enfoques estandarizados para evitar que cada empresa elija su propia forma de informar sobre sus finanzas y otras actividades. Quizás necesitemos lo mismo para las divulgaciones sobre los datos en los que se han entrenado los modelos fundamentales de IA.

Ya sea que las empresas den un paso adelante o que intervengan los gobiernos, deben asegurarnos de que los datos utilizados para entrenar sistemas de IA no estén envueltos en secreto. La confianza pública, nuestra capacidad para mitigar sus posibles daños y la eficacia de nuestro régimen regulatorio dependen de ello.

/cloudfront-us-east-2.images.arcpublishing.com/reuters/LM3JSCCX3FKSZPCNSQIKB55TGM.jpg)