«The Shortcomings of Generative AI Detection: How Schools Should Approach Declining Teacher Trust In Students». 2023. Center for Democracy and Technology (blog). 18 de diciembre de 2023. https://cdt.org/insights/the-shortcomings-of-generative-ai-detection-how-schools-should-approach-declining-teacher-trust-in-students/.

La inteligencia artificial generativa, que utiliza el aprendizaje automático para crear contenido en respuesta a indicaciones, ha suscitado preocupaciones sobre la deshonestidad académica en la educación. Aunque los temores de un fraude generalizado se han avivado, la investigación indica que el uso real con fines académicos deshonestos podría ser inferior a la percepción de los profesores. A pesar de esto, hay una creciente desconfianza entre los profesores, lo que lleva a acciones disciplinarias, afectando desproporcionadamente a ciertos grupos de estudiantes.

La inteligencia artificial generativa (Generative AI), que utiliza el aprendizaje automático para producir nuevo contenido (por ejemplo, texto o imágenes) en respuesta a indicaciones del usuario, se ha infiltrado en el sistema educativo y ha cambiado fundamentalmente las relaciones entre profesores y estudiantes.

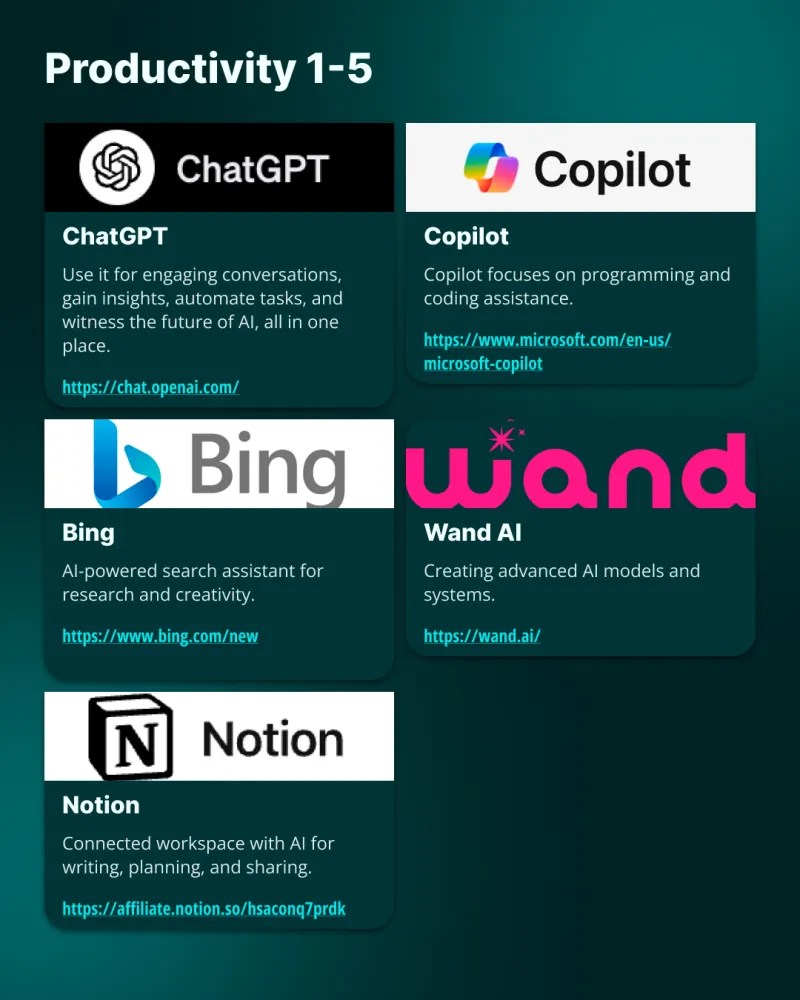

En todo el país, los educadores han expresado niveles elevados de ansiedad sobre el uso de herramientas de Generative AI, como ChatGPT, por parte de los estudiantes para hacer trampa en tareas, exámenes y ensayos, además de temores de que los estudiantes pierdan habilidades críticas de pensamiento. Al respecto, un profesor incluso lo describió como algo que «ha infectado [el sistema educativo] como un escarabajo de la muerte, ahuecando estructuras sólidas desde adentro hasta su inminente colapso». En respuesta a estos temores, distritos escolares como Nueva York y Los Ángeles impusieron rápidamente prohibiciones para su uso tanto por parte de educadores como de estudiantes. Las escuelas recurrieron a herramientas como detectores de Generative AI para intentar restaurar el control y la confianza de los educadores; sin embargo, los esfuerzos de detección han sido insuficientes tanto en su implementación como en su eficacia.

Investigaciones del CDT confirman la disminución de la confianza…

Un hallazgo significativo a través de encuestas a profesores, padres y estudiantes es que la percepción de los profesores sobre el uso generalizado de Generative AI para hacer trampa parece ser en gran medida infundada. El 40% de los profesores que dicen que sus estudiantes han usado Generative AI para la escuela piensan que sus estudiantes lo han utilizado para escribir y enviar un ensayo. Pero solo el 19% de los estudiantes que informan haber usado Generative AI dicen que lo han utilizado para escribir y enviar un ensayo, un hallazgo respaldado por otras investigaciones de encuestas.

A pesar de la realidad de que una gran mayoría de estudiantes no utiliza Generative AI con fines académicos deshonestos, los profesores han desarrollado una mayor desconfianza en el trabajo de los estudiantes, quizás debido a la cobertura generalizada y aterradora de casos de trampa. El 62% de los profesores estuvo de acuerdo con la afirmación de que «[la] Generative AI me ha hecho más desconfiado sobre si el trabajo de mis estudiantes es realmente de ellos». Y esta desconfianza está afectando a ciertos grupos de estudiantes, que son disciplinados de manera desproporcionada por usar o ser acusados de usar Generative AI; los profesores de títulos I y los profesores de educación especial con licencia informan tasas más altas de acciones disciplinarias por el uso de Generative AI entre sus estudiantes.

Estos niveles elevados de desconfianza entre los profesores y las acciones disciplinarias subsiguientes han llevado a la frustración entre estudiantes y padres acerca de acusaciones erróneas de hacer trampa, lo que puede causar una brecha aún mayor entre profesores y estudiantes. Esta erosión de la confianza es potencialmente perjudicial para las comunidades escolares donde las relaciones sólidas entre educadores y estudiantes son imperativas para proporcionar un entorno de aprendizaje seguro y de calidad.

…Y herramientas de detección y capacitación insuficientes

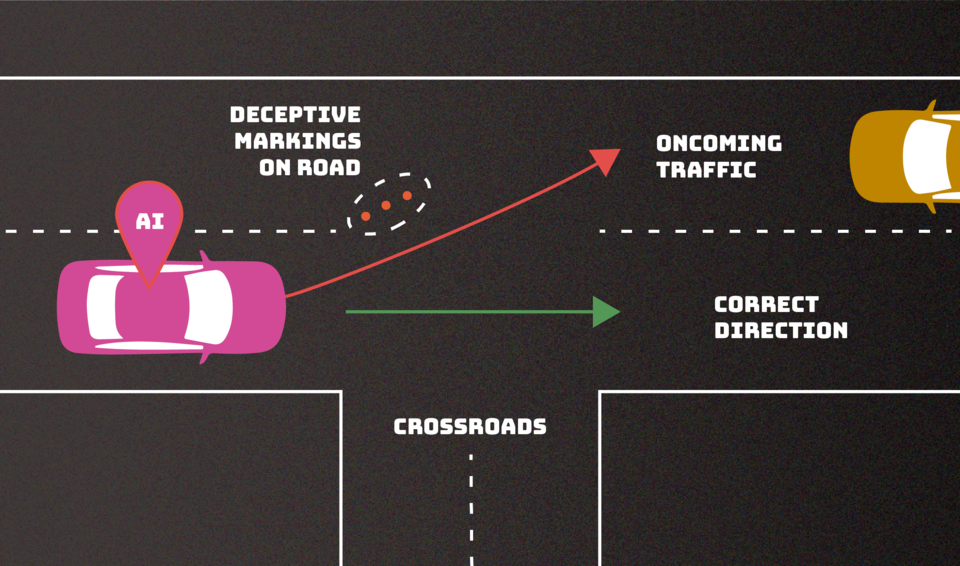

Las herramientas diseñadas para detectar cuándo se usó Generative AI para producir contenido son actualmente las únicas soluciones tecnológicas disponibles para ayudar a los profesores a combatir la trampa basada en Generative AI; sin embargo, no resuelven los problemas de confianza existentes. En primer lugar, las políticas escolares sobre el uso de herramientas de detección de contenido son irregulares: solo el 17% de los profesores dicen que su escuela proporciona una herramienta de detección de contenido como parte de su plataforma tecnológica más amplia, y el 26% dice que su escuela recomienda su uso, pero deja a elección del educador elegir una e implementarla. Sin una guía sólida sobre el uso e implementación de las herramientas de detección de contenido, los profesores parecen dudar en utilizarlas como mecanismo de defensa contra la trampa. Solo el 38% de los profesores informan que usan una herramienta de detección de contenido de Generative AI con regularidad, y solo el 18% de los profesores están muy de acuerdo en que estas herramientas «son una forma precisa y efectiva de determinar si un estudiante está usando contenido generado por IA». La falta de confianza de los profesores está justificada, ya que, al menos en este momento, estas herramientas no son consistentemente efectivas para diferenciar entre texto generado por IA y escrito por humanos.

Además del uso de herramientas de detección, la confianza de los profesores en su propia eficacia para detectar la escritura creada por AI es baja: el 22% dice que son muy efectivos y el 43% dice que son algo efectivas. Esto es particularmente preocupante dado que la mayoría de los profesores no han recibido orientación sobre cómo detectar la trampa. Solo el 23% de los profesores que han recibido capacitación sobre las políticas y procedimientos de sus escuelas con respecto a Generative AI han recibido orientación sobre cómo detectar el uso de ChatGPT (u otra herramienta de Generative AI) cuando los estudiantes envían tareas escolares.

¿Cómo deberían abordar las escuelas la disminución de la confianza de los profesores?

Dadas nuestras investigaciones y lo que sabemos sobre las herramientas de detección de contenido de Generative AI, no son la respuesta, al menos por ahora. Estas herramientas sufren de problemas de precisión y pueden flagelar desproporcionadamente a los hablantes no nativos. En cambio, las escuelas deben:

- Ofrecer capacitación a los profesores sobre cómo evaluar el trabajo de los estudiantes a la luz de la Generative AI: para ayudar a los profesores a sentir que tienen más control sobre la integridad académica en el aula, las escuelas deben capacitarlos adecuadamente para lidiar con la nueva realidad de la Generative AI. Esto implica proporcionarles capacitación sobre las limitaciones de los detectores y cómo responder si sospechan razonablemente que un estudiante está haciendo trampa.

- Elaborar e implementar políticas claras sobre los usos permitidos y prohibidos: nuestras encuestas de este verano muestran que las escuelas no proporcionan orientación sobre lo que se define como «uso indebido» de la Generative AI, con un 37% de los profesores que informan que su escuela no tiene una política o no están seguros de si hay una política sobre Generative AI. Es imperativo que tanto los profesores como los estudiantes conozcan esto, para que todos estén en la misma página sobre el uso responsable de la Generative AI.

- Alentar a los profesores a modificar las tareas para minimizar la efectividad de la Generative AI: comprender en qué no son buenas los sistemas de Generative AI puede ayudar a los profesores a diseñar tareas en las que el uso de Generative AI no sea útil para los estudiantes. Por ejemplo, los sistemas de Generative AI a menudo son ineficaces para proporcionar fuentes precisas para sus afirmaciones. Requerir que los estudiantes proporcionen citas para cualquier afirmación que hagan probablemente obligará a los estudiantes a ir mucho más allá de una respuesta generada.