Alysa Levene. «Artificial Intelligence and Authorship» COPE: Committee on Publication Ethics, 23 de febrero de 2023. https://publicationethics.org/news/artificial-intelligence-and-authorship.

La evolución de la inteligencia artificial y los robots conversacionales plantea interrogantes sobre el papel del autor y cómo se define en este contexto. Con la llegada de los modelos lingüísticos de gran escala, como ChatGPT de OpenAI, se ha generado un debate sobre la autoría y la creación de contenido generado por inteligencia artificial.

Los modelos de inteligencia artificial, como ChatGPT de OpenAI, plantean preguntas sobre el concepto de autoría. Estos robots, alimentados por grandes modelos lingüísticos y entrenados con vastos bancos de texto, tienen la capacidad de generar respuestas en función de la probabilidad de combinaciones de palabras, estructuras de frases y temas.

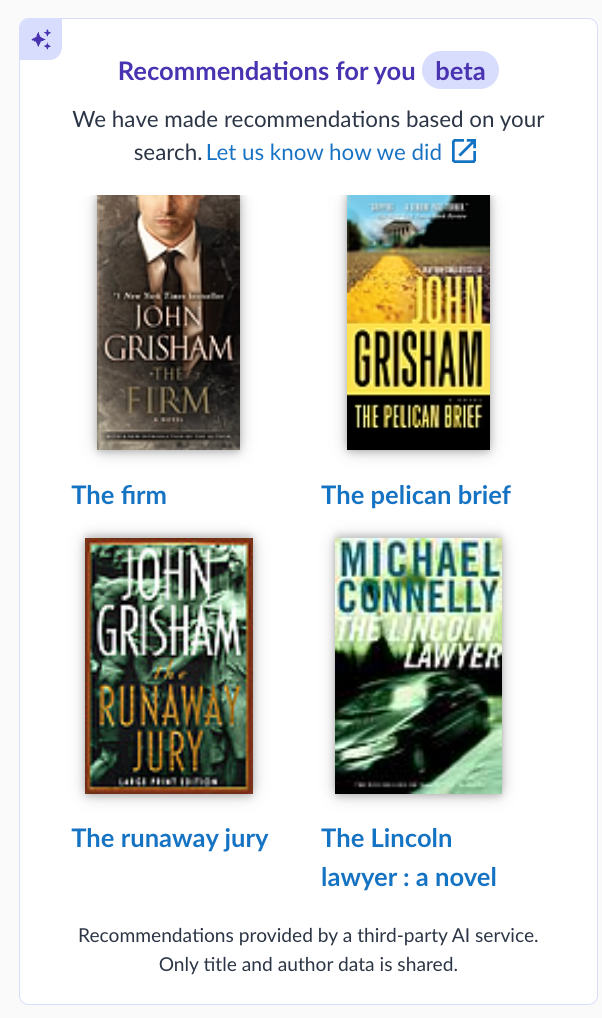

El impacto de ChatGPT y otros sistemas similares en el mercado ha sido notable. La gente ha compartido sus experiencias de interacción con ChatGPT, desde solicitar recomendaciones sobre otros robots de inteligencia artificial para escribir y obtener respuestas hasta pedirle a ChatGPT que escriba una conferencia.

Estas situaciones plantean preguntas más amplias sobre el papel de los robots de inteligencia artificial en la creación de contenido y su impacto en la noción tradicional de autoría. A medida que la tecnología avanza, es importante explorar los límites y las implicaciones éticas de estas innovaciones, considerando cómo se complementan o desafían la creatividad humana y la autoría individual.

La cuestión de quién es el autor en estas interacciones plantea un desafío interesante. Si bien los modelos lingüísticos son herramientas poderosas y capaces de producir contenido original, su capacidad de crear está limitada a lo que han aprendido de los datos de entrenamiento. La responsabilidad de la autoría puede recaer en los desarrolladores de la inteligencia artificial, los usuarios que interactúan con ella o incluso en la propia máquina.

Las empresas que producen estas herramientas de aprendizaje automático de inteligencia artificial son muy claras sobre la situación legal y ética de sus productos. La compañía Bloom, una plataforma de IA de LLM, afirma en sus especificaciones que «el uso del modelo en situaciones de alto riesgo está fuera de su alcance… El modelo no está diseñado para decisiones críticas ni para usos con consecuencias materiales en la vida o el bienestar de una persona».. Esto incluye áreas como la atención médica, los juicios legales, las finanzas o la puntuación individual, que a menudo están representadas en las carteras de las editoriales académicas. El descargo de responsabilidad de la empresa Bloom también hace hincapié en la necesidad de que los usuarios indirectos estén informados cuando trabajen con contenidos generados por el modelo lingüístico.

Del mismo modo, en enero de 2023, la Asociación Mundial de Editores Médicos (WAME, por sus siglas en inglés) publicó una respuesta en la que abordaba el uso de los modelos lingüísticos en las publicaciones académicas y hacía una recomendación similar. ChatGPT reconoce sus propias limitaciones y ha declarado que no existe ningún problema ético inherente al uso de la IA en la investigación o la escritura, siempre que se utilice de forma adecuada y ética. En algunos casos, ChatGPT ha reconocido incluso que no cumple todos los criterios de autoría señalados por el Comité Internacional de Editores de Revistas Médicas (ICMJE).

Tanto las directrices del ICMJE como las del Comité de Ética en las Publicaciones (COPE) coinciden en que los bots de IA no deben ser considerados autores, ya que carecen de capacidad legal, no pueden tener derechos de autor, ser considerados responsables o aprobar un trabajo de investigación como original. Editoriales como Springer Nature y Taylor & Francis también han publicado declaraciones instando a los autores a revelar cualquier interacción con la IA en sus métodos o secciones de agradecimiento.

Está claro que estas empresas y organizaciones reconocen la necesidad de transparencia y uso responsable de las tecnologías de IA en la investigación y la escritura. Subrayan la importancia de distinguir entre autores humanos y contenidos generados por IA, al tiempo que promueven las prácticas éticas y la divulgación en la publicación académica.

Es importante señalar que un bot de IA no se preocupa de si la información que devuelve es «verdadera»; su atención se centra en la verosimilitud. Este fenómeno surge porque los robots de IA carecen del concepto de fiabilidad, replicabilidad o «verdad». Su propósito es proporcionar respuestas que tengan un sentido probabilístico basado en la gama de hechos y afirmaciones de sus datos de entrenamiento. Aunque puede haber casos en los que sólo haya una respuesta a una pregunta, en muchos casos puede haber múltiples respuestas posibles, todas ellas igualmente probables desde la perspectiva del bot. Esta capacidad de afirmar diferentes respuestas a la misma pregunta puede provocar a veces una reacción muy humana de ofensa o confusión.

Como se indica en las especificaciones de Bloom, el modelo produce contenidos que pueden parecer factuales, pero no necesariamente correctos. Comprender estas limitaciones es crucial a la hora de utilizar la IA. La evaluación crítica y el uso responsable de la información generada por la IA son vitales para garantizar su aplicación adecuada en diversos contextos, incluida la investigación académica.

De este modo, los editores y las editoriales tendrán que confiar aún más en la responsabilidad de los autores y en una rigurosa revisión por pares para detectar y solucionar tales problemas. Merece la pena señalar que la revisión por pares no siempre descubre fallos basados en los resultados y no en la metodología

Algunos usuarios han expresado su preocupación por el hecho de que ChatGPT atribuya erróneamente o fabrique citas, lo que indica un enfoque potencialmente poco estricto respecto al plagio en sus datos de entrenamiento. Por otra parte, a medida que el modelo aprende de conjuntos de datos más refinados, sus resultados pueden ser más creativos.

Estas observaciones ponen de relieve la naturaleza evolutiva de los contenidos generados por IA y la necesidad de una evaluación, un perfeccionamiento y un conocimiento contextual continuos a la hora de utilizar estas herramientas en las publicaciones académicas. Sigue siendo esencial equilibrar las ventajas que ofrece la IA con la evaluación crítica y el juicio humano para garantizar la integridad y la calidad de la investigación y la publicación académicas.

Un robot -por muy bien entrenado que esté y con el grado de claridad que le aporte la distancia respecto a la desordenada experiencia humana de investigar, planificar y escribir- no puede entender lo que escribe. En pocas palabras, no puede ser responsable. Como ya hemos visto, los robots han sido entrenados para decirlo explícitamente.

En la actualidad, la inteligencia artificial (IA) se presenta como una herramienta sorprendente, siempre y cuando se utilice de manera ética y para fines específicos. Es probable que se convierta en una herramienta indispensable. Sin embargo, existen consideraciones más amplias que deben ser cuidadosamente analizadas en cuanto a cómo y cuándo se debe emplear en la literatura académica, sin mencionar los posibles sesgos y contenido desagradable que pueda estar presente en su material de entrenamiento, lo cual afectará lo que produzca.

Incluso es posible que en el futuro se utilicen herramientas de IA para entrenar mejor a los robots en la escritura de un lenguaje auténticamente humano, siempre y cuando también se les instruya en prácticas éticas. Sin embargo, ¿deberíamos considerar a la IA como una autora legítima? El mundo de la ética en la publicación académica está empezando a rechazar firmemente esa idea, y es fácil entender por qué.

/cloudfront-us-east-2.images.arcpublishing.com/reuters/2XY6EA4SNRKFLO2UDQAAJIUWHY.jpg)