Anjana Susarla, The. «What Would AI Regulation Look Like?» Gizmodo, 4 de junio de 2023. https://gizmodo.com/chatgpt-ai-what-would-ai-regulation-look-like-altman-1850501332.

Durante su testimonio en el Senado el 16 de mayo de 2023, el CEO de OpenAI, Sam Altman, hizo un llamado a los legisladores para considerar la regulación de la inteligencia artificial (IA). Altman propuso la creación de una agencia reguladora de la IA y la implementación de licencias para las empresas que trabajan en este campo. Estas propuestas son interesantes, pero es igualmente importante tener en cuenta las recomendaciones de otros expertos que participaron en el mismo panel.

Entre las sugerencias de los expertos se destaca la necesidad de exigir transparencia en relación con los datos de entrenamiento utilizados en los sistemas de IA, así como establecer marcos claros para abordar los riesgos asociados con esta tecnología. Estos aspectos son cruciales para garantizar la responsabilidad y la ética en el desarrollo y despliegue de la IA.

Además, se plantea la preocupación de que el sector de la IA pueda estar presenciando la aparición de un nuevo tipo de monopolio tecnológico, dada la naturaleza económica de la creación de modelos de IA a gran escala. Este aspecto debe ser considerado en cualquier esfuerzo de regulación, ya que el poder económico y la influencia política de las empresas en este campo pueden tener un impacto significativo.

Si bien las sugerencias de Altman y las discusiones sobre la regulación de la IA son importantes, es necesario profundizar en los detalles sobre cómo se implementaría la regulación y qué formas específicas tomarían las licencias. Además, cualquier enfoque regulatorio debe tener en cuenta las complejidades del poder económico y la influencia política de las empresas de IA.

En este sentido es crucial abordar estas cuestiones importantes, pero también es necesario llevar a cabo un debate amplio y colaborativo para encontrar respuestas efectivas. La regulación de la IA puede ser útil para proteger los intereses públicos y garantizar la seguridad y la equidad, pero su implementación requerirá un enfoque cuidadoso y una consideración detallada de los diversos aspectos involucrados.

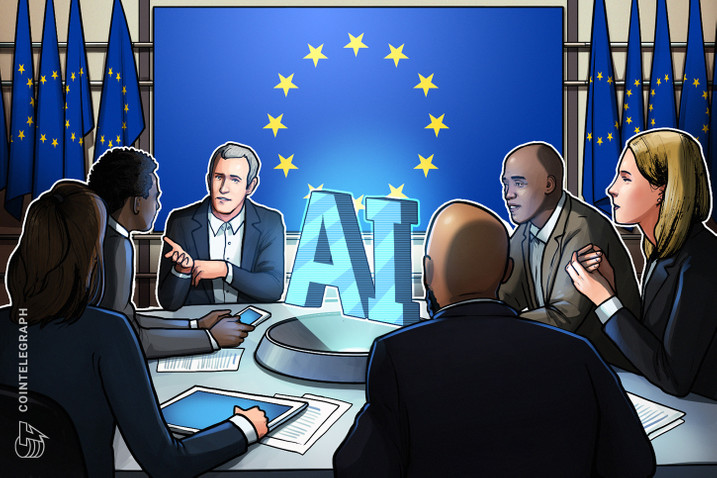

Los legisladores y líderes políticos de todo el mundo han comenzado a abordar las cuestiones planteadas en el testimonio de Sam Altman. En la Unión Europea, se ha implementado la Ley de IA, la cual se basa en un modelo de riesgo que clasifica las aplicaciones de IA en tres categorías: inaceptable, alto riesgo y riesgo bajo o mínimo. Esta clasificación reconoce que las herramientas de puntuación social utilizadas por los gobiernos y las herramientas automatizadas de contratación plantean riesgos diferentes a los asociados con el uso de la IA en filtros de spam, por ejemplo.

En lugar de establecer una nueva agencia que pueda verse influenciada por la industria tecnológica que debe regular, el Congreso puede considerar respaldar la adopción tanto en el ámbito privado como público del marco de gestión de riesgos del Instituto Nacional de Normas y Tecnología (NIST, por sus siglas en inglés) y aprobar proyectos de ley como la Algorithmic Accountability Act. Estas acciones tendrían el efecto de imponer la rendición de cuentas, de manera similar a cómo la Ley Sarbanes-Oxley y otras regulaciones transformaron los requisitos de información para las empresas. Además, el Congreso puede aprobar leyes integrales en relación a la privacidad de los datos.

La regulación de la IA debe implicar la colaboración entre el ámbito académico, la industria, los expertos políticos y las agencias internacionales. Se ha comparado este enfoque con organizaciones internacionales como el CERN (Organización Europea para la Investigación Nuclear) y el Grupo Intergubernamental de Expertos sobre el Cambio Climático, que han logrado éxitos significativos en sus respectivos campos. En el ámbito de Internet, se ha adoptado un enfoque similar a través de organismos no gubernamentales que involucran a organizaciones sin ánimo de lucro, la sociedad civil, la industria y los responsables políticos. Ejemplos notables incluyen la Corporación de Internet para la Asignación de Nombres y Números y la Asamblea Mundial de Normalización de las Telecomunicaciones. Estos ejemplos pueden servir como modelos para la industria y los responsables políticos al abordar la regulación de la IA.

Aunque Sam Altman de OpenAI planteó la posibilidad de otorgar licencias a empresas para el despliegue de tecnologías de inteligencia artificial (IA), es importante destacar que se refería específicamente a la inteligencia artificial general, es decir, sistemas de IA futuros con un nivel de inteligencia similar al humano que podrían plantear riesgos para la humanidad. Este enfoque sería similar a la concesión de licencias para el manejo de otras tecnologías potencialmente peligrosas, como la energía nuclear. Sin embargo, la concesión de licencias podría desempeñar un papel mucho antes de que se llegue a ese escenario futurista.

La auditoría algorítmica requeriría credenciales, estándares de práctica y una formación extensa. La exigencia de responsabilidades no se limita únicamente a otorgar licencias a individuos, sino que también implica establecer estándares y prácticas en toda la empresa.

Los expertos en imparcialidad de la IA argumentan que las cuestiones de parcialidad e imparcialidad en la IA no pueden abordarse únicamente mediante métodos técnicos, sino que requieren prácticas más amplias de mitigación de riesgos, como la adopción de juntas de revisión institucional para la IA. Un ejemplo de esto se encuentra en el ámbito médico, donde las juntas de revisión institucional ayudan a salvaguardar los derechos individuales de los pacientes.

Además, los organismos académicos y las sociedades profesionales han desarrollado normas para el uso responsable de la IA, ya sea en términos de atribución en textos generados por IA o en el intercambio de datos en el ámbito de la medicina a través de los pacientes. Estas normas buscan promover prácticas éticas y mitigar los riesgos asociados con el uso de la IA en diversas áreas.

El testimonio de Altman también omitió abordar la cuestión de los posibles monopolios en el campo de la IA. Una observación importante es la significativa inversión necesaria para entrenar modelos de IA a gran escala, como GPT-4, que es uno de los fundamentos de ChatGPT, o el generador de texto a imagen Stable Diffusion. Estos modelos son desarrollados principalmente por un reducido número de empresas, como Google, Meta, Amazon y Microsoft.

La falta de transparencia en los datos de entrenamiento utilizados por estas empresas ha sido motivo de preocupación. Expertos en ética de la IA, como Timnit Gebru, Emily Bender y otros, han advertido que la adopción generalizada de estas tecnologías sin una supervisión adecuada puede amplificar el sesgo de las máquinas a una escala social.

Además, es importante reconocer que los datos de entrenamiento de herramientas como ChatGPT incluyen el trabajo intelectual de numerosas personas, como colaboradores de Wikipedia, blogueros y autores de libros digitalizados. Sin embargo, los beneficios económicos derivados de estas herramientas recaen únicamente en las empresas tecnológicas.