Microsoft’s AI Access Principles: Our commitments to promote innovation and competition in the new AI economy

Feb 26, 2024 | Brad Smith – Vice Chair & President

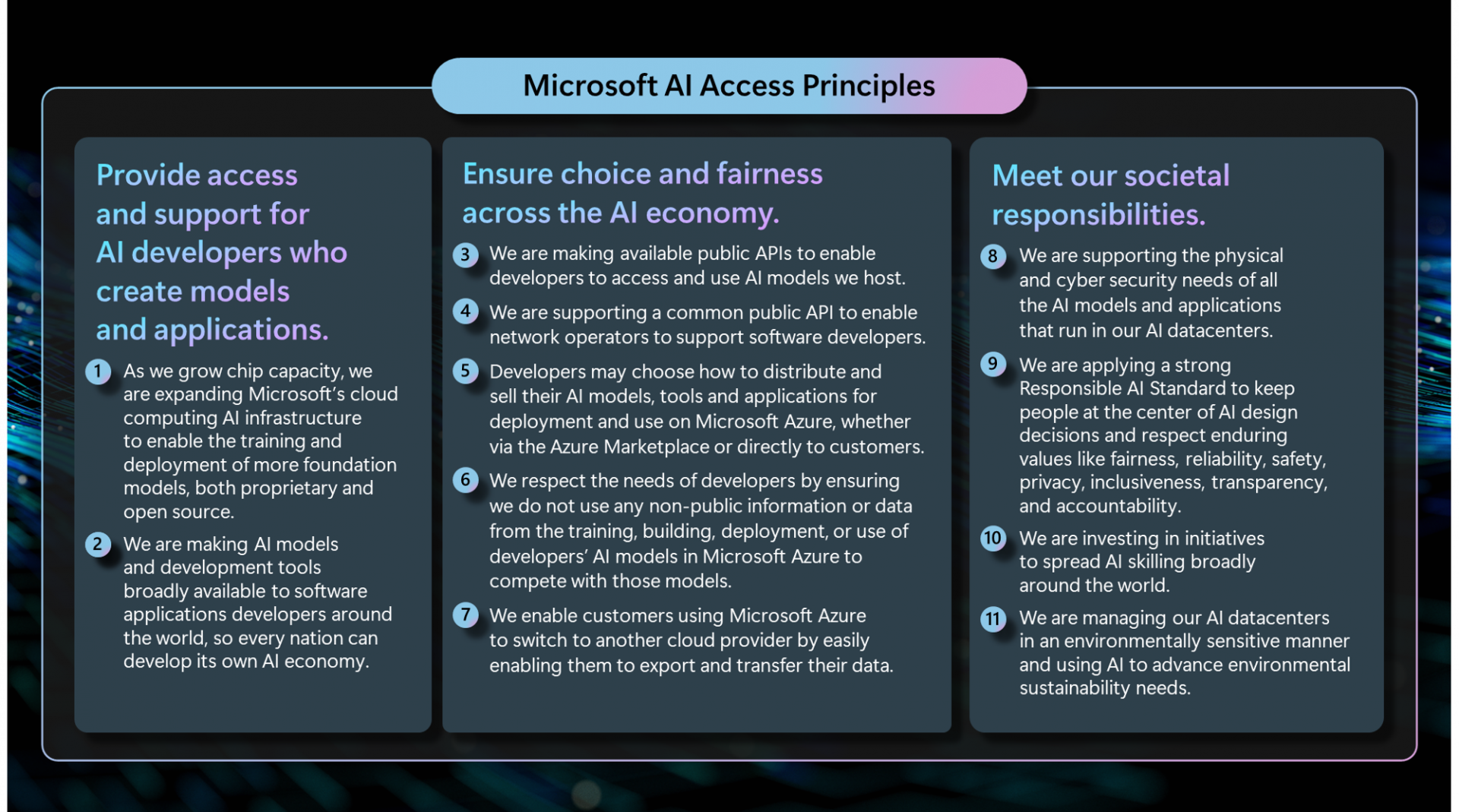

Microsoft presenta un nuevo marco que llama «Principios de Acceso a la IA» — un plan de once puntos que Microsoft dijo que «gobernará cómo operaremos nuestra infraestructura de centro de datos de IA y otros activos de IA importantes en todo el mundo».

Los puntos cubren áreas como la construcción y operación de una tienda de aplicaciones para permitir a las empresas elegir diferentes modelos de lenguaje y otros productos de IA, y un compromiso de mantener los datos propietarios de la empresa fuera de sus modelos de entrenamiento. También incluye un compromiso de permitir a los clientes cambiar de proveedores de nube o servicios dentro de la nube, si así lo eligen. También detalla un enfoque en la construcción de ciberseguridad en torno a los servicios de IA; atención a la construcción de centros de datos y otra infraestructura de manera ambientalmente responsable; e inversiones en educación.

Brad Smith, el presidente y vicepresidente de Microsoft, anunció el marco hoy en el Mobile World Congress en Barcelona. Aunque la implicación aquí es que Microsoft está abierto al diálogo y la conversación con las partes interesadas, irónicamente, Smith entregó la noticia en un discurso principal, sin margen para preguntas de seguimiento.

El anuncio llega al mismo tiempo que Microsoft está siendo objeto de un escrutinio regulatorio creciente por su inversión de 13 mil millones de $ en OpenAI, que actualmente le otorga una participación del 49% en la startup que lidera la carga de los servicios de IA generativa a nivel mundial. En enero, el organismo europeo de vigilancia de la competencia dijo que estaba evaluando si la inversión cae bajo las normas antimonopolio.

Los principios apuntan específicamente a cómo terceros podrían usar las plataformas y servicios de Microsoft para desarrollar productos de IA, un área comercial crítica y un servicio empresarial que la compañía espera desarrollar en los próximos años, no solo con los operadores que asisten al MWC, sino también con empresas y organizaciones de una gama mucho más amplia de industrias.

«Si están entrenando un modelo en nuestra infraestructura, si lo están implementando en nuestra infraestructura, reconocemos que sus datos son sus datos, no los accederemos ni los utilizaremos para competir con las empresas que dependen de nuestra infraestructura», dijo Smith.

Estos Principios de Acceso a la IA, para ser claros, no son reglas vinculantes para Microsoft, ni hay ningún tipo de detalle sobre cómo se podrían verificar o rastrear los compromisos, pero sirven para anticipar eso. En caso de investigaciones regulatorias formales, es probable que la empresa los utilice para argumentar que está tomando medidas proactivas para garantizar la competencia en el mercado.

«De hecho, a partir de hoy, tenemos casi 1600 modelos funcionando en nuestros centros de datos, 1500 de los cuales son modelos de código abierto», dijo Smith en el escenario hoy, «mostrando cómo nosotros como empresa… nos enfocamos en modelos propietarios y de código abierto, empresas, grandes y pequeñas».

Por otro lado, al hacerlos públicos de esta manera, los principios se convierten en un pronunciamiento público que el público, los competidores de Microsoft y, especialmente, los reguladores, podrían usar como punto de referencia si creen que Microsoft no ha estado a la altura.