Hervieux, S. ; Wheatley, A. Building an AI Literacy Framework: Perspectives from Instruction Librarians and Current Information Literacy Tools. Taylor and Francis, 2024

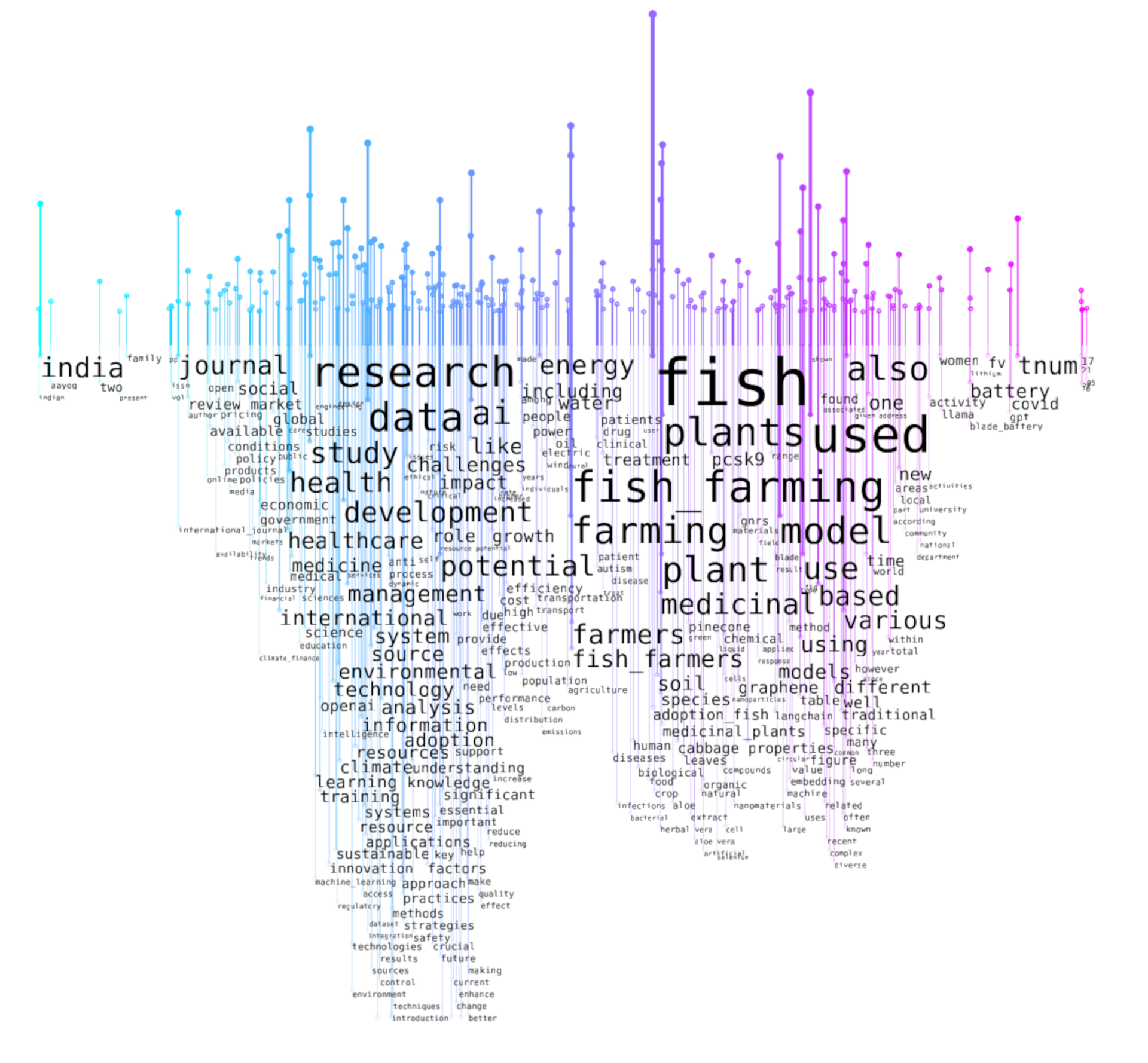

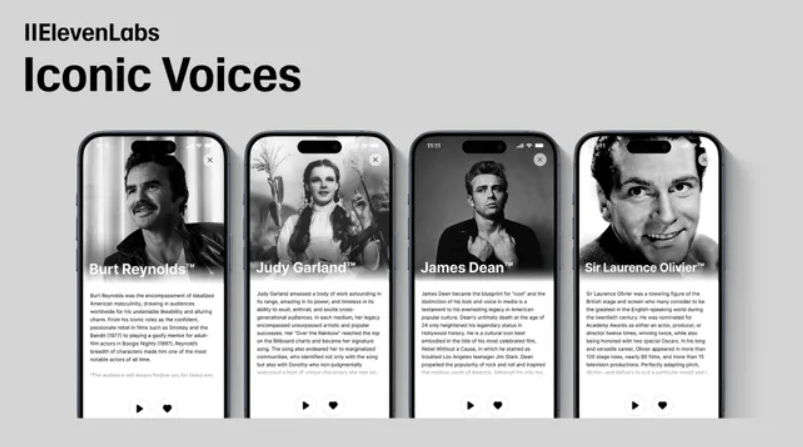

Con el aumento de las discusiones sobre herramientas de inteligencia artificial generativa como ChatGPT, los bibliotecarios se enfrentan ahora a una tecnología de IA accesible que los estudiantes utilizan para completar sus tareas de investigación y redacción. Los marcos y estándares de alfabetización informacional han ayudado tradicionalmente a los bibliotecarios a planificar sus sesiones de instrucción; sin embargo, estas estructuras no abordan la IA. Han surgido muchos talleres dirigidos por bibliotecarios para ayudar a los estudiantes a crear mensajes para chat, verificar la información proporcionada por ChatGPT y usar las herramientas de IA de manera crítica. Aunque ha comenzado a discutirse la inclusión de la IA en el Marco de Alfabetización Informacional de ACRL, se propone que se necesita un nuevo marco para abordar todas las complejidades de la inteligencia artificial. Este documento técnico tiene como objetivo informar sobre entrevistas con bibliotecarios de instrucción sobre la alfabetización en IA. A partir del análisis de las entrevistas, se identificarán los principales temas y preocupaciones relacionados con la IA y se desarrollará un marco robusto para la alfabetización en IA. Los lectores del documento técnico deberían obtener una mejor comprensión del lugar de la alfabetización en IA dentro de la instrucción de alfabetización informacional y poder utilizar una estructura rigurosa para planificar sus propias intervenciones.

Aspectos Clave:

- Determinar las perspectivas de los bibliotecarios de instrucción sobre la alfabetización en IA.

- Evaluar los marcos de alfabetización actuales para su capacidad de adaptación al panorama de la inteligencia artificial.

- Crear un marco robusto de alfabetización en IA.

Hallazgos: Tras 15 entrevistas con bibliotecarios de Canadá y Estados Unidos, los autores determinaron que, aunque el 67% de los bibliotecarios han enseñado contenido sobre IA en el último año, la mayoría no se basó en el Marco de Alfabetización Informacional de ACRL para construir sus sesiones de instrucción. También se identificaron varias habilidades emergentes que otros marcos de alfabetización informacional no representan en detalle, tales como:

- Ingeniería de prompts, entre una serie de habilidades necesarias para utilizar herramientas de IA.

- Evaluación crítica que va más allá de la autoridad y examina la ética y el sesgo.

- Comprensión de las implicaciones éticas, como las relacionadas con el trabajo y el medio ambiente.

- Nuevas formas de atribuir la creación/edición de contenido.

El marco propuesto de IA se centrará en:

- Participar en el discurso sobre IA.

- Conocer los principios básicos de la IA.

- Entender las diferencias fundamentales entre tipos de IA.

- Experimentar con herramientas de IA.

- Revisar los resultados y productos de las herramientas de IA.

- Evaluar el impacto de la IA a nivel social