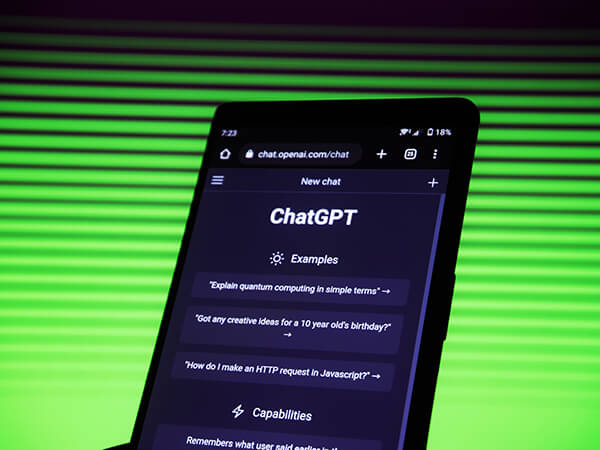

OpenAI ha enfrentado múltiples demandas en las últimas semanas debido al uso de conjuntos de datos que contienen información personal y materiales con derechos de autor en el entrenamiento de sus modelos de IA, como ChatGPT. Estas demandas plantean preocupaciones sobre presuntas infracciones de derechos de autor y el uso indebido de datos sensibles, como registros médicos y conversaciones privadas, sin el consentimiento apropiado.

OpenAI se ha enfrentado a varias demandas presentadas en las últimas semanas. Estas demandas han planteado preocupaciones sobre el uso de conjuntos de datos que contienen información personal y materiales con derechos de autor para entrenar a sus modelos de IA, como ChatGPT. Algunas de las demandas alegan infracciones de derechos de autor, mientras que otras afirman que OpenAI utilizó datos sensibles, como conversaciones privadas y registros médicos, sin el consentimiento adecuado.

Entre las demandas más destacadas se encuentra una demanda presentada por 16 demandantes no identificados que afirman que OpenAI utilizó datos sensibles en el entrenamiento de sus modelos de IA. Además, la comediante y autora Sarah Silverman, junto con los autores Christopher Golden y Richard Kadrey, han presentado demandas por infracción de derechos de autor contra OpenAI y Meta en un tribunal de distrito de Estados Unidos. Las demandas alegan, entre otras cosas, que los modelos ChatGPT de OpenAI y LLaMA de Meta fueron entrenados utilizando conjuntos de datos adquiridos ilegalmente que contenían sus obras, las cuales afirman haber sido obtenidas de sitios web de «bibliotecas piratas» como Bibliotik, Library Genesis, Z-Library y otros, mencionando que los libros están «disponibles en masa a través de sistemas de torrents». En la demanda contra OpenAI, los creadores presenta pruebas que demuestran que cuando se le solicita, ChatGPT resume sus libros, infringiendo sus derechos de autor. En las pruebas se muestra que el primer libro resumido por ChatGPT es Bedwetter de Silverman, mientras que también se utiliza como ejemplo el libro Ararat de Golden y el libro Sandman Slim de Kadrey. La demanda afirma que el chatbot no se preocupó por «reproducir ninguna de las informaciones de gestión de derechos de autor que los demandantes incluyeron en sus obras publicadas».

Una demanda presentada en un tribunal federal en San Francisco alega que OpenAI copió texto de libros ilegalmente al no obtener el consentimiento de los titulares de los derechos de autor, darles crédito ni compensarlos. La demanda, Tremblay v. OpenAI Inc, afirma que ChatGPT puede resumir de manera precisa los libros de ciencia ficción y terror de los autores. Esto sugiere que el chatbot ha leído y absorbido sus obras. Los autores alegan que ChatGPT violó la ley de derechos de autor al eliminar los avisos de derechos de autor de estos libros.

Otra demanda alega que los modelos de aprendizaje automático de OpenAI, incluyendo ChatGPT y DALL-E, recopilan ilegalmente la información personal de las personas en Internet, violando diversas leyes de privacidad. La demanda, conocida como PM v. OpenAI LP, afirma que OpenAI obtiene información privada de las personas directamente a través de sus sistemas de IA y otras aplicaciones que incorporan ChatGPT. La demanda alega que OpenAI ha incorporado sus sistemas en varias plataformas como Snapchat, Spotify, Stripe, Slack y Microsoft Teams. Afirma que OpenAI recopiló clandestinamente imágenes, ubicaciones, preferencias musicales, información financiera y comunicaciones privadas de los usuarios a través de estas integraciones. Además, la denuncia argumenta que esta recopilación y uso de datos violaron las leyes de privacidad, especialmente en lo que respecta a los datos de los niños.

Estas demandas han generado un debate sobre la ética y las prácticas de recopilación de datos utilizadas en el desarrollo de modelos de IA. OpenAI aún no ha hecho comentarios públicos específicos sobre las demandas y se espera que el proceso legal siga su curso para determinar los resultados. Las acusaciones resaltan la importancia de abordar de manera ética y legal la recopilación y el uso de datos en el desarrollo de la inteligencia artificial. El proceso legal determinará los resultados de estas demandas y puede tener implicaciones significativas para la industria, y la regulación en el campo de la IA.