Terra Dankowski, «Spirit in the Stacks», American Libraries Magazine, 3 de septiembre de 2024, https://americanlibrariesmagazine.org/?p=145149.

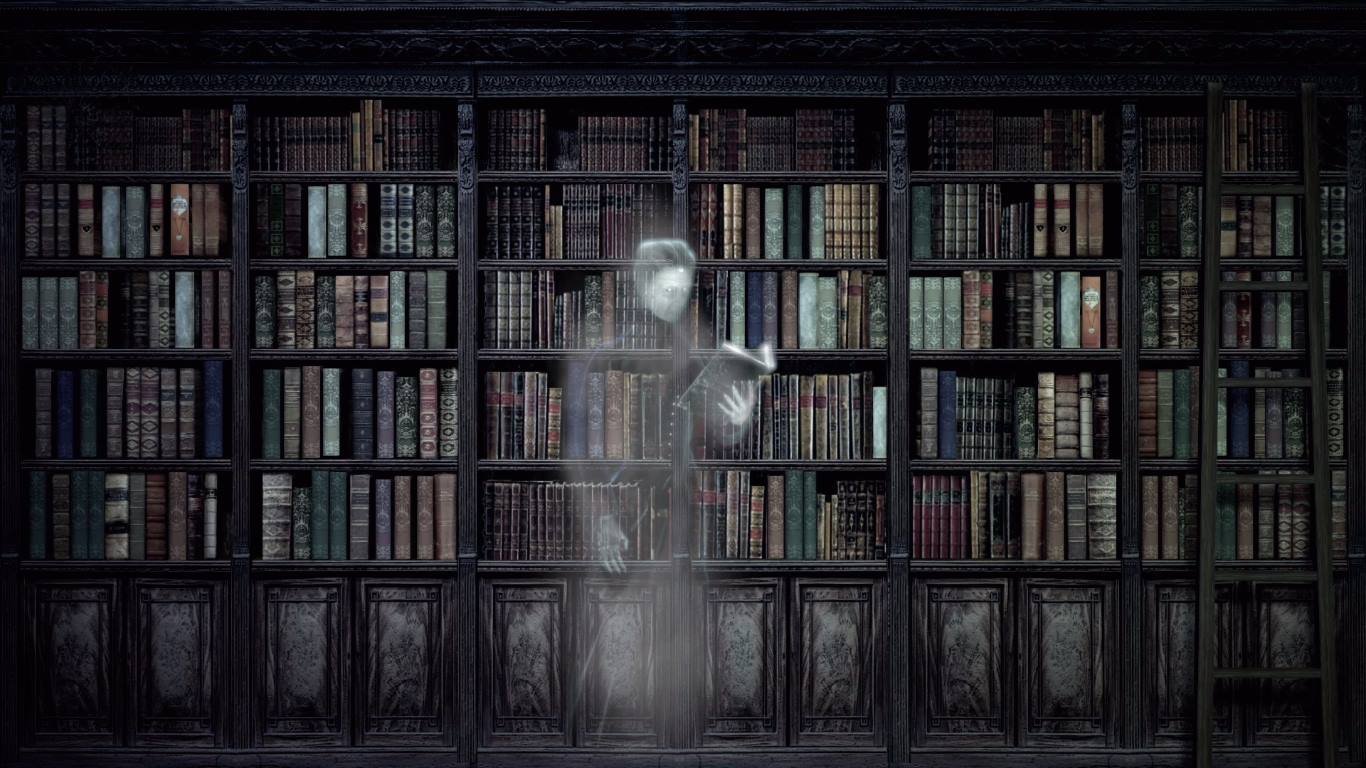

Bibliotecas públicas en diferentes partes de Estados Unidos han comenzado a ofrecer kits de caza de fantasmas como parte de sus servicios innovadores para atraer a una nueva generación de usuarios.

Estos kits, que incluyen equipos especializados como medidores de campo electromagnético (EMF), grabadoras de fenómenos de voz electrónica (EVP), sensores de movimiento infrarrojos, termómetros para detectar cambios en la temperatura ambiente, y geófonos para captar vibraciones y sonidos de objetos en movimiento, permiten a los aficionados a lo paranormal realizar sus propias investigaciones en busca de espíritus o fenómenos inexplicables.

Uno de los casos más destacados es el de la Biblioteca Pública del Condado de Clark (CCPL) en Ohio, donde estos kits han ganado una popularidad notable. Sonya Knisley, directora de servicios infantiles en CCPL, menciona que es común ver a personas que se registran para obtener una tarjeta de biblioteca únicamente con el objetivo de solicitar uno de estos kits. Desde su introducción en enero de 2023, los kits han sido prestados más de 90 veces, lo que ha llevado a la biblioteca a aumentar su inventario para satisfacer la creciente demanda. Para controlar el uso de estos costosos equipos, que tienen un valor aproximado de 250 dólares por kit, la biblioteca ha impuesto ciertas restricciones: solo pueden ser prestados por una semana, no son renovables, y los usuarios deben ser adultos que firmen un acuerdo de responsabilidad. Sin embargo, el éxito de estos kits no ha estado exento de problemas, ya que recientemente dos de ellos no fueron devueltos, lo que ha generado bromas sobre si los fantasmas los tomaron.

Otro ejemplo destacado es la Biblioteca Pública de Wilsonville (WPL) en Oregón, que añadió un kit de caza de fantasmas a su «Biblioteca de Cosas» en septiembre de 2023. En esta sección, los usuarios pueden pedir prestados equipos especializados que no son accesibles o asequibles para el público general, como lavadoras a presión, detectores de metales, y ahora, herramientas para la investigación paranormal. Angelika Heidelberger, coordinadora de servicios técnicos de WPL, señaló que a pesar de que inicialmente temía recibir críticas por la inclusión de equipos de caza de fantasmas debido a preocupaciones religiosas o científicas, no han recibido ninguna queja. Los kits han sido bien recibidos y se encuentran entre los artículos más solicitados de la biblioteca, casi nunca estando disponibles en las estanterías.

De manera similar, la Biblioteca Pública de Coventry (CPL) en Rhode Island lanzó su propio kit de caza de fantasmas en 2018, aunque inicialmente no recibió tanta atención. Esto cambió en 2022 cuando el personal de la biblioteca decidió promover el kit de manera creativa, grabando un video corto al estilo de los populares programas de televisión sobre cazafantasmas. Desde entonces, el kit ha sido solicitado con regularidad, no solo en la temporada de Halloween, y ha sido utilizado para actividades recreativas como una caza de fantasmas en la misma biblioteca, donde los adolescentes participantes detectaron actividad paranormal en la sección de videojuegos, bromeando que podría haber un fantasma al que apodaron «Barry».

El auge de los kits de caza de fantasmas en bibliotecas refleja el creciente interés público en lo paranormal, con encuestas recientes que muestran que el porcentaje de estadounidenses que creen en fantasmas ha aumentado considerablemente en las últimas dos décadas. Este fenómeno ha sido impulsado, en parte, por la proliferación de programas de televisión y canales de YouTube dedicados al tema, como Ghost Hunters y Ghost Files, que han hecho que la caza de fantasmas se convierta en una actividad recreativa popular. Para muchas bibliotecas, la inclusión de estos kits en sus catálogos responde a su misión de ofrecer servicios innovadores y accesibles a la comunidad, permitiendo a las personas explorar nuevas formas de entretenimiento e investigación científica, aunque sea de manera recreativa.

A través de estos programas, las bibliotecas están no solo fomentando la curiosidad y el aprendizaje, sino también atrayendo a usuarios que quizás no habrían interactuado con la biblioteca de otra manera. Como explica Lauren Walker, directora de CPL, los usuarios ven la caza de fantasmas como una actividad divertida y emocionante, lo que ha contribuido a mantener el interés en los kits más allá de su valor inicial como novedad.