Durán Benavides, Arturo, Claudia Rita Estrada Esquivel y Karen Quintero Álvarez. “Inteligencia artificial vs. inteligencia artificial: herramientas de detección aplicadas a la evaluación educativa.” En Inteligencia artificial: experiencias y reflexiones sobre la investigación educativa, editado por Alexandro Escudero-Nahón y Emma Patricia López, 2026. https://doi.org/10.56162/transdigitalbc13.29

La detección de contenidos generados por IA no puede abordarse exclusivamente desde la tecnología. Aunque las herramientas actuales son útiles, su fiabilidad es limitada y no sustituyen el juicio crítico del docente. El verdadero reto reside en redefinir la evaluación educativa, pasando de un enfoque punitivo basado en la detección a un modelo formativo que promueva la ética, el pensamiento crítico y el uso responsable de la inteligencia artificial.

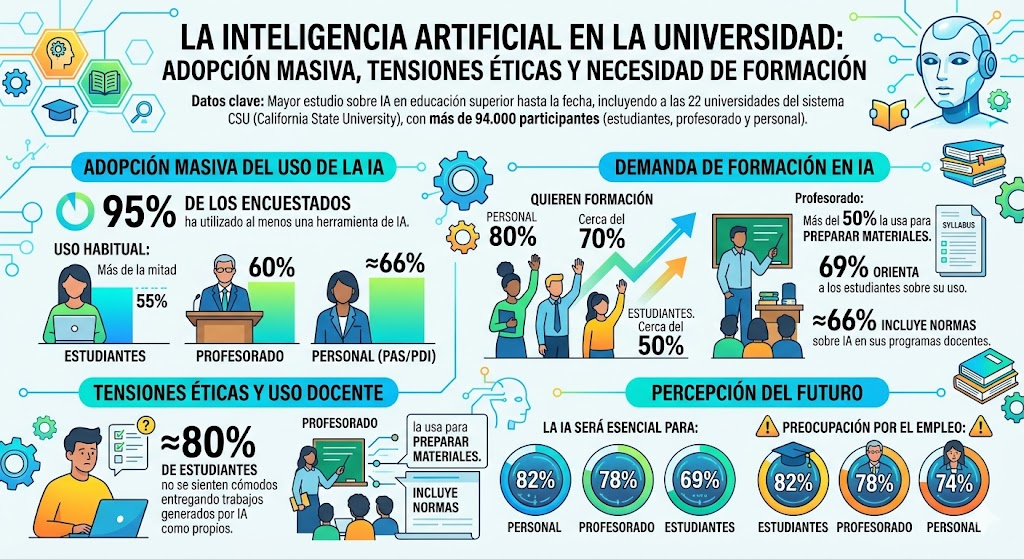

La incorporación de la inteligencia artificial generativa (IAG) en la educación ha supuesto una transformación profunda tanto en la producción académica como en los sistemas de evaluación. Más allá de una simple innovación tecnológica, se trata de un cambio pedagógico que obliga a replantear el papel del docente y los mecanismos tradicionales de verificación de la autoría. El uso generalizado de herramientas como ChatGPT ha intensificado las preocupaciones sobre el plagio y la deshonestidad intelectual, introduciendo nuevas formas de generación automatizada de textos que amplían el concepto clásico de copia.

En paralelo, diversos autores advierten que el uso excesivo de estas herramientas puede afectar negativamente al desarrollo del pensamiento crítico y la metacognición. Al ofrecer respuestas inmediatas y elaboradas, la IAG reduce la necesidad de análisis autónomo, lo que puede derivar en una dependencia tecnológica y en una pérdida de habilidades fundamentales para el aprendizaje profundo. Esto obliga a las instituciones a redefinir el concepto de plagio y a formar al alumnado en un uso ético y consciente de estas tecnologías.

Ante este escenario, han surgido herramientas de detección de contenido generado por IA, como Turnitin y Copyleaks, que emplean modelos estadísticos, lingüísticos y de aprendizaje automático para identificar patrones de escritura. Sin embargo, su eficacia es limitada: presentan márgenes de error significativos, especialmente frente a modelos generativos más avanzados, y existe un riesgo relevante de falsos positivos que puede derivar en acusaciones injustas. Además, las estrategias de evasión —como el parafraseo, la traducción o la manipulación textual— dificultan aún más la detección fiable.

Los resultados del estudio muestran que, aunque la IA ofrece oportunidades de personalización y mejora del aprendizaje, también incrementa prácticas deshonestas si no se regula adecuadamente. En este sentido, el problema no puede resolverse únicamente mediante herramientas tecnológicas, sino que exige una transformación de los modelos de evaluación hacia enfoques más auténticos, centrados en procesos, reflexión y participación activa del estudiante.

Desde una perspectiva pedagógica, se propone combinar el uso de la IA con estrategias evaluativas más complejas, como exámenes orales, proyectos colaborativos o actividades que valoren el proceso de aprendizaje. Asimismo, se subraya la importancia de la formación docente en inteligencia artificial y ética digital, ya que el profesorado debe estar preparado para integrar estas herramientas sin perder el control sobre la evaluación y el acompañamiento educativo.

En cuanto a las perspectivas futuras, destaca el desarrollo de la inteligencia artificial explicativa (XAI), orientada a hacer comprensibles los procesos de decisión de los sistemas automatizados. Esta línea permite avanzar hacia una evaluación más transparente y formativa, donde no solo importe el resultado, sino también la comprensión del proceso. Paralelamente, se señala la necesidad urgente de marcos normativos claros que regulen el uso de la IA en educación, como ya ocurre en la Unión Europea, frente a contextos donde aún existe un vacío legal.