The Economist. «Yuval Noah Harari argues that AI has hacked the operating system of human civilisation». Accedido 31 de julio de 2023.

Ver original

El historiador y filósofo afirma que los ordenadores narradores cambiarán el curso de la historia humana. La IA ha adquirido notables capacidades para manipular y generar lenguaje, ya sea con palabras, sonidos o imágenes. La IA ha pirateado el sistema operativo de nuestra civilización. El lenguaje es la materia de la que está hecha casi toda la cultura humana. Los derechos humanos, por ejemplo, no están inscritos en nuestro ADN.

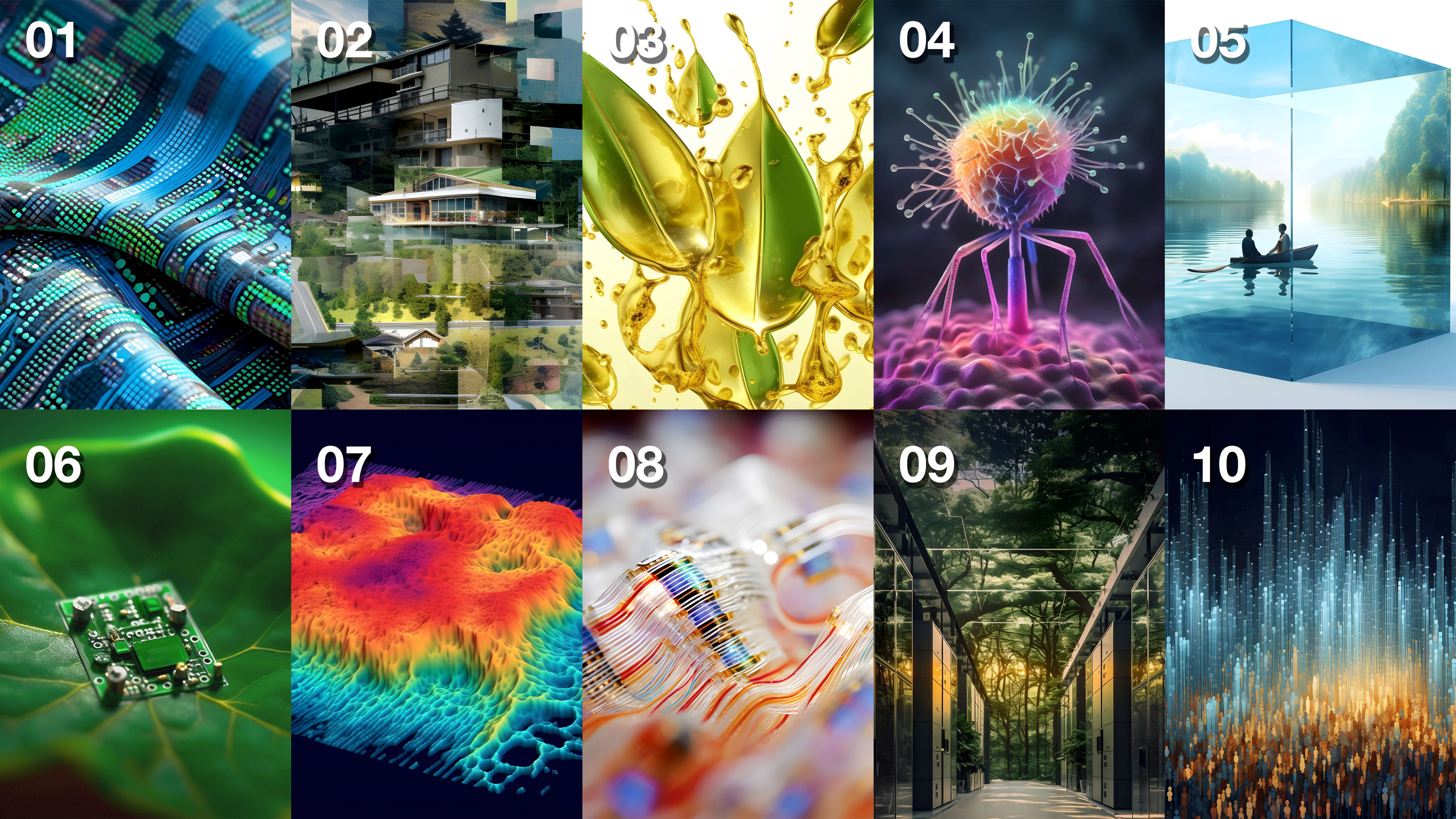

El miedo a la inteligencia artificial (IA) ha perseguido a la humanidad desde los albores de la era informática. Hasta ahora, estos temores se centraban en que las máquinas utilizaran medios físicos para matar, esclavizar o sustituir a los humanos. Pero en los dos últimos años han surgido nuevas herramientas de inteligencia artificial que amenazan la supervivencia de la civilización humana desde una dirección inesperada. La inteligencia artificial ha adquirido algunas capacidades notables para manipular y crear lenguaje, ya sean palabras, sonidos o imágenes. De este modo ha pirateado el sistema operativo de nuestra cultura.

El lenguaje es la materia de la que está hecha casi toda la civilización humana. Los derechos humanos, por ejemplo, no están escritos en nuestro ADN. Son más bien artefactos culturales que creamos contando historias y escribiendo leyes. Los dioses no son realidades físicas. Son más bien artefactos culturales que creamos inventando mitos y escribiendo escrituras «sagradas».

El dinero también es un artefacto cultural. Los billetes no son más que trozos de papel de colores, y actualmente más del 90% del dinero ni siquiera es un billete, sino información digital en ordenadores. Lo que da valor al dinero son las historias que nos cuentan sobre él banqueros, ministros de finanzas y gurús de las criptomonedas. Sam Bankman-Fried, Elizabeth Holmes y Bernie Madoff no eran especialmente buenos creando valor real, pero todos ellos eran narradores extremadamente capaces.

¿Qué pasaría cuando una inteligencia no humana fuera mejor que el ser humano medio contando historias, componiendo melodías, haciendo dibujos y redactando leyes y escrituras? Cuando la gente piensa en ChatGPT y otras nuevas herramientas de IA, a menudo le vienen a la cabeza ejemplos como el de los escolares que utilizan la IA para escribir sus redacciones. ¿Qué pasará con el sistema escolar cuando los niños hagan esto? Pero este tipo de pregunta no tiene en cuenta el panorama general. Olvídese de las redacciones escolares. Piensa en las próximas elecciones presidenciales de EE.UU. en 2024 e intenta imaginar el impacto de las herramientas de IA que pueden construirse para producir en masa contenido político, noticias falsas y escrituras «sagradas» para nuevas sectas.

En los últimos años, la «secta» qAnon se ha agrupado en torno a mensajes anónimos en línea conocidos como «gotas q». Los seguidores coleccionaban, veneraban e interpretaban estos q-drops como textos sagrados. Aunque, por lo que sabemos, todos los q drops anteriores fueron compuestos por humanos y los bots se limitaron a ayudar a difundirlos, en el futuro podríamos ver las primeras sectas de la historia cuyos textos sagrados fueron escritos por una inteligencia no humana. A lo largo de la historia, las religiones han reivindicado una fuente no humana para sus libros sagrados. Pronto podría ser una realidad.

En un nivel más mundano, puede que pronto nos encontremos manteniendo largas discusiones en línea sobre el aborto, el cambio climático o la invasión rusa de Ucrania con entidades que creemos humanas, pero que en realidad son inteligencias artificiales. Nuestro problema es que es completamente inútil que dediquemos tiempo a intentar cambiar los puntos de vista declarados de un bot de IA, cuando la IA podría afinar sus mensajes con tanta precisión que tiene muchas posibilidades de influir en nosotros.

Gracias a su dominio del lenguaje, podría incluso crear relaciones íntimas con las personas y utilizar el poder de la intimidad para cambiar nuestras opiniones y visiones del mundo. Aunque no hay indicios de que la IA tenga conciencia o emociones, para cultivar una falsa intimidad con los humanos basta con que la IA pueda hacer que se sientan emocionalmente unidos a ella. En junio de 2022, el ingeniero de Google Blake Lemoine afirmó públicamente que el chatbot Lamda, en el que trabajaba, se había vuelto sensible. La polémica afirmación le costó el puesto. Lo más interesante de este episodio no fue la afirmación del Sr. Lemoine, que era bastante falsa. Lo más interesante de este episodio no fue la afirmación de Lemoine, que era bastante falsa, sino su voluntad de arriesgar su lucrativo empleo por el chatbot de inteligencia artificial.Si la IA puede influir en las personas para que arriesguen sus empleos por ella, ¿qué más podría motivarlas a hacer?

En una batalla política por «mentes y corazones» [σ.σ. όταν επιδιώκεται επικράτηση όχι με τη χρήση ισχύος, αλλά μέσω συναισθηματικών ή διανοητικών εκκλήσεων], la intimidad es el arma más eficaz y acaba de adquirir la capacidad de producir en masa relaciones íntimas con millones de personas. Todos sabemos que en la última década las redes sociales se han convertido en un campo de batalla para controlar la atención de la gente. Con la nueva generación de inteligencia artificial, el frente de batalla está pasando de la atención a la intimidad. ¿Qué ocurrirá con la sociedad y la psicología humanas cuando una IA compita con otra en una batalla fingiendo relaciones íntimas con nosotros, que luego pueden utilizarse para persuadirnos de que votemos a determinados políticos o compremos determinados productos?

Incluso sin crear una «falsa familiaridad», las nuevas herramientas de IA tendrían una enorme influencia en nuestras opiniones y visiones del mundo. La gente podría llegar a utilizar a un único asesor de IA como un oráculo omnisciente. No es de extrañar que Google esté aterrorizado. ¿Para qué molestarse en buscar si puedo preguntar al oráculo? Las industrias periodística y publicitaria también deberían estar horrorizadas.¿Para qué leer un periódico si puedo preguntar al adivino para enterarme de las últimas noticias?¿Y qué sentido tienen los anuncios cuando puedo pedirle a la adivina que me diga qué comprar?

E incluso esos escenarios no captan realmente el panorama general. De lo que estamos hablando es potencialmente del fin de la historia humana. No el fin de la historia, sino el fin de la parte de ella dominada por los humanos. La historia es la interacción entre la biología y la cultura. Entre nuestras necesidades y deseos biológicos de cosas como la comida y el sexo, y nuestras creaciones culturales como las religiones y las leyes. La historia es el proceso a través del cual las leyes y las religiones dan forma a la comida y al sexo.

Qué ocurrirá con el curso de la historia cuando [η τεχνητή νοημοσύνη] se apoderen de la civilización y empiecen a producir historias, melodías, leyes y religiones? Herramientas anteriores como la imprenta y la radio ayudaron a difundir las ideas culturales humanas, pero nunca crearon nuevas ideas culturales propias.

La inteligencia artificial es algo fundamentalmente diferente. Puede crear ideas completamente nuevas, una cultura completamente nueva.

Al principio, es probable que la IA imite los modelos humanos en los que se formó en su infancia. Pero con cada año que pase, la cultura de la IA irá audazmente donde ningún humano ha ido antes [σ.σ. σλόγκαν από την τηλεοπτική σειρά Star Trek].Durante milenios los seres humanos han vivido en sueños ajenos. En las próximas décadas podríamos encontrarnos viviendo en los sueños de una inteligencia extraterrestre.

El miedo a la inteligencia artificial sólo ha acechado a la humanidad durante las últimas décadas. Pero durante miles de años la gente ha sido perseguida por un miedo mucho más profundo. Siempre hemos reconocido el poder de las narraciones y las imágenes para manipular nuestras mentes y crear ilusiones. En consecuencia, desde la antigüedad la gente ha temido quedar atrapada en un mundo de ilusiones.