2023 EDUCAUSE Horizon Action Plan: Generative AI. EDUCASE, 2023

En 2023, la IA generativa surgió como la tecnología más rápidamente adoptada de la historia. Todos los miembros de la comunidad de la enseñanza superior, desde los estudiantes hasta los administradores, están intentando determinar qué impacto pueden, quieren y deben tener las herramientas de IA generativa en la vida, el aprendizaje y el trabajo. Para complicar aún más las cosas, no hay consenso sobre cómo o incluso si la IA generativa debe desempeñar un papel en el futuro de la enseñanza superior.

Sobre la base de las tendencias, tecnologías y prácticas descritas en el Informe EDUCAUSE Horizon 2023: Edición sobre Enseñanza y Aprendizaje, el panel del informe elaboró su visión del futuro junto con acciones prácticas que los individuos, las unidades y los departamentos, y los grupos de colaboradores pueden llevar a cabo para hacer realidad este futuro.

Los panelistas generaron una lista de acciones que los individuos, unidades y departamentos, y equipos multiunidad o multiinstitucionales pueden tomar para lograr este futuro preferido en 10 años.

Individuos

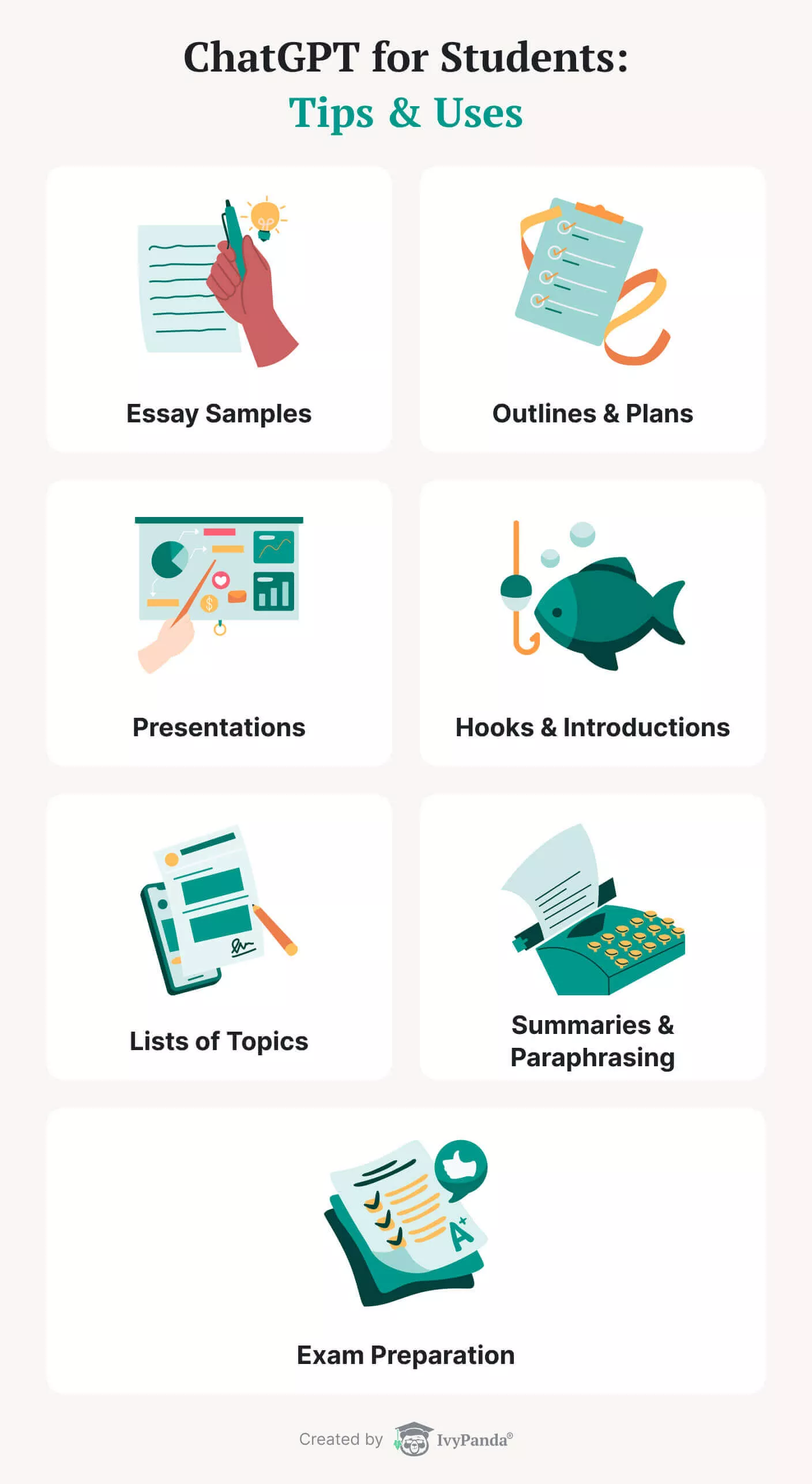

- Cultivar una cultura de experimentación. Fomentar que profesores, estudiantes y personal experimenten con la inteligencia artificial (IA) proporcionando tiempo dedicado, incentivos y acceso a herramientas y oportunidades de descubrimiento. La experimentación fomentará la agencia del usuario, la innovación y la creatividad. También ayudará a las personas a adoptar nuevas tecnologías y a reducir la brecha digital.

- Establecer una comunidad de práctica. Crear un entorno seguro y controlado, como un «sandbox» de IA, donde profesores, personal y estudiantes puedan colaborar y experimentar con herramientas y aplicaciones de IA sin riesgo para los sistemas de producción.

- Establecer la inclusión de las partes interesadas como una mejor práctica. Fomentar la colaboración entre grupos, incluyendo a estudiantes y partes interesadas externas (por ejemplo, la educación K-12 y la industria). Crear comunidades de aprendizaje entre pares donde las partes interesadas puedan compartir experiencias, desafíos y mejores prácticas, y fomentar la colaboración y proyectos interdisciplinarios que exploren aplicaciones innovadoras de la IA en diversos campos.

- Brindar oportunidades de autoeducación. Ofrecer recursos de fácil acceso, como cursos en línea y tutoriales, seminarios web y talleres, y materiales educativos como manuales, guías y estudios de casos que introduzcan a profesores, personal y estudiantes en conceptos, aplicaciones y mejores prácticas de la IA.

- Invertir en y apoyar iniciativas continuas de alfabetización en IA. Desarrollar programas de capacitación y recursos integrales en toda la institución que personas con diferentes niveles de experiencia técnica puedan entender y utilizar, y crear un repositorio de recursos educativos actualizados regularmente relacionados con la integración de la IA en la educación superior.

- Asegurarse de que los profesores tengan acceso a herramientas de IA. Proporcionar a los profesores las herramientas y plataformas que necesitan para experimentar e incorporar la IA en sus actividades de enseñanza e investigación. Proporcionarles un sistema de apoyo adecuado que incluya expertos en IA que puedan brindar orientación y asistencia a los profesores a medida que integran la IA en su enseñanza e investigación.

- Aumentar el compromiso de las partes interesadas con la ética. Ayudar a las partes interesadas a comprometerse a ser usuarios éticos de la IA proporcionando formación y recursos exhaustivos y actualizados sobre ciberseguridad, privacidad y usos efectivos versus ineficaces de la IA, junto con los riesgos y beneficios de su uso.

- Establecer roles de facilitador de IA en los campus. Los facilitadores pueden ayudar a profesores y personal a navegar su identidad como usuarios y educadores de IA. Implementar oportunidades de desarrollo profesional y recursos como capacitaciones, talleres, programas de coaching y mentoría, comunidades de aprendizaje entre pares y materiales educativos para ayudar a profesores y personal a convertirse en facilitadores. Establecer sistemas de reconocimiento y recompensa que reconozcan a quienes se destaquen en sus roles de facilitadores de apoyo.

- Ser un líder comprometido. Apoyar a tus colegas en el viaje generativo de la IA participando regularmente en oportunidades de desarrollo profesional y capacitación, lo que te ayudará a tomar decisiones bien informadas y audaces sobre las nuevas políticas institucionales. Proporcionar tiempo dedicado para comunicarte con unidades y departamentos sobre cuestiones importantes relacionadas con el uso de la IA en tu institución.

Unidades y Departamentos

- Reimagina el plan de estudios y las evaluaciones. Ayuda a los profesores a incorporar la inteligencia artificial (IA) en los cursos de manera que se creen experiencias de aprendizaje más personalizadas y auténticas, al mismo tiempo que se incentive el aprendizaje, la creatividad y la innovación sobre las calificaciones. Anima a las unidades y departamentos a utilizar un enfoque colaborativo y basado en evidencia, y proporciónales tiempo y presupuesto para la reconfiguración, junto con un proceso de revisión de currículo actualizado.

- Capacita a las futuras generaciones de usuarios de la IA. Anima a las unidades y departamentos a pensar de manera continua en cómo evolucionará la IA con el tiempo y en diversas disciplinas para que puedan anticipar, identificar y reconocer las nuevas habilidades y conocimientos que los estudiantes necesitan tanto ahora como en el futuro.

- Emplea o forma a especialistas en integración de la IA. Estos especialistas pueden evaluar las necesidades de comunicación y colaboración dentro de las unidades y departamentos, e identificar oportunidades para soluciones impulsadas por la IA.

- Invierte en una infraestructura centralizada de IA de última generación. La infraestructura debe incluir recursos de informática de alto rendimiento, servicios en la nube y herramientas de desarrollo de IA para respaldar los esfuerzos de investigación e implementación. Proporciona acceso compartido a herramientas de IA, almacenamiento de datos y soporte técnico para todas las unidades y departamentos.

- Ofrece un soporte de TI dedicado. Asegúrate de que cada unidad y departamento cuente con soporte de TI para abordar problemas técnicos relacionados con la integración de la IA y la colaboración. Emplea un equipo de soporte técnico en toda la institución para ayudar a los departamentos en la implementación, integración y resolución de problemas de soluciones de IA.

- Desarrolla protocolos y pautas departamentales. Establece pautas que aborden la seguridad, privacidad y gestión de datos, y asegura que la información sensible compartida a través de herramientas impulsadas por la IA esté segura y cumpla con las regulaciones de protección de datos.