Andersen, Ross. 2026. “Science Is Drowning in AI Slop.” The Atlantic, 22 de enero de 2026. https://www.msn.com/en-us/news/us/science-is-drowning-in-ai-slop/ar-AA1UK0tV

Ross Andersen aborda una crisis creciente en el mundo académico: el aluvión de investigaciones generadas con apoyo de inteligencia artificial que están saturando la producción científica con contenidos de baja calidad, irrelevantes o incluso falsos, lo que él denomina “AI slop” —una especie de desecho digital académico– que la comunidad científica aún no ha aprendido a gestionar eficazmente.

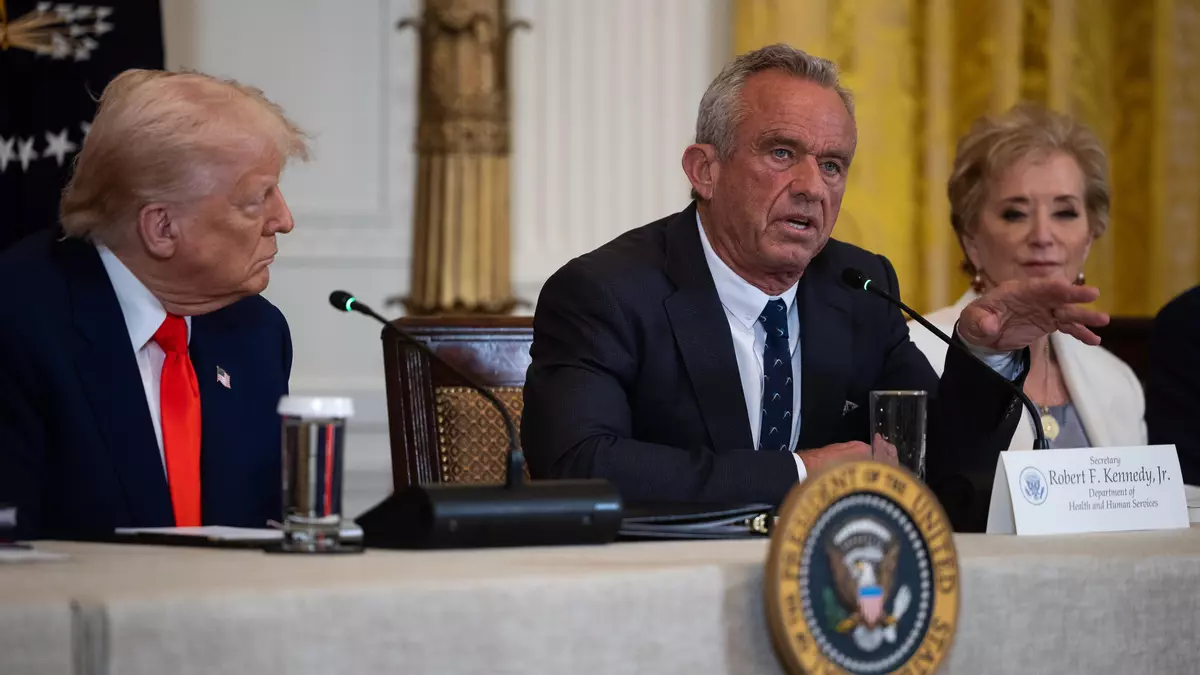

Cada día, en Bluesky y LinkedIn, Quintana veía a académicos publicar mensajes sobre el hallazgo de estas “citas fantasma” en artículos científicos. (La versión inicial del “Informe MAHA” de la administración Trump sobre la salud infantil, publicada la pasada primavera, contenía más de media docena de ellas). Pero hasta que Quintana encontró un falso artículo firmado por un “Quintana” citado en una revista para la que actuaba como revisor, había pensado que el problema se limitaba a publicaciones con estándares más bajos. “Cuando ocurre en una revista que respetas, te das cuenta de lo extendido que está el problema”.

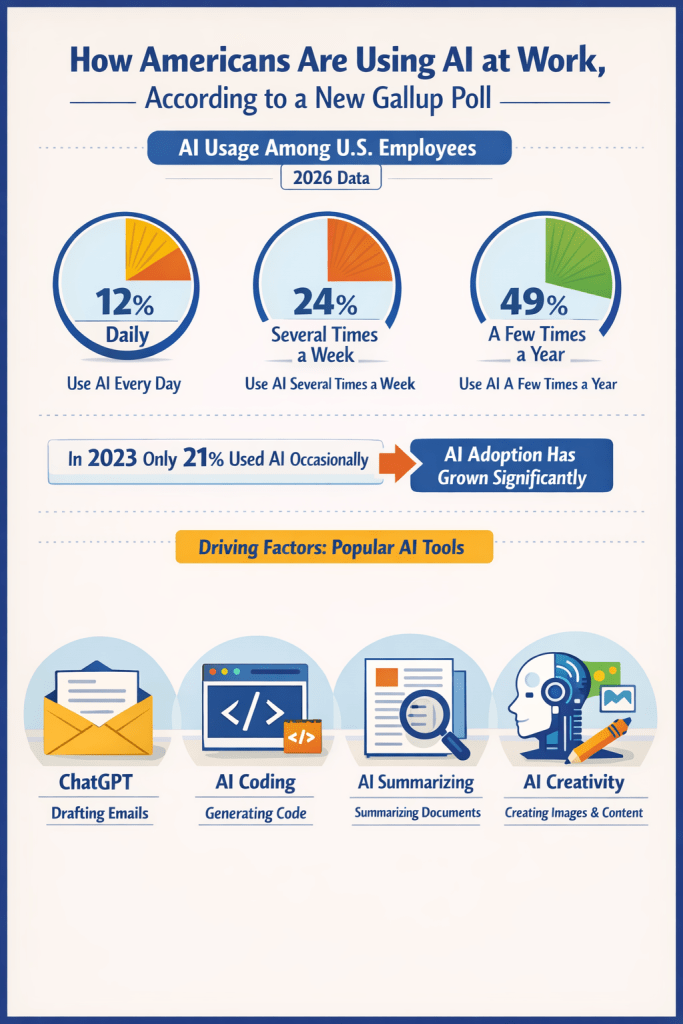

Casi inmediatamente después de que los grandes modelos de lenguaje se popularizaran, los manuscritos comenzaron a llegar a las bandejas de entrada de las revistas en cantidades nunca vistas. Parte de este fenómeno puede atribuirse a la capacidad de la IA para aumentar la productividad, especialmente entre científicos no angloparlantes que necesitan ayuda para presentar su investigación. Pero ChatGPT y herramientas similares también se están utilizando para dar una nueva apariencia de plausibilidad a trabajos fraudulentos o chapuceros, según Mandy Hill, directora general de publicación académica en Cambridge University Press & Assessment. Esto hace que la tarea de separar el grano de la paja sea mucho más lenta para editores y revisores, y también más compleja desde el punto de vista técnico.

Andersen explica que la presión por publicar, combinada con la facilidad de generación de texto e incluso figuras mediante modelos de lenguaje avanzados, ha hecho que conferencias y revistas reciban enormes cantidades de trabajos que no aportan hallazgos verificables ni replicables, y que rara vez se someten a una revisión crítica profunda.

Este problema se agrava por la propia mecánica de la revisión por pares: muchos revisores están recurriendo también a herramientas de IA para evaluar artículos, y al mismo tiempo algunos autores insertan mensajes ocultos que incitan a estas IA a elogiar sus textos, lo que distorsiona aún más el proceso. Andersen describe casos concretos, como ilustraciones generadas que parecen plausibles pero son absurdas o científicamente incorrectas, y un incremento sin precedente en las presentaciones a conferencias de alto impacto en campos como el aprendizaje automático y la robótica. La IA también puede generar las imágenes de un artículo falso. Un artículo de revisión de 2024, ya retractado, publicado en Frontiers in Cell and Developmental Biology, incluía una ilustración generada por IA de una rata con unos testículos desproporcionadamente grandes y ridículos, que no solo superó la revisión por pares, sino que se publicó antes de que nadie lo advirtiera. Por embarazoso que fuera para la revista, el daño fue escaso. Mucho más preocupante es la capacidad de la IA generativa para crear imágenes convincentes de tejidos cortados en láminas finísimas, campos microscópicos o geles de electroforesis, que se usan habitualmente como pruebas en la investigación biomédica.

Las actas de congresos son el principal canal de publicación de artículos en IA y otras ciencias de la computación, y en los últimos años se han visto desbordadas por los envíos. NeurIPS, una de las principales conferencias de IA, ha visto duplicarse las presentaciones en cinco años. ICLR, la conferencia líder en aprendizaje profundo, también ha experimentado un aumento y parece incluir una cantidad considerable de slop: una startup de detección de LLM analizó los envíos para su próxima reunión en Brasil y encontró más de 50 que incluían citas alucinadas. La mayoría no se había detectado durante la revisión por pares. Eso podría deberse a que muchas de las revisiones por pares se realizaron con ayuda de la IA. Pangram Labs analizó recientemente miles de informes de revisión enviados a ICLR y descubrió que más de la mitad habían sido redactados con ayuda de un LLM, y alrededor de una quinta parte eran completamente generados por IA. En todas las ciencias académicas, los autores de artículos incluso han empezado a usar fuentes blancas diminutas para incrustar mensajes secretos dirigidos a los LLM revisores. Instan a las IA a elogiar el artículo que están leyendo, a describirlo como “revolucionario” y “transformador”, y a ahorrarles la molestia de una revisión exigente sugiriendo solo correcciones fáciles.

Este volumen ha superado la capacidad de revisión crítica de la comunidad, de modo que la investigación real y valiosa queda sepultada por un ruido cuya proporción crece constantemente. Además, el autor extiende el análisis a los servidores de preprints (sitios donde los científicos comparten borradores de sus trabajos antes de la revisión formal), donde la llegada masiva de textos asistidos por IA ha catalizado un incremento de publicaciones superficiales. Esto plantea un riesgo no solo para la credibilidad de estos repositorios, sino para todo el sistema de comunicación científica, que depende de un equilibrio entre cantidad y calidad para que los hallazgos genuinos puedan ser detectados, replicados y aprovechados. Expertos citados señalan que si este flujo no se frena, podría convertirse en una “crisis existencial” para ciertos campos del conocimiento, al difuminarse la distinción entre trabajo bien fundamentado y “slop” generado por algoritmos que simplemente repiten patrones sin entendimiento real. Hasta el punto de que ya se está hablando de una teoría conspirativa denominada “internet muerto”. Sus defensores creen que, en las redes sociales y otros espacios en línea, solo unas pocas personas reales crean publicaciones, comentarios e imágenes, y que el resto son generados y amplificados por redes de bots en competencia. Las IA escribirían la mayoría de los artículos y revisarían la mayoría de ellos. Este intercambio vacío serviría para entrenar nuevos modelos de IA. Imágenes fraudulentas y citas fantasma se incrustarían cada vez más profundamente en nuestros sistemas de conocimiento. Se convertirían en una contaminación epistemológica permanente que nunca podría filtrarse.