Cox, Andrew M. AI and the UK Library Profession: Survey Results — A Report for CILIP. London: CILIP, 2025

El informe analiza cómo los profesionales de bibliotecas e información en el Reino Unido están incorporando la Inteligencia Artificial (IA) en su trabajo, cuáles son sus percepciones y qué apoyos necesitan.

La encuesta, realizada entre noviembre y diciembre de 2024, recogió 162 respuestas válidas procedentes principalmente de bibliotecas universitarias, de salud y públicas. El objetivo del estudio fue conocer no solo el nivel de adopción de estas tecnologías, sino también las oportunidades, riesgos y necesidades que identifican los bibliotecarios.

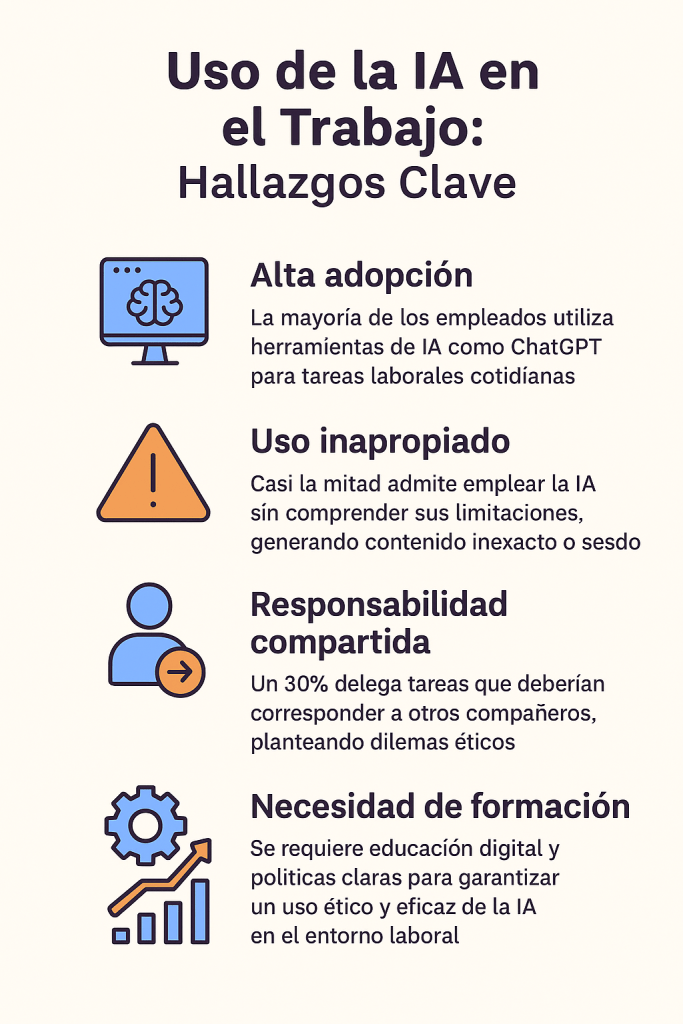

El resultado más llamativo es que un 65 % de los participantes reconoció estar utilizando herramientas de IA en su trabajo cotidiano. Entre las más citadas se encuentran ChatGPT y Copilot, empleadas sobre todo para tareas de redacción, búsqueda de información y automatización de procesos rutinarios. El uso resulta más extendido en bibliotecas universitarias y de salud, mientras que en las públicas todavía es más moderado. Pese a esta presencia creciente, solo un tercio de las instituciones encuestadas contaba ya con una política específica sobre IA y otro cuarto estaba en proceso de desarrollarla, lo que indica que todavía existe un marco normativo y estratégico insuficiente.

En cuanto a los ámbitos de aplicación, el informe destaca el uso de la IA generativa para redactar borradores de documentos, apoyar la alfabetización digital de los usuarios e integrar la enseñanza crítica de estas tecnologías en programas formativos. También se la emplea en la síntesis de información y en la mejora de procesos internos, con el fin de ganar eficiencia administrativa y liberar tiempo para otras tareas de valor añadido. Todo ello revela que la profesión percibe la IA como una herramienta práctica y útil, aunque aún en fase exploratoria.

Los encuestados identificaron varias oportunidades relacionadas con la IA. Entre ellas figuran la posibilidad de mejorar la eficiencia de los servicios bibliotecarios, reforzar las competencias en análisis y gestión de datos, enriquecer la experiencia de los usuarios y desarrollar nuevas funciones profesionales ligadas a la enseñanza y mediación tecnológica. Sin embargo, junto a estos beneficios emergen preocupaciones importantes que frenan una adopción plena.

Las principales barreras son de naturaleza ética, económica y técnica. En el terreno ético, se señalaron riesgos como la falta de transparencia, los sesgos de los algoritmos, la generación de desinformación y los problemas de privacidad. Desde el punto de vista económico, muchas instituciones consideran que el coste de las soluciones comerciales de IA resulta excesivo. También se subraya el impacto ambiental que puede tener el uso intensivo de estas tecnologías, especialmente por el alto consumo energético de los sistemas. A todo ello se suma la percepción de un déficit de competencias técnicas dentro de la profesión, que limita el aprovechamiento de las herramientas disponibles, y las dudas legales vinculadas a los derechos de autor y la propiedad intelectual en relación con los contenidos generados por IA.

Frente a este panorama, los profesionales expresaron con claridad sus necesidades de apoyo. La mayoría reclama formación accesible en distintos formatos —cursos cortos, seminarios web o materiales escritos— que les permita adquirir un conocimiento práctico y actualizado. También demandan guías éticas y regulatorias que orienten el uso responsable de la IA, así como ejemplos concretos de buenas prácticas adaptadas a diferentes tipos de bibliotecas. Se espera además que CILIP desempeñe un papel de liderazgo institucional, actuando como referente en la elaboración de políticas, en la difusión de recursos y en la representación del sector en los debates públicos y regulatorios sobre la IA.

El estudio muestra que la IA se ha integrado de forma significativa en el trabajo bibliotecario del Reino Unido, aunque de manera desigual y todavía experimental. Los profesionales reconocen tanto sus beneficios como los riesgos que entraña, y existe una demanda clara de liderazgo, formación y marcos normativos que permitan gestionar esta integración de manera responsable. El informe refleja un sector en transformación, que avanza con cautela pero con la convicción de que la IA será una pieza clave en el futuro de las bibliotecas.