Kiermer, Véronique, Alison Mudditt, and Niamh O’Connor. «Rethinking How We Publish to Support Open Science.» Leap: The Journal of Open Science 1, no. 1 (2025): 1-15. https://doi.org/10.1002/leap.2006

Se analiza cómo las publicaciones científicas pueden avanzar hacia un modelo que apoye la ciencia abierta. La clave de este cambio radica en ampliar la gama de contribuciones a la investigación que se muestran y reutilizan, lo cual permitirá una mayor diversidad de participantes y perspectivas, esenciales para una investigación confiable.

La llegada de la era digital ha transformado la manera en que creamos y consumimos información. En el ámbito de la investigación, este cambio abre nuevas oportunidades para practicar la ciencia abierta, permitiendo que una gama más amplia de contribuciones sea visibilizada y reutilizada. Aunque este avance se predijo cuando los primeros diarios aparecieron en línea, ha tardado más de lo esperado en materializarse. Los flujos de trabajo de la investigación han cambiado significativamente en las últimas décadas gracias a la capacidad de recopilar grandes cantidades de datos, analizarlos con más potencia computacional y colaborar en línea. Sin embargo, la publicación científica ha quedado rezagada. Aunque los artículos se procesan y distribuyen mayoritariamente de forma digital, los flujos de trabajo y conceptos fundamentales de la publicación siguen siendo vestigios de la era de la impresión.

Este estancamiento debe cambiar, ya que las revistas han servido históricamente como garantes de la calidad mediante la supervisión editorial y la revisión por pares. Sin embargo, las normas del siglo XX se basaban en un modelo que solo permitía la publicación de aquellos autores con credenciales conocidas. Este enfoque es obsoleto, y comunicar la investigación en la actualidad requiere una ampliación de esta visión. Es necesario repensar cómo evaluamos, compartimos y descubrimos la investigación, todo ello dentro de un ecosistema de ciencia abierta.

La importancia de la ciencia abierta

La ciencia abierta no se trata solo de hacer que un artículo sea accesible, sino de proporcionar el contexto necesario para comprenderlo, los recursos para replicar el trabajo y las herramientas para colaborar y mejorar la ciencia. Uno de los aspectos esenciales de la ciencia abierta es la ampliación de la participación en la creación, difusión y reutilización del conocimiento. Este modelo permite que más investigadores y otras partes interesadas se beneficien de la creación de conocimiento, algo que se alinea con el informe de la Academia Nacional de Ciencias de EE.UU., el cual señala que la ciencia realizada de manera abierta y transparente tiene más probabilidades de producir conocimientos confiables. La transparencia y la apertura son cruciales para garantizar que la investigación resista el escrutinio, así como para permitir que los mecanismos autocorrectivos de la ciencia funcionen eficazmente.

El informe de la UNESCO sobre Ciencia Abierta también refuerza este enfoque, al destacar la necesidad de diversidad en la participación, lo cual contribuye a una creación de conocimiento más confiable y efectiva. Para lograr una ciencia abierta efectiva, se deben abrir las puertas a una mayor variedad de perspectivas, tal como lo sugieren investigadores como Naomi Oreskes, quien defiende que la diversidad de comunidades de búsqueda de conocimiento es fundamental para alcanzar un conocimiento objetivo.

Obstáculos para la ciencia abierta

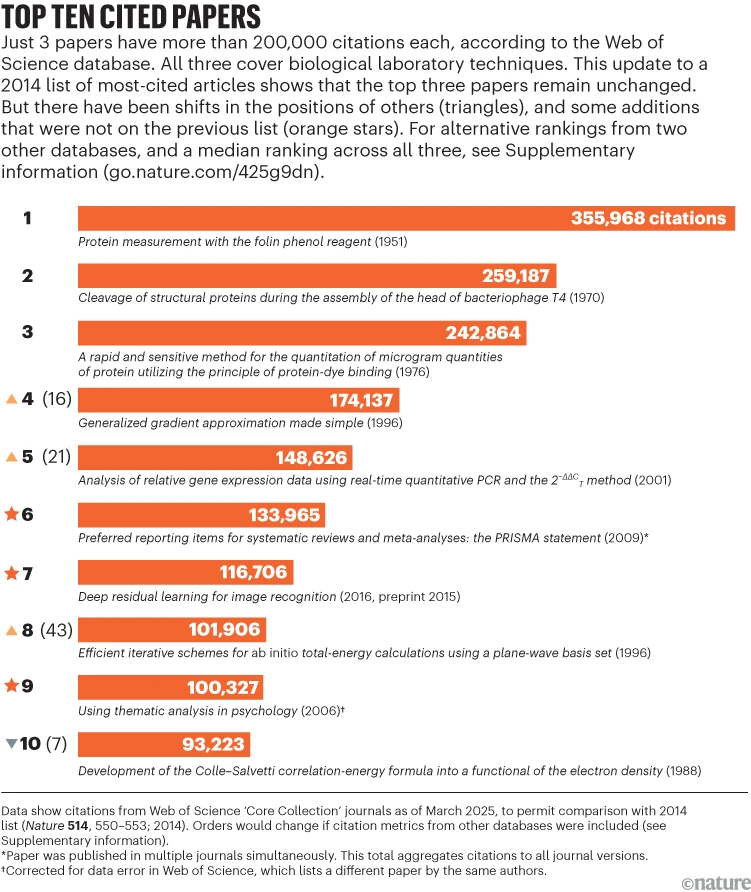

A pesar de los avances en el acceso abierto y las políticas de ciencia abierta, todavía existen importantes obstáculos. Uno de ellos radica en el hecho de que la publicación sigue centrada en los artículos, un vestigio del paradigma impreso que no valora de igual manera otros tipos de resultados de investigación, como los datos, los códigos y los protocolos. A pesar de que el porcentaje de artículos con declaraciones de disponibilidad de datos ha aumentado, la mayoría de los datos aún están disponibles solo «a solicitud» o a través de archivos de información adicional asociados a los artículos. El principal impedimento para compartir datos abiertos es la falta de reconocimiento y crédito para los investigadores que hacen estos datos accesibles. Para que la ciencia abierta se adopte de manera generalizada, es necesario que los diferentes tipos de resultados de investigación sean reconocidos, accesibles y acreditados adecuadamente.

Otro obstáculo importante es el modelo de negocio basado en las tarifas por publicación (APCs), que aunque ha facilitado el acceso abierto, excluye a muchos investigadores e instituciones que no pueden permitirse estos costos. A pesar de que se han implementado modelos no basados en APC, como el modelo de Publicación de Acción Comunitaria de PLOS, estos no son fácilmente escalables. Además, el modelo de APC sigue siendo dominante y muchas veces favorece a las grandes editoriales, perpetuando las desigualdades en el acceso al conocimiento.

El rol de los editores en la investigación

Los editores desempeñan un papel crucial en el ecosistema de la investigación, contribuyendo a la creación de conocimiento e innovación en varias etapas clave, como el financiamiento, la actividad investigadora, la difusión de los resultados y la innovación. A lo largo del ciclo de investigación, los editores facilitan la colaboración, el debate, la evaluación de calidad y la preservación de los resultados. Aunque el sistema de evaluación tradicional mediante revisión por pares sigue siendo importante, los editores deben adaptarse a nuevos modelos que respalden una ciencia abierta, permitiendo la vinculación y el descubrimiento de una variedad de contribuciones más allá de los artículos tradicionales.

Catalizando el cambio desde dentro de la publicación

El cambio hacia un modelo de ciencia abierta es un desafío complejo que requiere la colaboración de múltiples actores. PLOS, una organización pionera en este campo, ha comenzado un proyecto de Investigación y Diseño para definir los elementos clave de un nuevo modelo de publicación que se base en los principios de la ciencia abierta, con un modelo de negocio sostenible. Este proyecto incluye una consulta con diversos actores del ecosistema de investigación para garantizar que las soluciones propuestas sean inclusivas y accesibles para una amplia gama de investigadores e instituciones, especialmente en el contexto de las disparidades globales.

A través de esta iniciativa, PLOS espera catalizar un cambio sistémico en la publicación científica, promoviendo un modelo más inclusivo y accesible que permita la participación activa de más comunidades en la creación y difusión del conocimiento.