«71% of Americans Fear That AI Will Put Too Many People Out of Work Permanently.» ZDNet, 2025. https://www.zdnet.com/article/71-of-americans-fear-that-ai-will-put-too-many-people-out-of-work-permanently/.

Un estudio de ZDNet revela que el 71% de los estadounidenses teme que la inteligencia artificial (IA) elimine permanentemente demasiados empleos.

Un reciente sondeo realizado por Reuters e Ipsos revela que la mayoría de los estadounidenses está preocupada por los posibles impactos de la inteligencia artificial (IA) en diversos ámbitos, como el mercado laboral y la estabilidad política. La encuesta, realizada a 4,446 adultos en Estados Unidos, indica que el 71% teme que la IA desplace permanentemente a un número inaceptablemente alto de trabajadores, especialmente en roles de procesamiento de información y comunicación, como traductores y representantes de servicio al cliente. Esta preocupación coincide con predicciones de líderes del sector tecnológico, como los CEOs de Anthropic, OpenAI y Amazon, sobre el potencial de sus herramientas de IA para reemplazar a trabajadores humanos. Hasta el momento, los efectos concretos sobre el empleo han sido limitados, aunque algunos recién graduados en informática han encontrado más dificultades para ingresar al sector tecnológico.

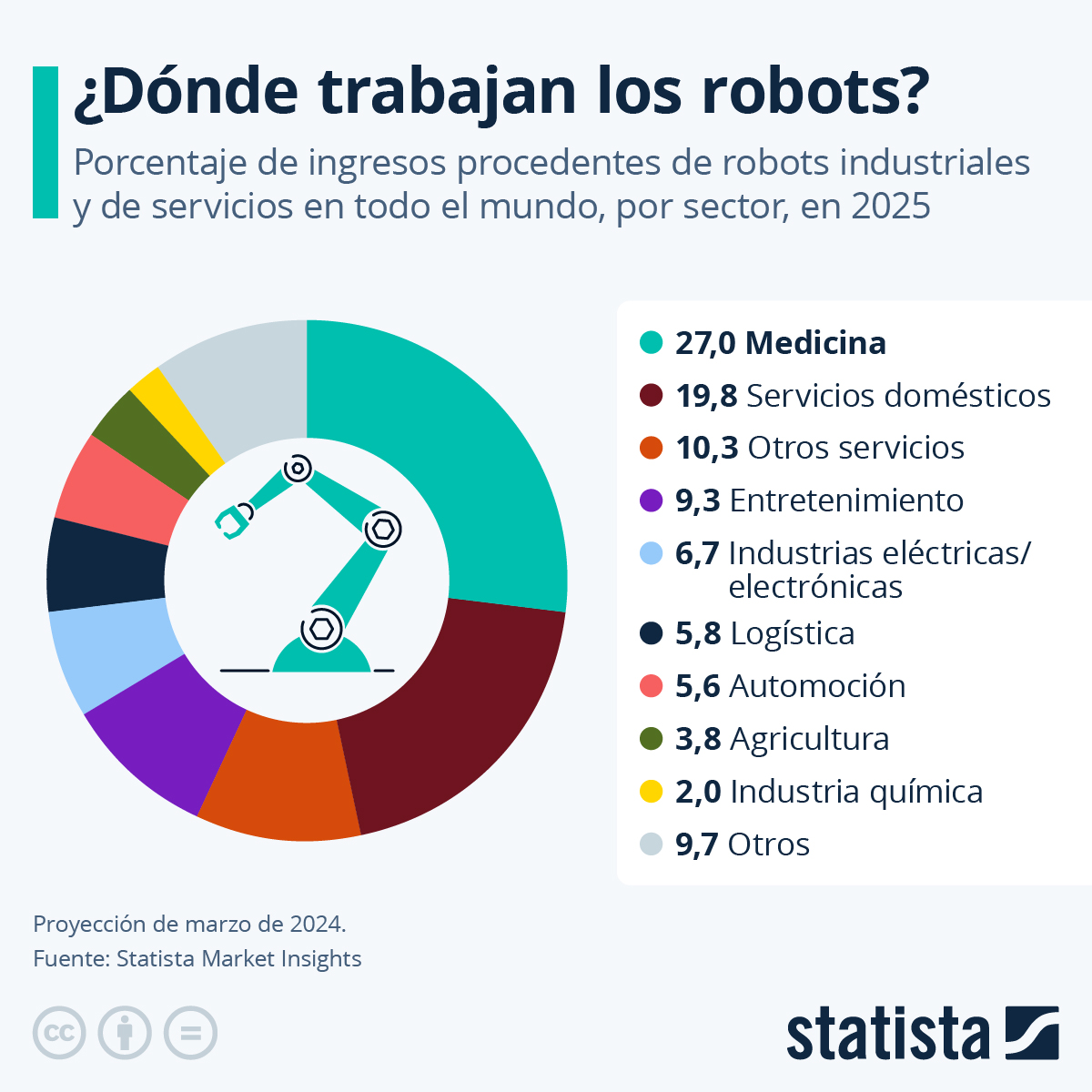

Sin embargo, también hay un reconocimiento de que la IA podría generar nuevos empleos y mejorar la productividad en ciertos sectores. A pesar de ello, persiste la preocupación sobre cómo se gestionará la transición laboral y si los trabajadores podrán adaptarse a los cambios tecnológicos., el 60% de los participantes cree que la IA podría afectar.

El sondeo también señala otras inquietudes sobre la IA. Más del 77% de los encuestados temen el “caos político” que podrían generar rivales internacionales de Estados Unidos mediante el uso de estas herramientas. Este temor se fundamenta en la proliferación de deepfakes y modelos avanzados de texto a voz que facilitan la suplantación de personas y la manipulación de la opinión pública. Por ejemplo, el informe anual de OpenAI de 2025 documenta operaciones de origen probablemente chino que utilizaron ChatGPT para generar publicaciones y comentarios falsos en redes sociales con fines políticos..

Además, la encuesta refleja preocupaciones sobre la erosión de las relaciones interpersonales debido a los compañeros virtuales impulsados por IA (66%) y sobre el alto consumo energético de estas tecnologías (61%). En conjunto, estos hallazgos subrayan que la sociedad estadounidense percibe la IA no solo como un desafío laboral, sino también como un riesgo político, social y ambiental que requiere atención y regulación..