Kastrenakes, Jacob. «Hope, fear, and AI». The Verge, 26 de junio de 2023. https://www.theverge.com/c/23753704/ai-chatgpt-data-survey-research.

La IA está a punto de cambiar el mundo, pero nadie sabe muy bien cómo. Algunos observan los rápidos avances del año pasado y ven oportunidades para eliminar limitaciones creativas, automatizar el trabajo rutinario y descubrir nuevas formas de aprender y enseñar. Otros ven cómo esta tecnología puede alterar nuestras vidas de formas más perjudiciales: cómo puede generar desinformación, destruir o reducir puestos de trabajo y, si no se controla, suponer una grave amenaza para nuestra seguridad.

Líderes tecnológicos, legisladores e investigadores se han pronunciado sobre cómo debemos manejar esta tecnología emergente. Algunas figuras de la industria, como Sam Altman, CEO de OpenAI, quieren que los gigantes de la IA dirijan la regulación, desplazando el foco a las amenazas futuras percibidas, incluido el «riesgo de extinción». Otros, como los políticos de la UE, están más preocupados por los peligros actuales y por prohibir los casos de uso peligrosos (mientras frenan las aplicaciones positivas, dicen los escépticos). Mientras tanto, a muchos pequeños artistas sólo les gustaría tener la garantía de que no serán sustituidos por máquinas.

Para averiguar qué piensa realmente la gente sobre la IA y qué quiere de ella, The Verge se asoció con el equipo de Insights and Research de Vox Media y la consultora de investigación The Circus para encuestar a más de 2.000 adultos estadounidenses sobre sus pensamientos, sentimientos y temores acerca de la IA. Los resultados cuentan la historia de una tecnología emergente, incierta y emocionante, en la que muchos aún no la han utilizado, muchos temen su potencial y muchos aún tienen grandes esperanzas de lo que algún día podría hacer por ellos.

¿Quién utiliza la IA?

De repente, la IA está en todas partes. Los generadores de imágenes y los grandes modelos lingüísticos están en el centro de nuevas empresas, impulsando funciones dentro de nuestras aplicaciones favoritas y, lo que es quizás más importante, impulsando el debate no sólo en el mundo de la tecnología, sino también en la sociedad en general. Abundan las preocupaciones sobre las trampas en las escuelas con ChatGPT, los engaños con imágenes generadas por IA y los artistas estafados o incluso sustituidos.

Pero a pesar de la amplia cobertura informativa, el uso de estas nuevas herramientas sigue siendo bastante limitado, al menos en lo que se refiere a productos dedicados a la IA. Y la experiencia con estas herramientas se inclina decididamente hacia los usuarios más jóvenes.

Sólo 1 de cada 3 personas ha probado alguna de estas herramientas basadas en IA, y la mayoría no conoce las empresas y startups que las fabrican. A pesar de los muchos insurgentes en el mundo de la IA, como Stability AI y Midjourney, sigue siendo el trabajo de las grandes tecnológicas el que dirige sustancialmente la conversación. OpenAI es la gran excepción, pero podría decirse que, gracias a su capitalización bursátil y a sus acuerdos con Microsoft, ya es miembro del corpo-club…

A pesar del uso limitado de estas herramientas hasta ahora, la gente tiene grandes expectativas sobre el impacto de la IA en el mundo, más allá de las de otras tecnologías emergentes (y a veces controvertidas). Casi tres cuartas partes de las personas afirman que la IA tendrá un impacto grande o moderado en la sociedad. Esto contrasta con el 69% para los vehículos eléctricos y el mísero 34% para las NFT. Son tan de 2021.

¿Cómo y para que se utiliza la IA?

Usos de la IA

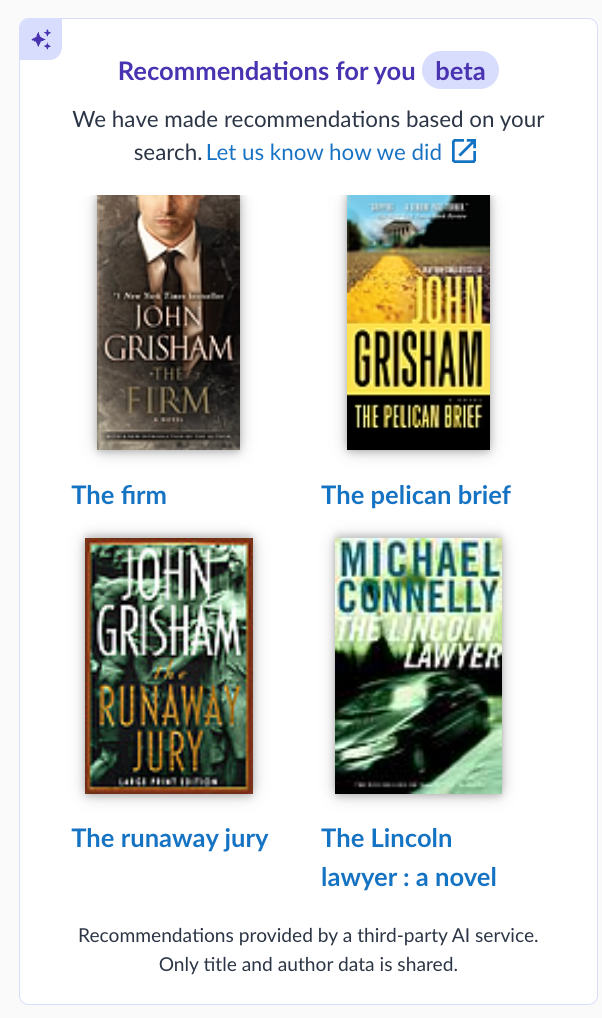

La búsqueda, la lluvia de ideas y el arte dominan el uso actual de la IA. La IA está ampliando lo que la gente puede crear. En cada una de las categorías encuestadas, los usuarios de IA afirman haber utilizado estos sistemas para crear algo que no podrían haber hecho de otro modo, siendo las obras de arte la categoría más popular dentro de estos campos creativos. Esto tiene sentido, ya que los generadores de imágenes de IA son mucho más avanzados que las herramientas que crean audio o vídeo.

La gente quiere mejores normas para la IA

No sólo los líderes tecnológicos quieren que se controlen las herramientas de IA. Más de tres cuartas partes de los encuestados están de acuerdo con la afirmación: «Es necesario elaborar normativas y leyes sobre el desarrollo de la IA». Estas leyes están actualmente en fase de elaboración, con la Ley de IA de la UE abriéndose camino a través de las negociaciones finales y los EE.UU. celebrando recientemente audiencias para desarrollar su propio marco legal.

Futuros de la IA: entusiasmados, preocupados y ambas cosas a la vez

Cuando se trata de predecir el efecto de la IA en la sociedad, la gente pronostica todo tipo de peligros, desde la pérdida de puestos de trabajo (63%) a las amenazas a la privacidad (68%) y el uso indebido por parte de gobiernos y empresas (67%). Estos peligros tienen más peso que las posibles aplicaciones positivas, como los nuevos tratamientos médicos (51%) y la potenciación económica (51%). Y cuando se les pregunta cómo se sienten acerca del impacto potencial en su vida personal y profesional y en la sociedad en general, la gente está dividida a partes iguales entre preocupada y entusiasmada. En la mayoría de los casos, ambas cosas.

Un número bastante sorprendente de personas también considera razonables las predicciones más aventureras sobre la IA. El 56% de los encuestados cree que «la gente desarrollará relaciones emocionales con la IA», y el 35% afirma que estaría dispuesto a hacerlo si se sintiera solo.

/cloudfront-us-east-2.images.arcpublishing.com/reuters/2XY6EA4SNRKFLO2UDQAAJIUWHY.jpg)