Press, Gil. «Librarians Against The Machines: Is ChatGPT The Incarnation Of EMERAC?» Forbes. Accedido 28 de marzo de 2024. https://www.forbes.com/sites/gilpress/2023/04/30/librarians-against-the-machines-is-chatgpt-the-incarnation-of-emerac/.

A través de los años, la automatización ha transformado las bibliotecas, pero también ha abierto nuevas posibilidades de organización y acceso a la información. El surgimiento de ChatGPT y otros Modelos de Lenguaje Grandes (LLM) plantea preguntas sobre el papel futuro de la inteligencia artificial en la búsqueda y comprensión del conocimiento humano, como se ve en un estudio reciente que compara las respuestas de ChatGPT con las de los médicos.

«No pueden construir una máquina para hacer nuestro trabajo; hay demasiadas referencias cruzadas en este lugar», dice la bibliotecaria jefe (Katharine Hepburn) a sus ansiosos colegas del departamento de investigación cuando se contrata a un «ingeniero de métodos» (Spencer Tracy) para «mejorar la relación hombre-hora» en una gran empresa. Al final de la película «Su otra esposa» (Desk Set) (lanzada el 1 de mayo de 1957), demuestra su valía al ganarse, no sólo el corazón del ingeniero, sino también un concurso contra EMERAC, un «cerebro electrónico» del tamaño de una habitación, de aspecto siniestro.

Unos años antes de que los primeros «cerebros electrónicos» empezaran a automatizar el trabajo, Fremont Rider, bibliotecario de la Universidad de Wesleyan, publicó The Scholar and the Future of the Research Library (1944). Calculaba que el tamaño de las bibliotecas universitarias estadounidenses se duplicaba cada dieciséis años. Dado este ritmo de crecimiento, Rider especulaba con que la Biblioteca de Yale en 2040 tendría «aproximadamente 200.000.000 de volúmenes, que ocuparían más de 6.000 millas de estanterías… [requiriendo] una plantilla de catalogación de más de seis mil personas».

Algo parecido a lo que se predijo en los años 30, cuando las centralitas telefónicas automáticas sustituyeron a las centralitas asistidas por operadoras, que en poco tiempo se necesitarían más operadoras que chicas jóvenes aptas para el trabajo.

Esa «predicción» sirvió para justificar la automatización, ya que AT&T tuvo que explicar a sus clientes por qué tenían que hacer el trabajo que antes realizaba otro ser humano. La predicción de Rider sobre las bibliotecas y los bibliotecarios era correcta en cuanto al aumento del volumen de conocimientos almacenados en papel, pero no preveía que los «cerebros electrónicos» automatizarían parte del trabajo del conocimiento y proporcionarían almacenamiento digital para el creciente volumen de información. Y lo que es más importante, proporcionarán mejores medios para encontrar la información pertinente.

El afán por proporcionar a los buscadores de conocimiento el saber que buscan es mucho más antiguo que Google. En 1728, Ephraim Chambers, un fabricante de globos terráqueos londinense, publicó la Cyclopaedia, or, An Universal Dictionary of Arts and Sciences. Fue probablemente el primer intento de relacionar por asociación todos los artículos de una enciclopedia o, más en general, todos los componentes del conocimiento humano. En el prefacio, Chambers explica su innovador sistema de referencias cruzadas:

«Los antiguos lexicógrafos no han intentado nada parecido a una estructura en sus obras; ni parecen haber sido conscientes de que un diccionario era en cierta medida capaz de las ventajas de un discurso continuado. En consecuencia, no vemos nada parecido a un Todo en lo que han hecho …. Nos esforzamos por conseguirlo, considerando las diversas Materias [es decir, temas] no sólo de forma absoluta e independiente, en cuanto a lo que son en sí mismas, sino también de forma relativa, o como se relacionan entre sí. Ambas son tratadas como tantos Todoes, y tantas Partes de un Todo mayor; su Conexión con el cual, es señalada por una Referencia… Se abre una Comunicación entre las varias partes de la Obra; y los varios Artículos son en cierta medida reemplazados en su Orden natural de Ciencia, del cual el Técnico o Alfabético los había removido.»

Y justo antes de la llegada de los «cerebros electrónicos», Vannevar Bush escribió en As We May Think (1945): «Nuestra ineptitud para llegar a los registros se debe en gran medida a la artificialidad de los sistemas de indexación… La selección [es decir, la recuperación de información] por asociación, más que por indexación, aún puede mecanizarse».

¿Nos proporcionarán los «cerebros electrónicos» la recuperación de información por asociación? ¿Ayudarán a los bibliotecarios o servirán para sustituirlos?

En la década de 1960, la «amenaza» que suponían los ordenadores y la automatización para las bibliotecas se convirtió en una de las principales preocupaciones de los bibliotecarios. Paul Wasserman abría The Librarian and the Machine (1965) con la siguiente declaración: «Como si no fuera ya un problema suficiente para los administradores de bibliotecas que se esfuerzan por responder a las innumerables presiones e infinitas complejidades…. Un terror más nuevo e incluso más premonitorio [cursiva mía] … empezaba a emerger con mayor claridad. Me refiero al ordenador y al aparato de apoyo que lo acompaña».

Pero, al igual que Desk Set, su conclusión al final de su estudio de un año de duración es reconfortante: «Las máquinas pueden hacer hoy gran parte del trabajo del hombre con mayor rapidez y eficacia; pero no pueden hacer tan bien su trabajo intelectual».

¿Por qué era -y sigue siendo- siquiera concebible que un ordenador pueda hacer el trabajo del hombre, o más estrechamente, sustituir a un bibliotecario? ¿Porque la mayoría de nosotros suscribe fervientemente la alucinación de la «inteligencia general artificial» (AGI)? ¿Por nuestra «fascinación morbosa por la última forma de tecnología», por utilizar otra declaración de Wasserman en 1965?

En la película «Su otra esposa», en particular la afirmación sobre las referencias cruzadas, ha servido de fuente de inspiración y de grito de guerra para los bibliotecarios en sus encuentros con la creciente automatización y digitalización. Lo conocí cuando me incorporé en 1988 al departamento de investigación corporativa, parte de una magnífica red mundial de bibliotecas, de uno de los principales proveedores de «cerebros electrónicos», Digital Equipment Corporation (DEC).

El grupo para el que trabajaba no sólo contaba con bibliotecarios y muchos conocimientos en papel, sino también con información digitalizada y un equipo de expertos en recuperación de información (lo que diez años después empezamos a llamar «búsqueda»). Gestionaban una base de datos de artículos nuevos digitalizados («sistema de información competitiva» o SIC) y desarrollaron un software de búsqueda en bases de datos -lo que hoy llamamos «IA»- que podía distinguir entre «DEC» como nombre de la empresa y «Dec» como abreviatura de diciembre.

Tim Berners-Lee, preocupado como Bush y Chambers antes que él por la forma en que se organizaba la información, dejó obsoletos este tipo de primeros sistemas de búsqueda. Le entusiasmaba la idea de escapar de la «camisa de fuerza de los sistemas de documentación jerárquicos», escribió Berners-Lee en Weaving the Web: «Al poder referenciar todo con la misma facilidad, la web también podía representar asociaciones entre cosas que podían parecer no relacionadas pero que, por alguna razón, en realidad compartían una relación».

Con este salto imaginativo, Berners-Lee superó un escollo importante para todos los sistemas de recuperación de información anteriores: El sistema de clasificación predefinido en su núcleo. Esta idea era tan contraintuitiva que incluso durante los primeros años de la Web se intentó hacer precisamente eso: Clasificar (y organizar en taxonomías predefinidas) toda la información de la Web.

Google triunfó sobre Yahoo! y otros obsesionados con la taxonomía porque entendió el verdadero espíritu de la web. Los fundadores de Google fueron los primeros en aprovechar la perspicacia de Berners-Lee y construir su negocio de recuperación de información siguiendo de cerca las referencias cruzadas (es decir, los enlaces entre páginas) a medida que ocurrían, y correlacionar la relevancia con la cantidad de referencias cruzadas (es decir, la popularidad de las páginas según la cantidad de otras páginas que enlazaban con ellas).

La automatización, que reemplaza a los bibliotecarios y sus catálogos en fichas, ha sido el corazón del éxito de Google y su obsesión con la «escala», a medida que cada vez más conocimiento previamente basado en papel se digitalizaba y cada vez más información nacía digital.

Pero esta automatización también ha llevado a la ampliación, a apoyar nuestro pensamiento creando una nueva forma de organizar la información del mundo, una que esté más en línea con nuestro proceso de pensamiento y más en línea con el volumen actual de información (valiosa e inútil) que es imposible de catalogar.

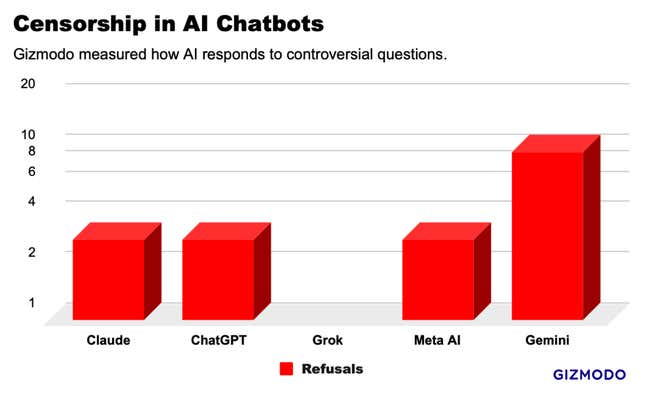

Chambers escribió sobre «los beneficios de un discurso continuado». Se refería a la «conversación» entre diferentes conceptos y temas, cómo se relacionan entre sí. ¿Presentan ChatGPT y otros Modelos de Lenguaje Grandes (LLM) una nueva realidad en la que las computadoras y sus sistemas de búsqueda de información conversan con sus usuarios y los incitan a formular consultas más precisas? ¿Y cuánto del «trabajo intelectual» del hombre (y con qué calidad) podrá hacer la inteligencia artificial (IA)?

Aquí hay un ejemplo reciente para considerar, sobre las conversaciones entre pacientes y sus médicos. Un nuevo estudio comparó la calidad y empatía de las respuestas a preguntas de pacientes para médicos vs ChatGPT. «Los resultados para la calidad y empatía de las respuestas de ChatGPT fueron bastante sorprendentes», escribe Eric Topol. En cuanto a la calidad, los evaluadores (ciegos a la fuente) prefirieron la respuesta de ChatGPT el 79% del tiempo. La proporción de respuestas empáticas o muy empáticas fue del 45.1% para el chatbot frente al 4.6% para los médicos.

Topol concluye que los resultados «reflejan nuevas posibilidades emocionantes tanto para médicos como para pacientes que no habíamos visto antes en la historia de la atención médica. Todo está bajo el título general de usar máquinas para hacer que los humanos sean más humanos».

Dudo que las máquinas puedan hacer que los humanos sean más humanos. Pero pueden mejorar todos los tipos de trabajo de conocimiento y pueden mejorar drásticamente nuestras conversaciones con los trabajadores del conocimiento.