Aeon. «The Birth of Our System for Describing Web Content | Aeon Essays». Accedido 27 de febrero de 2024. https://aeon.co/essays/the-birth-of-our-system-for-describing-web-content.

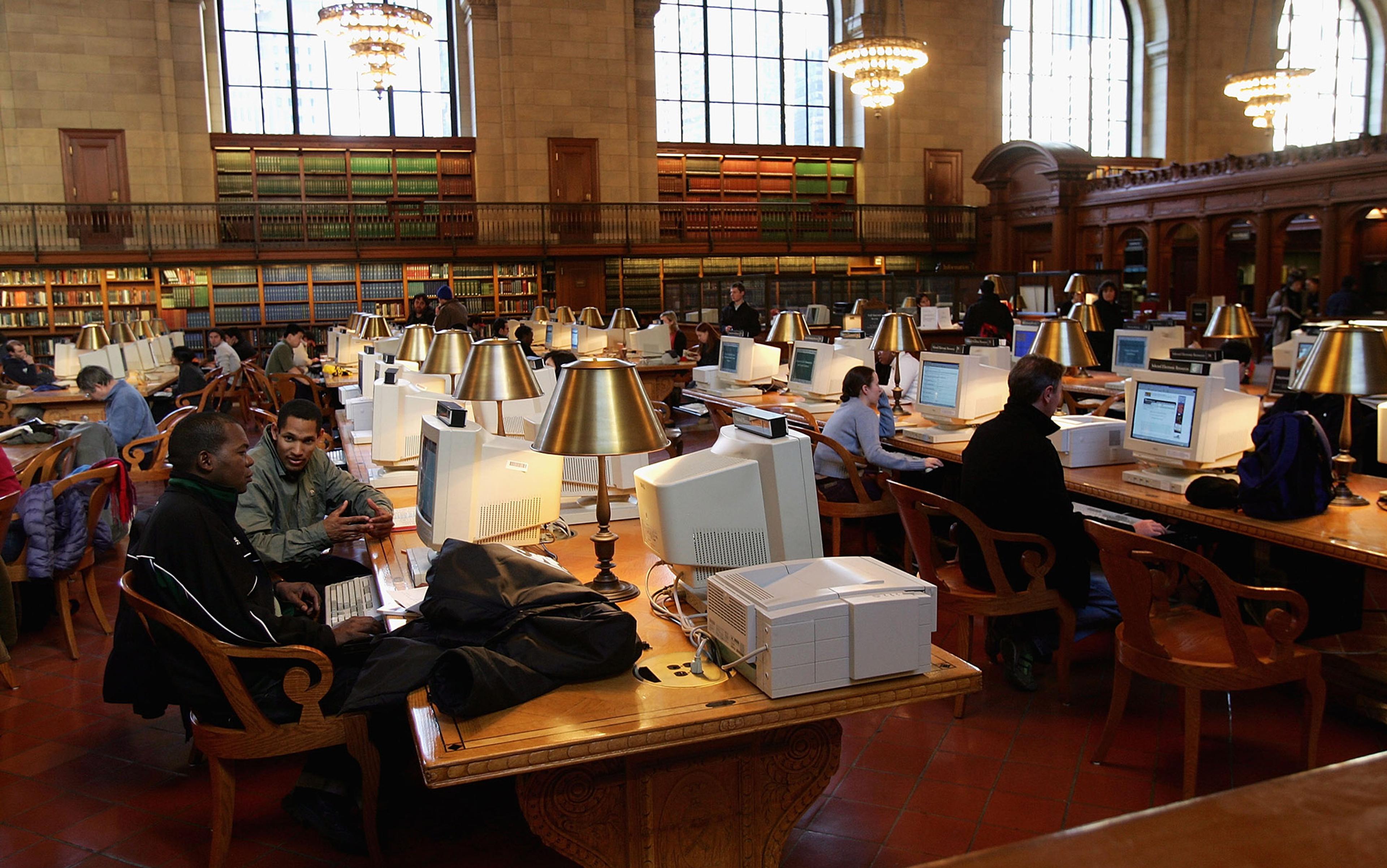

En 1995, tuvo lugar una iniciativa innovadora en Dublín, Ohio, donde un grupo diverso de individuos se unió para abordar el desafío de navegar por el paisaje en rápido crecimiento de internet. Esta reunión, organizada por el OCLC y el National Center for Supercomputing Applications (NCSA), tuvo como objetivo desarrollar un sistema de etiquetado estandarizado para el contenido en línea, allanando el camino para la forma en que se indexa y descubre la información en la web hoy en día.

El impulso de esta iniciativa surgió del crecimiento exponencial del contenido en línea, impulsado por la aparición de navegadores web fáciles de usar como Mosaic, que democratizaron el acceso a internet. Sin embargo, la falta de un sistema de etiquetado estandarizado hacía que gran parte de este contenido fuera inaccesible para los usuarios, ya que las herramientas de búsqueda existentes tenían limitaciones en su capacidad para indexar y recuperar documentos en línea de manera efectiva.

Para abordar este desafío, los participantes en el taller de 1995 trabajaron incansablemente para desarrollar lo que se conocería como el estándar de metadatos Dublin Core (DC). A través de un proceso de construcción de consenso y compromiso, formularon un conjunto conciso de elementos de metadatos que podrían aplicarse fácilmente a documentos en línea, lo que permitió una indexación y búsqueda más completas.

La importancia del estándar Dublin Core radica no solo en su utilidad práctica, sino también en el espíritu colaborativo que sustentó su desarrollo. Reuniendo a individuos de diversos ámbitos, incluidos bibliotecarios, tecnólogos e investigadores, la iniciativa ejemplificó el poder de la resolución colectiva de problemas y la colaboración interdisciplinaria.

Hoy en día, el estándar Dublin Core continúa desempeñando un papel fundamental en la recuperación de información en la web, sirviendo como base para las prácticas modernas de metadatos. Su influencia se extiende más allá del ámbito académico, dando forma a la forma en que se indexa y descubre contenido en diversas plataformas y servicios en línea.

Al reflexionar sobre el legado de la iniciativa Dublin Core, se nos recuerda la importancia de los estándares abiertos y los esfuerzos colaborativos en la configuración del futuro del acceso y la búsqueda de información. Si bien el panorama de la web puede haber evolucionado desde 1995, los principios defendidos por el estándar Dublin Core siguen siendo tan relevantes como siempre para garantizar un entorno digital más accesible e interconectado.