Valérie Kindarji, Wendy H. Wong «Opinion: Digital Literacy Will Be Key in a World Transformed by AI». The Globe and Mail.11 de marzo de 2023. https://www.theglobeandmail.com/opinion/article-digital-literacy-will-be-key-in-a-world-transformed-by-ai/.

El reciente lanzamiento de chatbots impulsados por IA, como ChatGPT, el nuevo Bing y Bard de Google, ha alimentado un torbellino de posibilidades y pánico. Estos grandes modelos de lenguaje (LLM) imitan y aumentan la interacción humana, ya sea respondiendo preguntas, completando formularios o resumiendo grandes cantidades de literatura. Microsoft y Google nos dicen que es la próxima frontera de la búsqueda, y muchos de nuestros colegas lo ven como una sentencia de muerte para el ensayo universitario.

La innovación disruptiva ya ha cambiado vidas humanas antes. La imprenta aumentó las tasas de alfabetización lingüística, trastocó estructuras políticas y sociales arraigadas y abrió un mundo de conocimiento a las masas. Hoy en día, la IA y la recopilación generalizada de datos están cambiando radicalmente nuestras vidas y creando la necesidad de un nuevo tipo de alfabetización: la alfabetización digital.

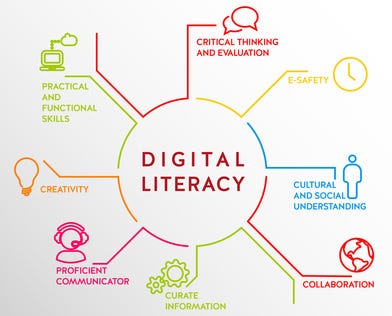

La alfabetización digital es un conjunto de habilidades y un marco conceptual que nos ayuda a funcionar de manera más significativa en nuestro mundo impulsado por la tecnología. La alfabetización digital nos brinda herramientas para buscar, evaluar y gestionar el volumen de información al que estamos expuestos. Nos ayuda a utilizar tecnologías algorítmicas y a comprender en general cómo producen respuestas. Nos ayuda a comprender la máquina y los datos detrás de la IA.

Es hora de que empecemos a tomar en serio la alfabetización digital y empecemos a pensar en cómo implementar estas habilidades en nuestras prácticas sociales y llevar estas ideas a la legislación. Hasta la fecha, la atención pública se ha centrado en las propias tecnologías de IA. Desafortunadamente, las tecnologías que se están desatando avanzan más rápido de lo que el gobierno puede responder con regulaciones punitivas. Muchas políticas gubernamentales, incluidas las regulaciones canadienses, se han centrado en controlar la tecnología, como imponer requisitos sobre el contenido o encontrar fallas en las prácticas corporativas. Los debates públicos recientes sobre el LLM señalan la precisión o los peligros.

Si bien es importante examinar los productos corporativos, también debemos invertir en ayudar a los ciudadanos a adaptarse a las nuevas realidades que trae la IA. Una forma de incorporar tecnologías disruptivas es brindar a los ciudadanos el conocimiento y las herramientas que necesitan para hacer frente a estas innovaciones en su vida diaria. Es por eso que deberíamos abogar por una inversión generalizada en programas de alfabetización digital. El hecho de que vivamos en un mundo tecnológicamente infundido no va a cambiar. La alfabetización digital puede ayudarnos a empezar a ver las tecnologías relacionadas con la IA tal como son: sistemas masivos de agrupación, clasificación y procesamiento de datos que son máquinas de predicción.

La alfabetización digital es particularmente importante en las democracias, sistemas políticos que dependen del conocimiento, la participación y las opciones de los ciudadanos para gobernar. Algunos países están por delante de la curva. Por ejemplo, la alfabetización digital forma parte del plan de estudios básico de las escuelas en Finlandia y Estonia. Los estudiantes aprenden a codificar desde una edad temprana y toman cursos sobre medios y desinformación. Sin embargo, la mayoría de los demás países, incluido Canadá, están rezagados. Los programas de alfabetización digital existentes son irregulares y es posible que la política educativa no corresponda a una sola jurisdicción. Además, actualmente la carga de impartir formación en alfabetización digital recae en las organizaciones que ofrecen educación complementaria, como bibliotecas públicas o programas comunitarios. La falta de financiación y de intercambio de conocimientos entre programas complica la impartición y el acceso a los cursos.

La importancia de la alfabetización digital va más allá del alcance de nuestras interacciones cotidianas con el entorno de información en línea. Los LLM representan un grave riesgo para la democracia porque interrumpen nuestra capacidad de acceder a información de alta calidad, un pilar fundamental de la participación democrática. Derechos básicos como la libertad de expresión y de reunión se ven obstaculizados cuando nuestra información está distorsionada. Necesitamos ser consumidores de información perspicaces para poder tomar decisiones lo mejor que podamos y participar políticamente.

La alfabetización digital es una inversión a largo plazo. Se trata de ayudar a los ciudadanos a navegar sus vidas. Las tecnologías impulsadas por la IA serán cada vez más precisas, menos detectables y más extendidas. Los observadores tienden a burlarse cuando la IA comete errores (y pueden ser divertidos), pero ésta no es la mejor manera de rechazar los algoritmos.

Necesitamos comprender cómo los LLM (y otras tecnologías de inteligencia artificial) generan sus respuestas para poder utilizar estas poderosas herramientas. Tendemos a ser víctimas del sesgo de la automatización, degradando la toma de decisiones humana en favor de la máquina. Pero tal vez eso se deba a que no solemos pensar en cómo funciona la máquina para producir respuestas. ¿Cómo recopila y me entrega información una herramienta como ChatGPT? ¿Cómo puedo utilizar el chatbot para despertar mi creatividad en lugar de hacer que hable por mí? ¿Cuáles son las limitaciones de esta herramienta? ¿Cómo influyen las elecciones algorítmicas en el resultado de estas herramientas?

Las percepciones distorsionadas de la realidad afectan nuestra confianza en nuestras instituciones y nuestra confianza mutua, especialmente en aquellos con quienes no estamos de acuerdo. Los algoritmos de las redes sociales ya nos están filtrando hacia campos opuestos que cada vez más no se hablan entre sí. Pero hay motivos para tener esperanzas. Recientemente, en el podcast Hard Fork, Sam Altman, director ejecutivo de OpenAI (que creó ChatGPT), dijo: «Y dado lo firmemente que creo que [la IA] va a cambiar muchos, tal vez la gran mayoría de los aspectos de la sociedad, la gente necesita ser incluido temprano”.

Señor. Altman tiene razón: necesitamos que nos incluyan. Sobre qué y de quién, con qué conocimientos previos y con qué desarrolladores de tecnología siguen siendo preguntas abiertas. La alfabetización digital es una parte importante de la respuesta y actualmente no tiene prioridad. Puede ser el arma sigilosa para combatir la desinformación y convertirnos en consumidores más activos y confiados de tecnologías de inteligencia artificial.