Dellinger, AJ. 2026. “Sam Altman Says Companies Are ‘AI Washing’ Layoffs.” Gizmodo, 21 de febrero de 2026. https://gizmodo.com/sam-altman-says-companies-are-ai-washing-layoffs-2000724759

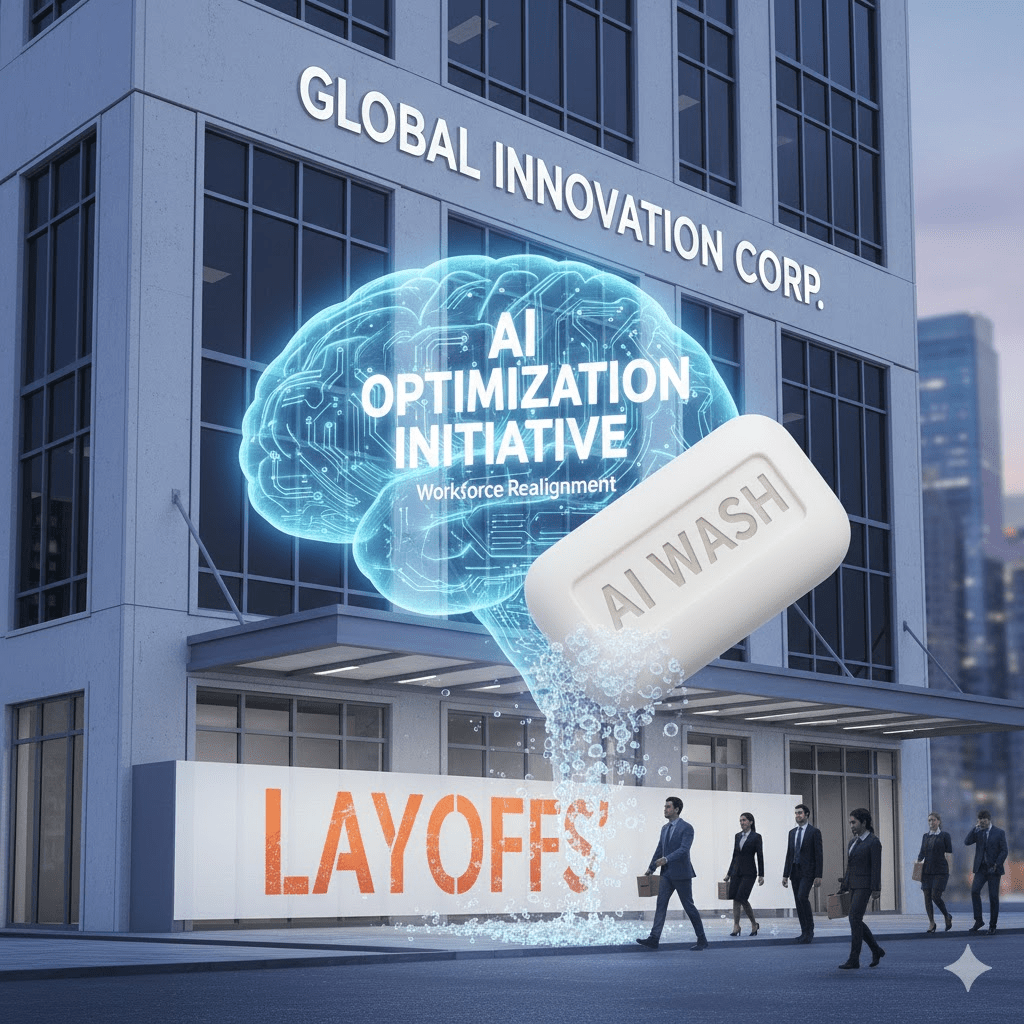

En un contexto de continuos recortes de plantilla en el sector tecnológico y en diversas industrias, el CEO de OpenAI, Sam Altman, ha ofrecido una perspectiva crítica sobre cómo las empresas están comunicando las causas de sus despidos.

Durante el India AI Impact Summit, Altman advirtió que muchos ejecutivos y corporaciones han empezado a practicar lo que él denomina “AI washing”, es decir, atribuir a la inteligencia artificial la responsabilidad de recortes laborales que probablemente obedecen a otras razones internas, como reducciones de costes, reestructuraciones estratégicas o ajustes post-pandemia que ya estaban en marcha antes de la adopción de herramientas tecnológicas. Altman reconoció que la IA sí está desplazando ciertos tipos de empleos y que, con el tiempo, ese impacto será más palpable, pero señaló que en muchos casos actuales esa atribución está siendo utilizada como una excusa conveniente ante empleados, mercados y público en general.

Los datos recientes respaldan la advertencia de Altman sobre la exageración en torno al papel actual de la IA en la pérdida de empleo. Por ejemplo, un informe de la consultora Challenger, Gray & Christmas indica que alrededor de 55 000 despidos en Estados Unidos en 2025 fueron atribuidos directamente a la IA, cifra que, aunque significativa, representa menos del 1 % del total de recortes de empleo, lo que sugiere que otras causas económicas o estructurales han sido más determinantes para las masas de despidos reportadas. Además, encuestas entre ejecutivos muestran que una mayoría amplia—hasta el **90 % según un estudio citado por medios—no ha observado un impacto sustantivo de la IA en la plantilla durante los últimos años, lo que contradice la narrativa de que la tecnología ha sido la principal fuerza destructora de empleo hasta la fecha.

La crítica de Altman también encierra un doble mensaje sobre la percepción pública y el rol de las corporaciones. Por un lado, evita posicionar la IA como un “asesino de trabajos”, ya que esa idea podría aumentar la resistencia social a la adopción de herramientas que él mismo y su empresa promueven; por otro, desafía a las organizaciones a ser más transparentes sobre sus motivos reales para reducir personal. Altman destacó, como otros líderes tecnológicos han señalado, que las revoluciones tecnológicas históricas suelen derivar también en la creación de nuevas categorías laborales y oportunidades, aunque el equilibrio temporal entre destrucción y creación de empleo puede ser doloroso para muchos trabajadores. Este planteamiento pone de manifiesto la complejidad del debate: aunque la IA tendrá sin duda un impacto profundo en el mundo laboral, el grado, la velocidad real de ese impacto y la honestidad con que se expliquen los factores detrás de los despidos constituyen temas que requieren mayor atención pública y empresarial.