GAIDeT, es una herramienta práctica para declarar de forma clara y estandarizada el uso de IA generativa en la investigación y la publicación académica. Su propuesta combina fases del proceso de investigación con roles de la IA, apoyada por una herramienta en línea que genera declaraciones automáticas. El objetivo es fomentar transparencia, responsabilidad y confianza en la comunicación científica.

La creciente presencia de herramientas de inteligencia artificial generativa (IA generativa) en la investigación académica y plantea una necesidad crítica: mejorar la transparencia en la forma en que los investigadores divulgan el uso de estas herramientas, ya que muchas declaraciones existentes son vagas o directamente inexistentes, lo que perjudica la reproducibilidad y comprensión del proceso científico.

Para resolver esto, los autores proponen el marco GAIDeT (Generative Artificial Intelligence Delegation Taxonomy), un sistema inspirado en taxonomías como CRediT o NIST, pero adaptado específicamente para describir cómo, dónde y en qué tareas se ha delegado trabajo a herramientas de IA en el flujo de investigación. Este sistema articula dos dimensiones clave: por un lado, la etapa del proceso de investigación (por ejemplo: generación de ideas, búsqueda bibliográfica, redacción, análisis de datos); por otro, el rol específico desempeñado por la IA (como síntesis de texto, traducción, análisis de sesgos), siempre dejando claro que el control y la responsabilidad final recaen en el investigador humano.

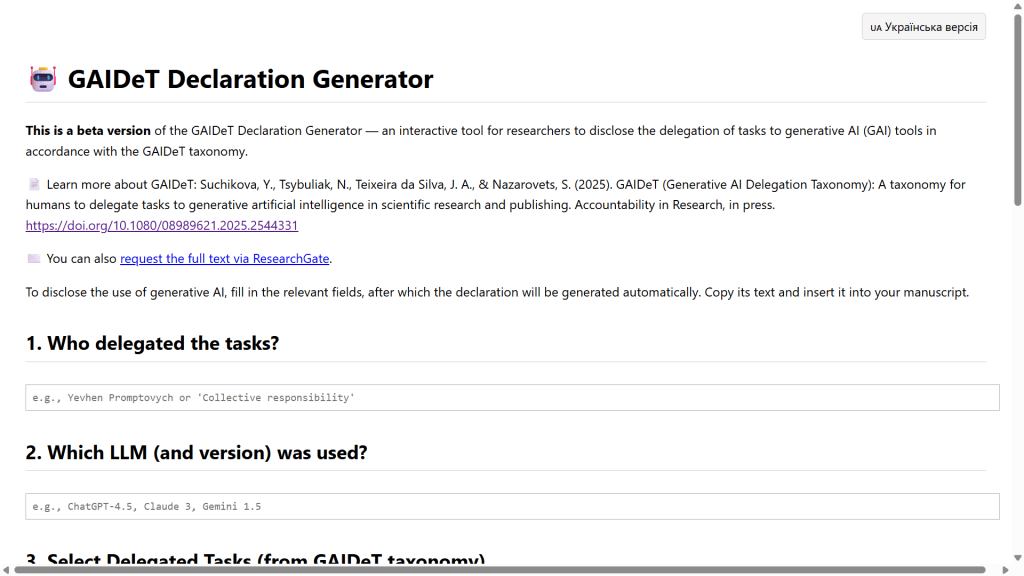

Para facilitar su implantación, se creó una herramienta en línea llamada GAIDeT Declaration Generator . Esta herramienta guía al usuario mediante preguntas simples sobre cómo utilizó la IA, qué herramienta utilizó y en qué fase del trabajo, generando automáticamente una declaración estandarizada que puede insertarse directamente en un manuscrito —realizando así la tarea sin cargas administrativas adicionales para los autores

La adopción de GAIDeT aporta beneficios tangibles para distintos actores académicos:

- Autores: les proporciona una forma estándar de demostrar uso responsable y transparente de la IA, reforzando la credibilidad de su trabajo.

- Editores: simplifica la evaluación de si la IA se usó como una herramienta legítima o si se delegó indebidamente trabajo académico.

- Revisores: les ofrece contexto adicional para valorar decisiones metodológicas y definir el alcance real de la participación de IA.

- Moderadores de repositorios: les ayuda a proteger la integridad de los archivos, aclarando el nivel de asistencia de IA en los documentos depositados.

- Lectores: facilita interpretar los resultados del estudio con precisión, comprendiendo en qué medida fueron asistidos por IA

Su objetivo es que las declaraciones de uso de IA sean una parte natural del proceso académico, tan comunes como los conflictos de interés o las fuentes de financiación, devolviendo claridad y confianza a la ciencia en tiempos de innovación acelerada