Van Noorden, Richard, y Timothy Perkel. «AI’s Growing Role in Science.» Nature, 2025. https://www.nature.com/articles/d41586-025-00437-0

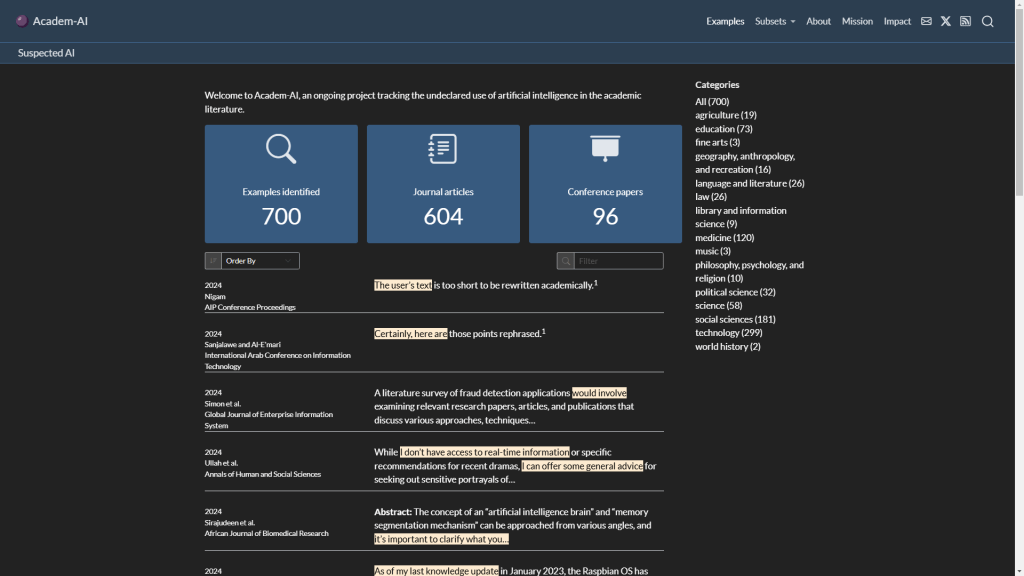

Las herramientas de inteligencia artificial (IA) están cambiando la investigación científica, con modelos como ChatGPT y DeepSeek facilitando tareas como la redacción y la resolución de problemas complejos. Llama es popular por su adaptabilidad en simulaciones científicas, mientras que Claude destaca en codificación. OLMo, por su parte, ofrece total transparencia en su funcionamiento.

Las herramientas de inteligencia artificial (IA) generativa están revolucionando el panorama de la investigación, ofreciendo una amplia variedad de modelos de lenguaje (LLM) para diferentes tareas. Desde la escritura de códigos hasta la generación de hipótesis o la edición de manuscritos, los investigadores ahora tienen acceso a más herramientas que nunca.

OpenAI y sus modelos de razonamiento

OpenAI, con sede en San Francisco, lanzó su chatbot ChatGPT en 2022, y desde entonces ha desarrollado modelos avanzados como o1 y o3, diseñados para realizar razonamientos paso a paso. Estos modelos sobresalen en tareas como la resolución de problemas matemáticos y la depuración de código. Recientemente, OpenAI introdujo el o3-mini, una versión más rápida y accesible de su modelo de razonamiento, y ‘deep research’, una herramienta que permite generar informes sintéticos de información con citas de múltiples sitios web. Aunque potentes, estos modelos siguen siendo propensos a errores y no pueden reemplazar completamente a un investigador humano.

DeepSeek: el modelo versátil

La empresa china DeepSeek lanzó su modelo DeepSeek-R1, que se destaca por su bajo costo y la capacidad de personalizarse para proyectos de investigación específicos. A diferencia de los modelos de OpenAI, DeepSeek-R1 es de «peso abierto», lo que permite a los investigadores adaptarlo a sus necesidades. Es especialmente útil para tareas como problemas matemáticos y generación de hipótesis. Sin embargo, presenta desventajas como un proceso de pensamiento lento y preocupaciones sobre la seguridad de los datos introducidos.

Llama: el caballo de batalla

Llama, desarrollado por Meta AI, es otro modelo popular entre los investigadores, especialmente por su disponibilidad de código abierto, lo que permite a los usuarios adaptarlo para tareas específicas. Ha sido utilizado en simulaciones de computadoras cuánticas y para predecir estructuras cristalinas de materiales. A pesar de que requiere permisos para su uso, es ampliamente adoptado por la comunidad científica, que valora su accesibilidad y adaptabilidad.

Claude: el experto en codificación

El modelo Claude 3.5 Sonnet de la firma Anthropic, basado en Silicon Valley, es altamente apreciado por su habilidad para escribir código y manejar información visual, como gráficos y tablas. Además, su capacidad para mantener el estilo técnico en la escritura lo hace útil para tareas como la redacción de propuestas de subvenciones y la anotación de códigos. Aunque su uso completo requiere acceso a una API de pago, se valora por su rendimiento en desafíos de codificación.

OLMo: la transparencia total

OLMo 2 es un modelo de código abierto que ofrece una transparencia total, permitiendo a los investigadores examinar tanto los datos de entrenamiento como los algoritmos utilizados para desarrollar el modelo. Este nivel de transparencia es valioso para entender sesgos en los resultados y mejorar la eficiencia del modelo. Sin embargo, su uso requiere conocimientos técnicos, aunque los cursos gratuitos están reduciendo las barreras de entrada.

En general, la IA generativa está transformando la investigación científica, pero la elección del modelo adecuado depende de las necesidades del investigador y los recursos disponibles. Aunque estas herramientas prometen avances significativos, su implementación aún enfrenta desafíos como la supervisión humana y la protección de datos sensibles.