Wong, Carissa. «AI-Generated Images and Video Are Here: How Could They Shape Research?» Nature, 7 de marzo de 2024. https://doi.org/10.1038/d41586-024-00659-8.

Así como muchos investigadores están utilizando ChatGPT para transformar el proceso de escritura científica, otros están utilizando generadores de imágenes de IA como Midjourney, Stable Diffusion y DALL-E para reducir el tiempo y el esfuerzo necesarios para producir diagramas e ilustraciones. Sin embargo, los investigadores advierten que estas herramientas de IA podrían impulsar un aumento en los datos falsos y las imágenes científicas inexactas. Nature examina cómo los investigadores están utilizando estas herramientas y lo que su creciente popularidad podría significar para la ciencia.

¿Cómo funcionan las herramientas de texto a imagen? Muchas herramientas de IA de texto a imagen, como Midjourney y DALL-E, se basan en algoritmos de aprendizaje automático llamados modelos de difusión que están entrenados para reconocer los vínculos entre millones de imágenes extraídas de Internet y descripciones de texto de esas imágenes. Estos modelos han avanzado en los últimos años gracias a mejoras en hardware y la disponibilidad de grandes conjuntos de datos para el entrenamiento. Después del entrenamiento, los modelos de difusión pueden utilizar indicaciones de texto para generar nuevas imágenes.

¿Para qué los están utilizando los investigadores? Algunos investigadores ya están utilizando imágenes generadas por IA para ilustrar métodos en artículos científicos. Otros los están utilizando para promocionar artículos en publicaciones en redes sociales o para mejorar las diapositivas de presentaciones. «Están utilizando herramientas como DALL-E 3 para generar imágenes llamativas que enmarcan conceptos de investigación», dice el investigador de IA Juan Rodríguez de ServiceNow Research en Montreal, Canadá. «Di una charla el jueves pasado sobre mi trabajo y utilicé DALL-E 3 para generar imágenes atractivas para mantener la atención de las personas», dice.

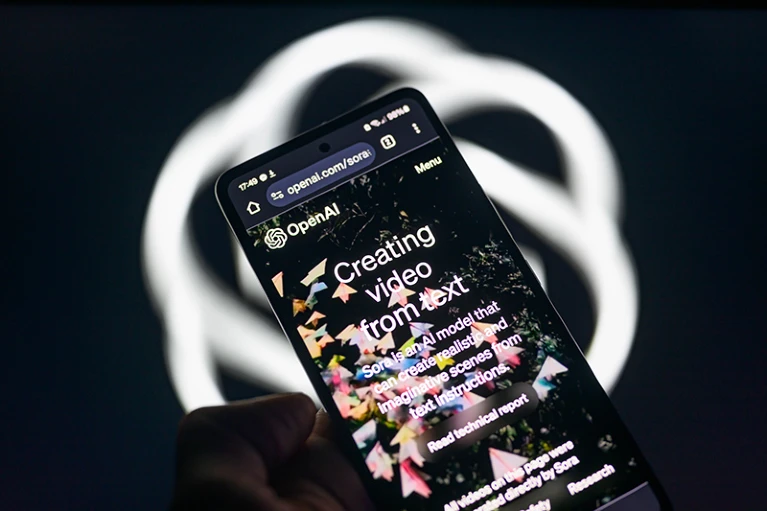

También están aumentando las herramientas de texto a video, pero parecen ser menos utilizadas por investigadores que no están desarrollando o estudiando activamente estas herramientas, dice Rodríguez. Sin embargo, esto podría cambiar pronto. El mes pasado, OpenAI, creador de ChatGPT en San Francisco, California, lanzó videoclips generados por una herramienta de texto a video llamada Sora. «Con los experimentos que vimos con Sora, parece que su método es mucho más robusto para obtener resultados rápidamente», dice Rodríguez. «Estamos en una etapa temprana en términos de texto a video, pero supongo que este año descubriremos cómo se desarrolla esto», agrega.

¿Cuáles son los beneficios de utilizar estas herramientas? Las herramientas de IA generativas pueden reducir el tiempo necesario para producir imágenes o figuras para artículos, carteles de conferencias o presentaciones. Convencionalmente, los investigadores utilizan una variedad de herramientas no de IA, como PowerPoint, BioRender e Inkscape. «Si realmente sabes cómo usar estas herramientas, puedes hacer figuras realmente impresionantes, pero lleva tiempo», dice Rodríguez.

Las herramientas de IA también pueden mejorar la calidad de las imágenes para los investigadores que encuentran difícil traducir conceptos científicos en ayudas visuales, dice Rodríguez. Con la IA generativa, los investigadores aún crean la idea principal de la imagen, pero pueden usar la IA para refinarla, dice.

¿Cuáles son los riesgos? Actualmente, las herramientas de IA pueden producir obras de arte convincentes y algunas ilustraciones, pero aún no pueden generar figuras científicas complejas con anotaciones de texto. «No obtienen el texto correcto: a veces el texto es demasiado pequeño, mucho más grande o está girado», dice Rodríguez. El tipo de problemas que pueden surgir quedó claro en un artículo publicado en Frontiers in Cell and Developmental Biology a mediados de febrero, en el que los investigadores utilizaron Midjourney para representar los órganos reproductores de una rata. El resultado, que pasó la revisión por pares, fue una caricatura de un roedor con genitales enormes y anotados con garabatos.

Existe también la posibilidad de que estas herramientas faciliten la producción de datos u observaciones falsas por parte de estafadores científicos, ya que no hay un método robusto para detectar tales imágenes y videos generados por IA. Rodriguez expresa preocupación por el potencial impacto de «una inundación de datos falsos y sintéticamente generados».

Algunos campos han mostrado una fuerte resistencia a la inclusión de imágenes generadas por IA en publicaciones científicas. Una encuesta realizada por el paleoartista Henry Sharpe reveló que solo uno de cada cuatro paleontólogos profesionales estaba a favor de permitir la inclusión de imágenes generadas por IA en publicaciones científicas. Se argumenta que estas imágenes pueden inducir a error tanto a científicos como al público, ya que simplemente copian elementos existentes sin la capacidad de interpretar textos científicos. Además, los procesos iterativos de reconstrucción de formas de vida antiguas, realizados en consulta con paleontólogos, revelan características anatómicas plausibles que se pierden al usar IA.

En cuanto a las políticas de las revistas científicas, Springer Nature ha prohibido el uso de imágenes, videos e ilustraciones generados por IA en la mayoría de los artículos que no tratan específicamente sobre IA. Journals de la familia Science no permiten el uso de texto, figuras o imágenes generadas por IA sin el permiso explícito de los editores, a menos que el artículo se centre en IA o aprendizaje automático. Por otro lado, PLOS ONE permite el uso de herramientas de IA, pero los investigadores deben declarar la herramienta utilizada, cómo la utilizaron y cómo verificaron la calidad del contenido generado.