Developing a library strategic response to Artificial Intelligence. The Hague: IFLA, 2023

Texto completo

El propósito de este documento de trabajo es presentar consideraciones relevantes para las bibliotecas que están desarrollando una respuesta estratégica a la Inteligencia Artificial.

Este documento de trabajo para la discusión fue preparado por Andrew Cox, como coordinador del Grupo de Interés en Inteligencia Artificial. Se invitan comentarios para futuras iteraciones del documento (enlace al formulario de comentarios; si tiene dificultades para acceder a este formulario, envíe comentarios a a.m.cox@sheffield.ac.uk).

El texto está organizado en torno al desarrollo de un conjunto de preguntas que estimulan la reflexión y la acción (sección 4). Se espera que el documento pueda respaldar la toma de decisiones locales sobre la Inteligencia Artificial.

Las ideas iniciales para el informe se derivaron de un evento llevado a cabo en la Universidad de Sheffield en abril de 2023. Una versión inicial de este documento como borrador para comentarios se publicó el 4 de junio de 2023. Queremos agradecer a todos los que añadieron pensamientos y comentarios a este borrador. También hemos incorporado datos de una encuesta (N=111) vinculada al evento de Sheffield y recirculada en julio; los encuestados eran una mezcla de bibliotecarios de educación superior y educación superior técnica, así como bibliotecarios de salud. Dado que la audiencia era principalmente del Reino Unido, estos datos deben entenderse simplemente como una instantánea de opiniones en un contexto específico.

El documento de trabajo está organizado en las siguientes secciones:

Sección 1: Definición de la Inteligencia Artificial Sección 2: Impacto de la Inteligencia Artificial en las bibliotecas Sección 3: Contexto estratégico y un análisis FODA de la biblioteca Sección 4: Respuestas estratégicas a la Inteligencia Artificial: Pros y contras Sección 5: Tres estrategias importantes

1: Definición de la Inteligencia Artificial

Se destacan diversas perspectivas, como la de la UNESCO, que enfatiza la imitación de la comprensión humana, la del UKRI, que ve la IA como un conjunto de tecnologías para reproducir habilidades inteligentes, y la de la Comisión Europea, que destaca la combinación de datos, algoritmos y potencia informática.

Se señala que la IA no es nueva y ya está presente en aplicaciones como la sugerencia automática, detección de plagio y traducción. En el contexto bibliotecario, la Minería de Texto y Datos y el aprendizaje automático se consideran formas de IA. A pesar de sus beneficios, la IA plantea desafíos éticos, como sesgo, privacidad y transparencia.

Se destaca la importancia de la «IA descriptiva» para las bibliotecas, que convierte diversos materiales en datos legibles mediante técnicas como la visión por computadora. Aunque la IA promete mejorar el acceso al conocimiento, existen preocupaciones éticas significativas, especialmente en aplicaciones desarrolladas por grandes empresas tecnológicas.

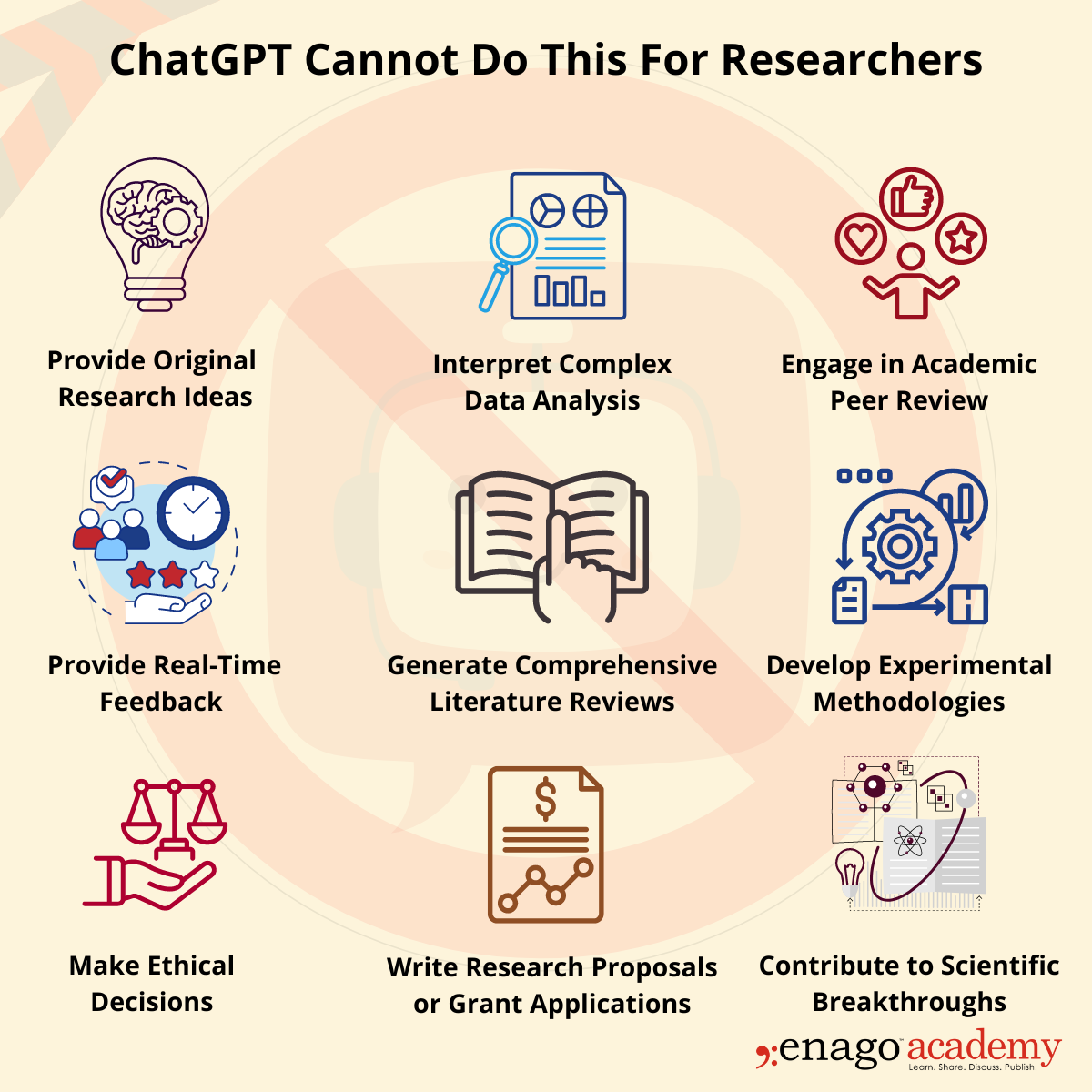

El documento menciona la relevancia de la IA generativa, como ChatGPT, que ha generado interés, pero también plantea preocupaciones éticas, como afirmaciones sesgadas, inexactitudes y amenazas a empleos humanos. Se concluye destacando la necesidad de aumentar la formación en alfabetización de IA en lugar de aplicar directamente la IA al trabajo bibliotecario.

2: Impacto de la Inteligencia Artificial en las bibliotecas

Se espera que las bibliotecas adopten la IA de maneras que se alineen con roles existentes, estén vinculadas a las necesidades de los usuarios o requieran menos recursos. Se destaca la relevancia de la IA descriptiva para hacer que las colecciones de bibliotecas sean más accesibles, proporcionando metadatos iniciales y apareciendo en servicios de búsqueda. A medida que más académicos utilizan técnicas de IA, crece la necesidad de apoyar a las comunidades de científicos de datos en temas como descubrimiento de datos, problemas de derechos de autor y gestión de datos.

Se anticipa que la IA cambiará el trabajo diario, incluyendo traducción, resumen y generación de texto. Las bibliotecas pueden utilizar herramientas de IA como ResearchRabbit y Scite para apoyar revisiones de literatura y aplicaciones generativas en marketing bibliotecario.

La capacidad de la IA para realizar tareas rutinarias precisas sugiere su implementación en sistemas bibliotecarios internos, como el uso de RPA (Automatización de Procesos Robóticos) para procesar datos bibliográficos. Se mencionan también chatbots, robots físicos para responder consultas y automatización de sistemas de almacenamiento y recuperación.

La IA contribuirá a crear espacios bibliotecarios más inteligentes, incluyendo el desarrollo de robots para consultas y funciones físicas como ordenar estanterías. Además, se señala la relevancia de la IA en la educación, como la creación de contenido de aprendizaje adaptativo y chatbots de apoyo a la experiencia estudiantil.

La IA generativa, con su uso extendido por parte de los usuarios, destaca la necesidad de alfabetización en IA para el personal y los estudiantes. La alfabetización en IA, que incluye alfabetización de datos y algorítmica, se presenta como una función natural para las bibliotecas que buscan ampliar su promoción de la alfabetización informacional y habilidades digitales.

El documento concluye con preguntas clave sobre cómo la IA puede mejorar los servicios de las bibliotecas, los desafíos y riesgos asociados, y cómo integrar efectivamente la alfabetización en IA en la formación existente.

- ¿Cuáles aplicaciones demandan menos recursos y se alinean más fuertemente con las necesidades de los usuarios y los roles existentes de la biblioteca?

- ¿Cuáles son los desarrollos más críticos en la reconfiguración del papel de la biblioteca?

- ¿Cuáles son los más probables de suceder y en qué escala de tiempo?

- ¿Cómo pueden las tecnologías de IA mejorar nuestros servicios bibliotecarios? ¿Qué desafíos puede ayudar a abordar la IA? ¿Cuáles son los riesgos potenciales y consideraciones éticas, y cómo podemos mitigarlos?

- ¿Cómo podemos monitorear de manera continua y mantenernos actualizados con las tendencias y avances emergentes en IA?

- ¿Cómo pueden las bibliotecas enseñar de manera efectiva la alfabetización en IA a los usuarios?

- ¿Cuáles son los resultados de aprendizaje clave necesarios y cómo varían según la disciplina?

- ¿Cómo se debe integrar la alfabetización en IA en la formación existente de alfabetización informacional, académica y digital?

- ¿Cómo se puede actualizar el material para mantenerse al día con la naturaleza cambiante de la IA?

3: Contexto estratégico y un análisis FODA de la biblioteca

En un contexto de cambio e incertidumbre, se reconoce la creciente importancia de pensar y actuar estratégicamente. Muchas instituciones están dando mayor énfasis a la estrategia, visualizando un estado futuro deseado y planificando para realizar esta visión. Para las bibliotecas, una cuestión clave es posicionarse sólidamente en relación con las prioridades institucionales, sectoriales y nacionales más amplias. Esto puede manifestarse como una alineación pasiva, buscando demostrar la contribución de la biblioteca a la misión organizativa, o incluso de manera proactiva, buscando asumir un papel de liderazgo en ciertas áreas.

Las respuestas de las bibliotecas a la IA ocurren en el contexto de políticas gubernamentales y marcos legales existentes y emergentes. Desde alrededor de 2019, muchos estados han reconocido la IA como una prioridad estratégica, con temas comunes como el desarrollo de capital humano, la aplicación ética de la IA, el desarrollo de una base de investigación, la regulación y el desarrollo de infraestructura y políticas de datos.

Los profesionales de la información pueden desempeñar un papel clave en la consecución de estas prioridades, educando a ciudadanos para desarrollar habilidades en una fuerza laboral con alfabetización en IA, abogando por su perspectiva única sobre la ética de la IA, apoyando a los investigadores y contribuyendo al diseño y uso de la infraestructura de datos.

Las estrategias nacionales de IA se dividen en tres grupos: desarrollo, control y promoción, con énfasis variables en diferentes políticas nacionales. La categorización refleja patrones persistentes en la cultura política de estos países. La controversia en torno a ChatGPT ha llevado a un posible cambio hacia la regulación a nivel internacional, lo que podría tener implicaciones radicales para el desarrollo y uso de la IA en el sector bibliotecario.

Las bibliotecas también deben responder a estrategias sectoriales y marcos legales existentes, y la estrategia de las organizaciones dentro de las cuales están insertas es de vital importancia. Hasta la fecha, la IA rara vez se menciona específicamente en las estrategias universitarias y de bibliotecas académicas.

Preguntas clave:

- ¿Cómo es probable que la postura del estado hacia la IA afecte el uso en bibliotecas?

- ¿Cuál es la postura estratégica de su institución y sector hacia la IA?

- ¿Existen aspectos en las estrategias existentes donde la IA podría ser relevante?

La sección destaca la importancia de encontrar temas en las estrategias institucionales y de bibliotecas que puedan ser aprovechados para alinear las actividades relacionadas con la IA. Se proporciona un ejemplo en las estrategias existentes, y se presentan preguntas sobre cómo las prioridades estratégicas actuales pueden aprovechar la IA y si esta última afecta las prioridades de transformación digital de la institución.

4: Respuestas estratégicas a la Inteligencia Artificial: Pros y contras

Las respuestas estratégicas a la IA podrían incluir una o una combinación de los siguientes enfoques generales:

- Contratar nuevo personal con habilidades especializadas en IA.

- Mejorar las habilidades del personal existente.

- Interactuar con los usuarios para comprender cómo están utilizando la IA.

- Estudiar las mejores prácticas en el sector.

- Ejecutar proyectos de prueba de concepto.

- Conversar con los proveedores de sistemas y adquirir sistemas.

- Alinear las acciones con lo que está sucediendo en la institución.

- Colaborar con otras unidades.

- Alinear las acciones con lo que está sucediendo en el sector.

- Colaborar con otras bibliotecas y organizaciones.

- Adoptar una postura de esperar y ver.

Sección 5: Tres estrategias importantes

Dada la amplitud del impacto de la IA, podría haber muchas estrategias para las bibliotecas. Sin embargo, hemos seleccionado tres que parecen ser importantes hoy.

- Estrategia 1: Utilizar las capacidades de IA de la biblioteca para modelar aplicaciones responsables y explicables de la IA descriptiva

- Estrategia 2: Utilizar las competencias de datos de los bibliotecarios para mejorar la capacidad de IA organizacional

- Estrategia 3: Promover la alfabetización en IA para mejorar las capacidades de IA organizacionales y sociales