Reeves, Neal, Wenjie Yin, y Elena Simperl. “Exploring the Impact of ChatGPT on Wikipedia Engagement.” Collective Intelligence, 2025. https://doi.org/10.1177/26339137251372599

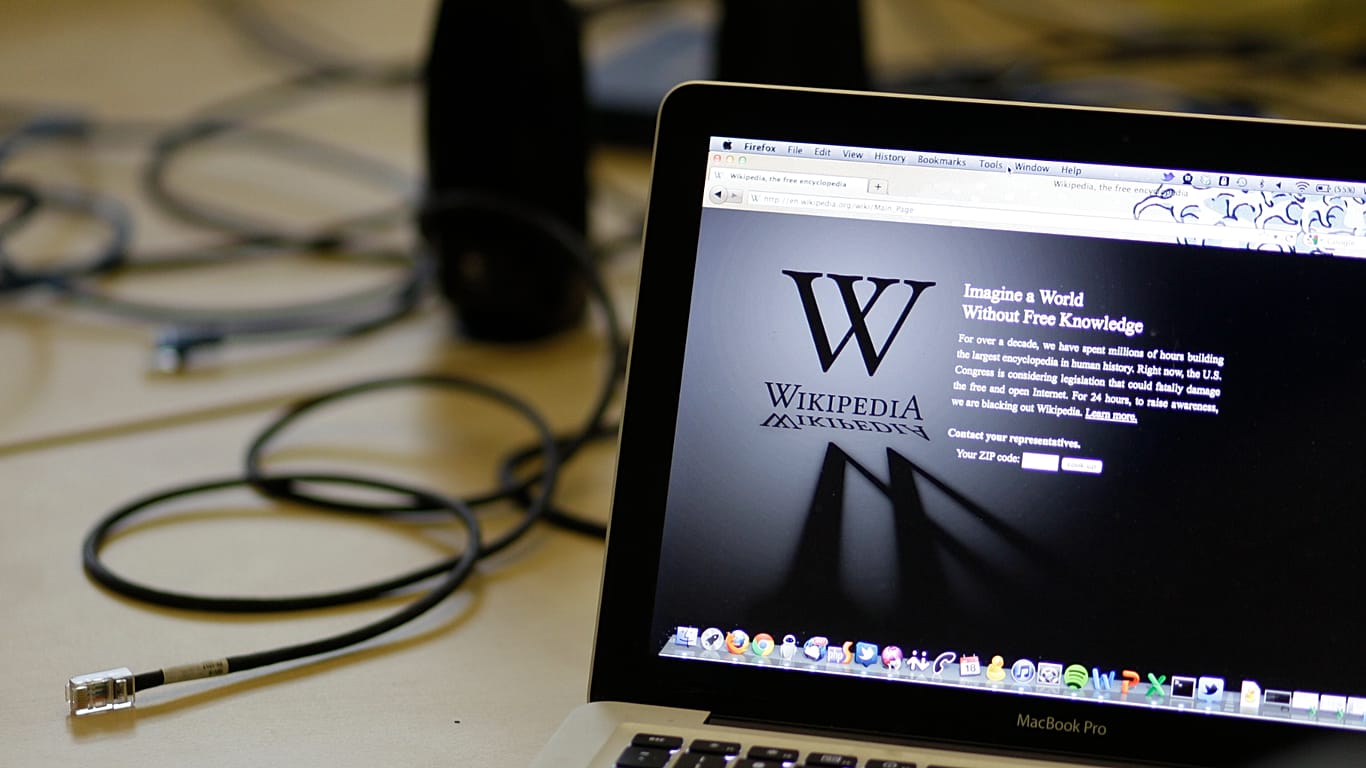

Se analiza cómo la aparición de ChatGPT ha influido en los patrones de uso y contribución en Wikipedia. Los autores investigan si el lanzamiento de esta herramienta ha alterado el comportamiento de los usuarios en cuanto a consultar, minar información o editar artículos de la enciclopedia libre.

Se examina de manera exhaustiva cómo la irrupción de la inteligencia artificial generativa —especialmente ChatGPT— ha influido en los patrones de interacción de los usuarios con Wikipedia. Su objetivo principal es determinar si el uso masivo de modelos conversacionales está desplazando el papel tradicional de la enciclopedia libre como fuente de conocimiento o, por el contrario, si ambos sistemas pueden coexistir de manera complementaria.

Los investigadores realizaron un análisis longitudinal entre 2021 y 2024, abarcando doce ediciones lingüísticas de Wikipedia. Eligieron la mitad de ellas en países donde ChatGPT está ampliamente disponible y la otra mitad en regiones donde el acceso es limitado o nulo. Este enfoque permitió comparar cómo varían el tráfico, las consultas y la actividad editorial dependiendo de la presencia o ausencia de la inteligencia artificial conversacional. Contra lo que muchos expertos predecían, los resultados no muestran un descenso generalizado en el uso de Wikipedia: en la mayoría de las ediciones analizadas, el número de visitas e incluso las contribuciones editoriales se mantuvieron estables o crecieron moderadamente.

El estudio sugiere que, lejos de sustituir a Wikipedia, ChatGPT ha reconfigurado la forma en que los usuarios se relacionan con el conocimiento digital. Muchos de ellos utilizan la inteligencia artificial para obtener respuestas rápidas o resúmenes, pero recurren a Wikipedia para verificar información, explorar en mayor profundidad los temas o consultar las fuentes originales. De este modo, se produce una relación de complementariedad más que de competencia directa. La IA actúa como una interfaz de acceso rápido al conocimiento, mientras que Wikipedia conserva su papel como repositorio abierto, verificable y colaborativo.

No obstante, los autores advierten que esta coexistencia plantea desafíos serios. Uno de los principales es el fenómeno de la toma masiva de datos (data scraping), mediante el cual las empresas que entrenan modelos de IA extraen grandes cantidades de texto de Wikipedia sin atribución explícita. Este proceso no solo genera tensiones éticas sobre la propiedad intelectual y la autoría colectiva, sino que también puede perjudicar la sostenibilidad técnica del proyecto, al incrementar la carga sobre los servidores y reducir el tráfico directo hacia la enciclopedia. Si los usuarios reciben respuestas inmediatas sin necesidad de visitar la fuente original, la comunidad editorial de Wikipedia puede perder visibilidad, participación y, en última instancia, relevancia.

El estudio también aborda el riesgo de que la inteligencia artificial difunda información derivada de Wikipedia sin el mismo rigor editorial ni el sistema de verificación comunitaria que caracteriza al proyecto. Los modelos de lenguaje no siempre reproducen el contexto o las referencias adecuadas, lo que puede conducir a distorsiones o errores. Ante esta situación, los autores abogan por establecer un nuevo marco de cooperación entre las plataformas de IA y la Fundación Wikimedia, basado en principios de transparencia, atribución y uso responsable de los datos.

Como propuesta práctica, el equipo investigador menciona la posibilidad de que los modelos de inteligencia artificial utilicen bases de datos estructuradas como Wikidata, en lugar de copiar texto plano de los artículos. Este tipo de integración permitiría a los sistemas de IA acceder a información verificable y actualizada, respetando al mismo tiempo la integridad del contenido original y reduciendo la dependencia de métodos de extracción masiva. Además, abriría la puerta a una sinergia más constructiva, en la que la inteligencia artificial contribuya a mejorar la accesibilidad y la difusión del conocimiento sin socavar las bases colaborativas sobre las que se asienta Wikipedia.