Shelley, Hannah. 2025. “Google Scholar Is Doomed.” Hannah’s Web log (blog), 13 de agosto, 2025. https://hannahshelley.neocities.org/blog/2025_08_13_GoogleScholar

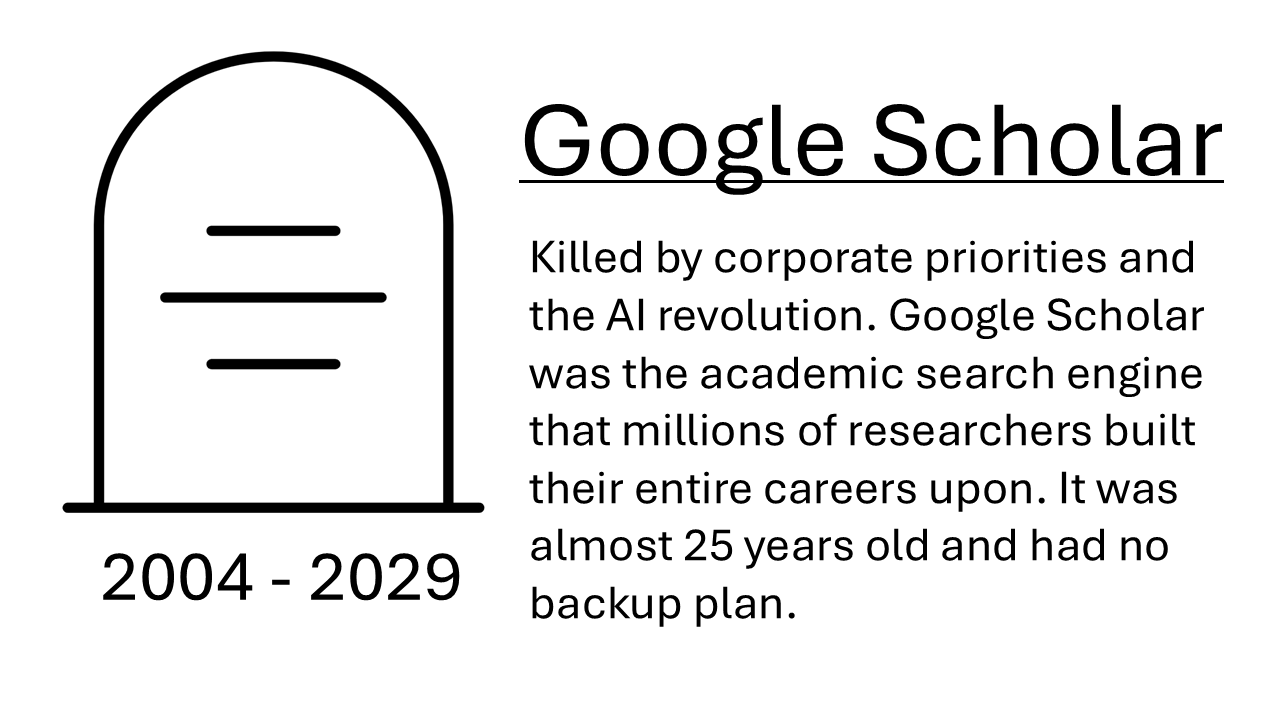

Google Scholar, una herramienta clave en el ámbito académico, podría estar en riesgo de desaparecer, al igual que otros productos de Google que desaparido, como Google Reader o Google+

¿Alguna vez has recorrido el cementerio de Google? Es un lugar sobrecogedor. Fila tras fila de lápidas digitales marcan productos de los que millones de personas dependieron a diario. Google Reader (2005–2013), adorado por internautas de todo el mundo como el mejor servicio de suscripción de feeds RSS/Atom. Google Notebook (2006–2011), la primera herramienta de organización para la investigación. Al momento de esta publicación, 297 productos descansan en este cementerio, cada uno representando un flujo de trabajo esencial que, simplemente… dejó de funcionar de un día para otro.

Google ha demostrado que no tiene reparos en eliminar productos con una base de usuarios fiel, si estos no encajan con su dirección estratégica. Google Reader tenía millones de usuarios activos cuando lo cerraron. Hubo incluso una petición en change.org con 100.000 firmas protestando contra su cancelación.

Google Play Music (2011–2020) fue un reproductor y almacén musical que yo misma usé hasta su último día. Poco después le siguió la aplicación Google Podcasts (2018–2024). Los usuarios de ambas fueron forzados a migrar a YouTube Music, una aplicación con una experiencia totalmente distinta. (Aunque encontré alternativas de código abierto, así que no te preocupes por mí).

Google también probó suerte con redes sociales y apps de mensajería como Google Talk (2005–2013), Google+ (2011–2019) y Google Hangouts (2013–2022). No lograron imponerse frente al gigante Facebook, pero sin duda interrumpieron valiosas conexiones sociales entre usuarios que las utilizaban.

La academia depende de Google Scholar para gran parte de sus actividades. Más allá de la búsqueda de documentos, son los perfiles de autor y las métricas bibliométricas lo que mantiene atados a los académicos. Hemos construido infraestructuras enteras alrededor de este servicio gratuito. Universidades usan sus métricas para evaluar a su profesorado, decidir tenencias y otorgar subvenciones. Los programas de formación bibliotecaria lo enseñan. Los comités de promoción lo consultan. Los repositorios internacionales se integran con él. Lo tratamos como si fuera eterno, pero una visita al cementerio de Google debería hacernos reflexionar.

Google Scholar genera exactamente cero ingresos. No cobra, no ofrece planes premium ni muestra publicidad. Atiende a un público pequeño y especializado que no alimenta el negocio central de Google. En términos corporativos, es un “centro de costes”.

Google obtiene la mayor parte de sus ingresos de la publicidad en su buscador principal. Pero ese buscador está en declive. La empresa que prometió “organizar la información del mundo y hacerla universalmente accesible y útil” hoy entrega lo que expertos en SEO llaman “los peores resultados en 14 años”.

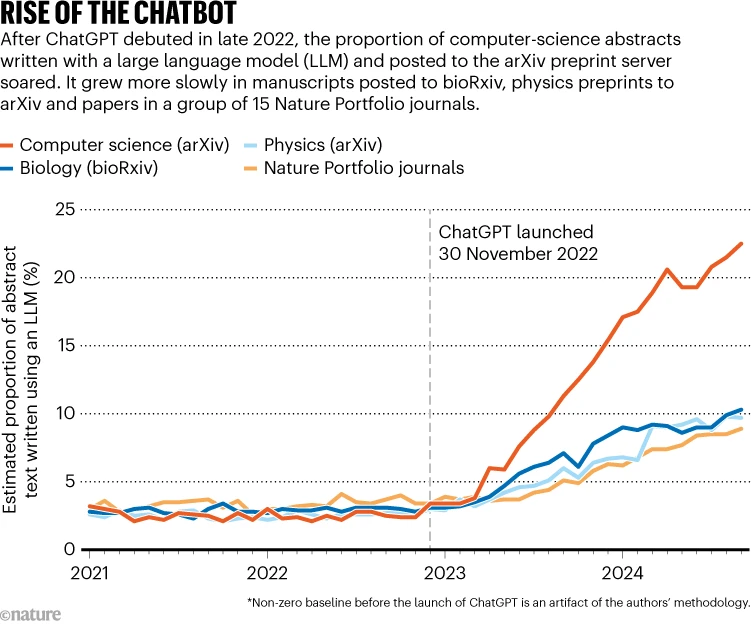

Los AI Overviews de Google están inundados de spam: estafadores manipulan fácilmente el sistema con rankings falsos de “los mejores” y contenido autopromocional que termina citado en resúmenes generados por IA. La cuota de mercado global de Google en búsquedas cayó por debajo del 90 % durante tres meses consecutivos a fines de 2024 (89,34 % en octubre, 89,99 % en noviembre, 89,73 % en diciembre), la primera caída sostenida bajo ese umbral desde 2015, mientras tendencias anecdóticas sugieren que cada vez más usuarios recurren a Reddit, ChatGPT e incluso TikTok como buscadores.

Si Google no puede mantener la calidad en su producto estrella —el que genera 175.000 millones de dólares anuales—, eso sugiere que está:

- perdiendo su ventaja en búsqueda,

- priorizando la IA sobre la calidad del buscador tradicional,

- o ambas.

En cualquier caso, son malas noticias para Scholar. El declive del buscador expone la vulnerabilidad de este servicio.

Mientras los usuarios de Google Scholar siguen elaborando consultas booleanas como en 1995, todos sabemos que los estudiantes hoy recurren a la IA para tareas de investigación. Y algunas de estas herramientas ofrecen funciones impresionantes: buscan, sintetizan hallazgos, sugieren artículos relacionados y explican conceptos complejos. Su precisión y calidad pueden discutirse, pero si eres estudiante con una mentalidad de “aprobar es suficiente” y una entrega a medianoche, ¿por qué lidiar con la interfaz anticuada de Scholar cuando una IA puede ofrecerte artículos y un resumen curado?

Google ve claramente esta tendencia y sabe que Scholar se está volviendo infraestructura redundante. Scholar fue estratégico cuando evitaba que competidores dominaran la búsqueda académica, pero esos días, probablemente, ya pasaron.

La transformación estratégica de Google en una compañía AI-first choca frontalmente con mantener servicios académicos de nicho como Scholar. La empresa ha unificado todos sus esfuerzos en torno a Gemini, con el CEO Sundar Pichai afirmando que están “repensando todos los productos para un futuro impulsado por la IA”.

Un buen ejemplo: Microsoft Academic fue un buscador académico que alguna vez se presentó como alternativa a Scholar. A diferencia de este, abrió su base de datos de autores, instituciones, palabras clave y revistas como datos abiertos. Eso lo convirtió en un recurso muy valioso que apoyaba herramientas como VOSviewer, Unsub, Litmaps y Semantic Scholar. Aun así, Microsoft lo cerró en 2021.

La reacción académica mostró una falta de preparación sistémica. Pese a ser el segundo motor de búsqueda académica más grande, no existían planes de respaldo adecuados. OpenAlex y The Lens surgieron como reemplazos, pero expertos advirtieron que tardarían años en igualar la calidad y cobertura del servicio discontinuado. La interrupción afectó a empresas y herramientas académicas en todo el mundo. La lección: incluso infraestructuras académicas exitosas y ampliamente usadas pueden desaparecer si dejan de ser estratégicas para las compañías.

Si Scholar está tan condenado, ¿por qué ha sobrevivido tanto tiempo? Porque hay razones reales para mantenerlo, al menos de momento.

Aunque no genera beneficios directos, Scholar aporta valor a Google. Las instituciones académicas obligan de facto a los investigadores a usarlo, al hacer visibles sus métricas de citas y perfiles para ascensos y financiación. Pero esa participación requiere que los académicos creen cuentas de Google y acepten sus políticas de recopilación y procesamiento de datos. Así, Scholar encaja en el modelo de negocio de Google basado en vigilancia, información y publicidad conductual.

Google disfruta de un enorme poder en la comunidad académica, y Scholar ejerce un papel de gatekeeper, habiendo “convertido su sistema de conteo de citas en una herramienta que coordina la economía académica”.

Scholar es un ejemplo exitoso de capitalismo de plataforma aplicado a la infraestructura académica: aporta valor a los investigadores mientras refuerza los intereses estratégicos de Google mediante datos, marca y control del ecosistema. Esta es la razón de su supervivencia.

En 2024, Google celebró el 20 aniversario de Scholar con simpáticas entradas de blog y algunas funciones menores de IA. Pero ¿qué no proporcionó? Compromisos concretos de financiación, prioridad estratégica o sostenibilidad a largo plazo.

Así que aquí estamos: Google tiene un historial probado de cerrar herramientas académicas, Scholar no genera ingresos en una empresa obsesionada con prioridades multimillonarias, la IA está revolucionando la búsqueda de información, y la academia ha construido infraestructura crítica alrededor de un servicio gratuito y comercial que no ofrece garantías.

Según opinión de la autora Scholar desaparecerá en menos de cinco años. Google lo anunciará con doce meses de preaviso, habrá un colapso colectivo en Bluesky, las universidades se apresurarán a buscar alternativas y los flujos de trabajo de investigación estarán en caos durante años.

No digas que no lo advertí. Cuando Scholar se una a Google Reader en el cementerio digital, recuerda este momento.