Laird, Elizabeth, Madeliene Dwyer y Hugh Grant‑Chapman. Off Task: EdTech Threats to Student Privacy and Equity in the Age of AI. Washington, DC: Center for Democracy & Technology, septiembre de 2023. https://cdt.org/wp-content/uploads/2023/09/091923-CDT-Off-Task-web.pdf

El informe analiza críticamente cómo las tecnologías educativas (edtech), especialmente aquellas impulsadas por inteligencia artificial, están afectando la privacidad y la equidad en el entorno escolar estadounidense. A través de encuestas a estudiantes, familias y docentes de secundaria, se identifica un uso creciente de herramientas de filtrado de contenido, monitoreo estudiantil y plataformas de IA generativa, sin una reflexión adecuada sobre sus implicaciones éticas, sociales y pedagógicas.

Uno de los principales hallazgos es la falta de participación de las comunidades educativas en la toma de decisiones sobre estas tecnologías. Muchos estudiantes y padres expresan preocupación por su uso, pero apenas una minoría ha sido consultada o informada sobre su implementación. Además, el profesorado ha recibido escasa formación, lo que limita su capacidad para aplicar estas herramientas de forma crítica y justa. Esta falta de transparencia y educación crea un entorno donde las decisiones técnicas se imponen sin diálogo, debilitando la confianza en el sistema educativo.

El informe subraya también cómo el filtrado de contenido, aunque pensado para proteger a los estudiantes, a menudo bloquea información legítima y relevante para su aprendizaje. Esto se vuelve especialmente preocupante cuando los filtros restringen temas vinculados a la identidad racial, el género o la orientación sexual, reproduciendo sesgos y excluyendo a estudiantes LGBTQ+ o pertenecientes a minorías. Así, estas herramientas pueden actuar como formas digitales de censura o exclusión.

Resultados:

62 % de los estudiantes y 73 % de los padres/madres están preocupados por el uso de edtech, pero:

Solo 38 % de los estudiantes y 31 % de los padres/madres afirman haber sido consultados por sus escuelas sobre el uso de estas tecnologías.

Casi el 100 % de las escuelas utilizan sistemas de filtrado web.

71 % de los estudiantes informan que estos filtros dificultan sus tareas escolares.

41 % de estudiantes LGBTQ+ reportan tener más dificultades que sus compañeros para acceder a información relevante para su identidad.

39 % de estudiantes afroamericanos afirman que los filtros bloquean contenidos sobre historia o cultura negra.

58 % de los estudiantes han usado herramientas de IA generativa al menos una vez.

24 % han sido sancionados por su uso.

57 % de los docentes no han recibido ninguna formación sobre estas tecnologías.

37 % no sabe si su escuela tiene políticas sobre IA generativa.

Solo 34 % de los docentes han recibido formación sobre privacidad digital en el último año.

El 52 % de los docentes afirman que les cuesta confiar en el trabajo de los estudiantes desde que se empezó a usar IA generativa.

Por otro lado, el monitoreo digital de la actividad estudiantil —incluso fuera del horario escolar y en dispositivos personales— está en aumento. Este tipo de vigilancia genera consecuencias graves: sanciones disciplinarias desproporcionadas, denuncias a las autoridades e incluso situaciones en las que estudiantes LGBTQ+ han sido “sacados del armario” sin su consentimiento. Las medidas de vigilancia no solo afectan la privacidad, sino también el bienestar emocional y la seguridad de los estudiantes más vulnerables.

El uso de inteligencia artificial generativa, como ChatGPT, ha crecido rápidamente en los entornos escolares, pero sin preparación institucional. La mayoría del profesorado no ha recibido formación sobre su uso ni conoce las políticas escolares al respecto. Esto ha llevado a que muchos estudiantes sean sancionados por utilizar estas herramientas, aunque no existan normas claras que regulen su aplicación. Al mismo tiempo, los docentes expresan preocupación por la pérdida de confianza en el trabajo autónomo del alumnado, lo que genera tensiones en la relación educativa.

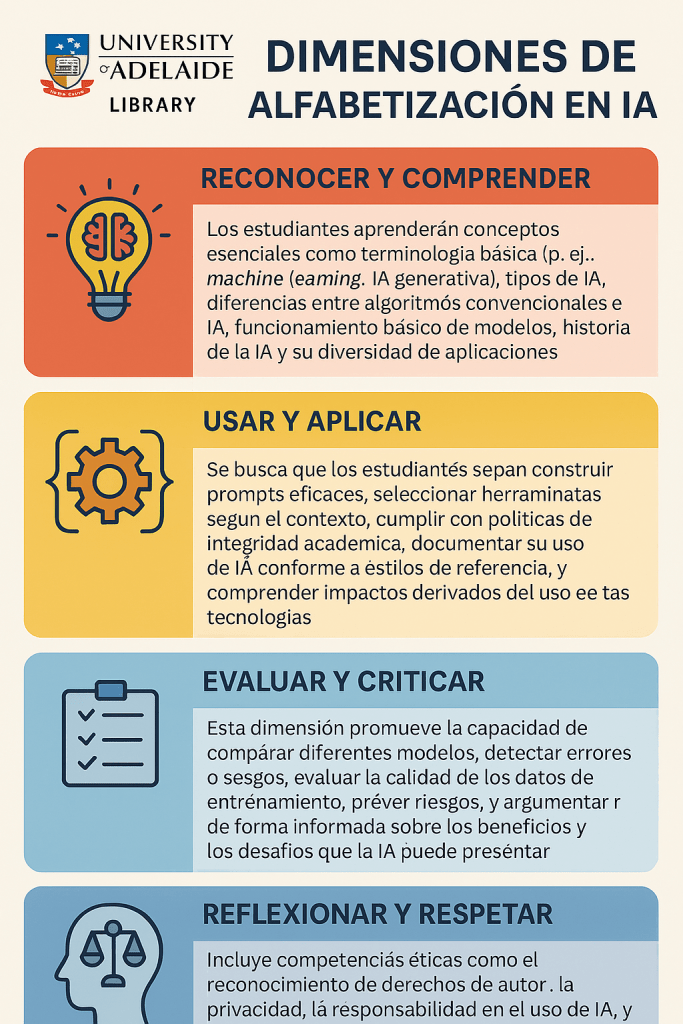

El informe advierte que estas tecnologías afectan de forma desproporcionada a estudiantes con discapacidades, de bajos ingresos o pertenecientes a colectivos marginados, amplificando desigualdades estructurales. Por ello, no se trata únicamente de un problema de privacidad, sino de una cuestión de derechos civiles y justicia educativa. CDT concluye con una serie de recomendaciones urgentes: establecer marcos normativos claros, formar adecuadamente al personal docente, y garantizar la participación significativa de estudiantes y familias en todas las decisiones relacionadas con la tecnología en las aulas.

Recomendaciones:

Incluir a estudiantes y familias en la toma de decisiones sobre EdTech

- Involucrar activamente a las comunidades escolares en la evaluación, selección y supervisión de las tecnologías utilizadas en clase.

- Fomentar la transparencia sobre las herramientas empleadas y sus finalidades.

Revisar políticas de filtrado de contenido

- Asegurar que los filtros no limiten el acceso a información educativa legítima, especialmente en temas de identidad, salud mental o justicia social.

- Evitar que los filtros reproduzcan sesgos discriminatorios.

Limitar el monitoreo estudiantil

- Establecer políticas claras sobre qué se monitorea, cuándo, cómo y por qué.

- Asegurar que el monitoreo no continúe fuera del horario escolar ni en dispositivos personales sin consentimiento informado.

Crear políticas claras sobre el uso de IA generativa

- Proporcionar directrices coherentes y accesibles para el alumnado y profesorado sobre cómo se puede o no utilizar la inteligencia artificial generativa.

- Integrar estas políticas en los planes pedagógicos.

Formar al profesorado

- Ofrecer formación continua sobre privacidad digital, equidad tecnológica y uso ético de la inteligencia artificial.